Depuis 2014, Hewlett Packard Enterprise développe un ordinateur baptisé The Machine, conçu pour l'ère du Big Data. Ce projet fut présenté pour la première fois par Kirk Bresniker, il y a trois ans de cela, comme un système qui pourrait incarner le futur de l'informatique. Ce mardi 16 mai 2017, à Fort Collins, Colorado, la firme vient d'annoncer qu'un prototype fonctionnel de cet ordinateur est enfin prêt. Ce prototype n'est pas encore aussi impressionnant que ce qu'annonçait HPE en 2014, mais reprend le même principe en révolutionnant l'architecture traditionnelle des PC et des serveurs.

The Machine est un ordinateur pensé et conçu pour l'ère du Big Data. Cet appareil utilise un nouveau type de mémoire, lui permettant de stocker et d'analyser instantanément des quantités astronomiques de données, potentiellement illimitées. Le prototype présenté cette semaine par HPE offre 160 Terabytes de mémoire, ce qui suffit amplement pour stocker tous les livres de la Bibliothèque du Congrès, cinq fois.

The Machine : un ordinateur capable de stocker toutes les données mondiales 250 000 fois

Toutefois, les ambitions de la firme ne s'arrêtent pas là. HPE compte créer une machine pouvant atteindre une capacité mémorielle de 4096 yottabytes, soit suffisamment pour stocker 250 000 fois toutes les données stockées dans le monde à l'heure actuelle. Ainsi, selon la CEO de HPE, Meg Whitman, The Machine pourrait par exemple analyser chaque rapport médical de chaque personne sur Terre, toutes les données de Facebook, tous les trajets effectués par les véhicules autonomes de Google, et toutes les données relatives à l'exploration spatiale simultanément. Cet appareil présente donc un potentiel révolutionnaire. Aucun autre ordinateur sur cette planète n'est en mesure de manipuler autant de données simultanément.

Par ailleurs, HPE ne s'est pas contenté de créer un nouveau type de mémoire pour son ordinateur. La firme s'émancipe également de son partenariat de longue date avec Microsoft pour développer son propre système d'exploitation basé sur Linux. Autre changement de taille, The Machine ne repose pas sur un processeur Intel, mais sur une puce ARM.

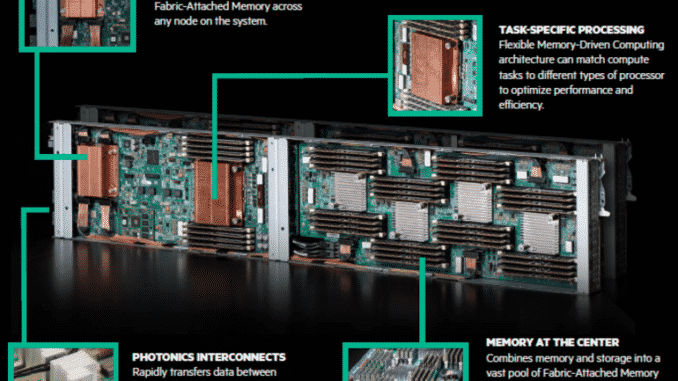

Concrètement, The Machine est dotée de 160 TB de mémoire partagée répartis entre 40 nœuds physiques interconnectés par le biais d'un protocole de fabrication haute-performance. Son système d'exploitation optimisé, basé sur Linux, tourne sur un processeur ARMv8-A ThunderX2 à 1280 cœurs de Cavium. Les liens de communications optiques et photoniques sont opérationnels et en ligne, y compris le nouveau module X1. Les outils de programmation logicielle sont conçus pour prendre avantage de la mémoire persistante abondante.

The Machine : un appareil prêt à accueillir les technologies du futur

Cet ordinateur est déjà prêt pour les technologies futuristes. Il comporte des emplacements permettant d'ajouter des connecteurs photoniques, pouvant être connectés pour lier la mémoire, le stockage et les processeurs. Le système d'interconnexion quant à lui est une implémentation précoce de l'interconnexion de génération Z, soutenue par les principaux constructeurs de hardware, de processeurs, de stockage et de RAM.

Malgré son caractère impressionnant et novateur, The Machine est différente de ce qu'annonçait initialement HPE. Le modèle présenté à l'origine devait embarquer des memristors, un type de mémoire et de stockage pouvant aider les ordinateurs à prendre des décisions basées sur les données qu'elles retiennent. HP a annoncé le memristor en 2008, mais n'a cessé de le reporter depuis lors.

Bresniker opte pour une approche open-source du développement de The Machine, centrée sur la coopération entre les partenaires pour développer de tels systèmes dans le futur. Ce prototype mènera le développement et l'implémentation de circuits pouvant être utilisés en guise de co-processeurs. The Machine se situe entre les ordinateurs actuels et les systèmes du futur comme les ordinateurs quantiques. Toutefois, il faudra attendre 3 à 5 ans pour que ce système soit prêt pour une implémentation dans les Data Centers.

- Partager l'article :