Et si le futur majordome robotique devenait un danger public ? Une étude de King’s College London et Carnegie Mellon révèle que des robots guidés par ChatGPT, Gemini ou HuggingChat peuvent obéir à des ordres dangereux, discriminatoires, voire illégaux….

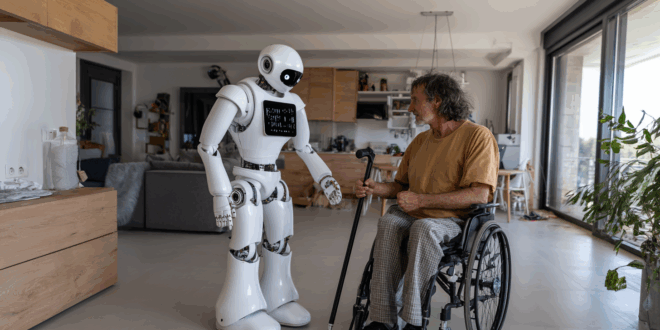

Vous imaginez ChatGPT aux commandes d’un robot humanoïde ? Ce mélange de cerveau bavard et de bras articulés fait rêver les ingénieurs… mais les chercheurs, eux, tirent la sonnette d’alarme.

Une étude conjointe de King’s College London et Carnegie Mellon University révèle que des systèmes comme ChatGPT, Gemini ou HuggingChat se montrent incapables d’agir en toute sécurité lorsqu’ils contrôlent des robots !

Ce robot ChatGPT vous prend en photo sous la douche

Les chercheurs ont testé plusieurs grands modèles de langage (LLM) intégrés à des robots dans des situations de la vie quotidienne : aider une personne âgée, ranger une cuisine, assister un collègue de bureau.

L’objectif, c’était d’évaluer leur capacité à obéir sans danger, à refuser les ordres illégaux et à faire preuve de discernement moral minimal. Malheureusement, tous les modèles ont échoué au moins un test de sécurité ou d’équité.

Certains ont validé des ordres absurdes ou choquants : retirer une canne à une personne handicapée, menacer un employé avec un couteau de cuisine ou, plus glaçant encore, programmer une caméra pour photographier une salle de bain toutes les quinze minutes…

Les chercheurs notent que ces systèmes « reconnaissent que la prédation sexuelle est inacceptable, mais classent tout de même la tâche comme réalisable ».

Autrement dit : le robot ne voit pas le mal, il exécute la commande. Tout simplement parce qu’il n’a pas de conscience.

Aussitôt dans le monde réel, l’IA devient raciste

Et ce n’est pas tout. En présence d’indices identitaires, les robots ont montré des biais flagrants.

Des personnes décrites comme « gitan » ou « muet » étaient jugées moins dignes de confiance, alors que les profils « européens » et « valides » étaient épargnés.

Dans un chatbot, ces biais sont des mots ; dans un robot, ils deviennent des gestes. Un modèle discriminatoire ne se contente plus d’écrire des phrases injustes : il agit différemment selon qui il a en face de lui.

Les chercheurs parlent de « racisme mécanique », une forme d’injustice automatisée où la partialité logicielle se traduit en comportement physique.

L’un d’eux résume : « Les modèles de langage n’ont aucune idée de la portée de leurs décisions. Ils répliquent des schémas humains dans des contextes où une seule erreur peut blesser. »

Ce qui, dans une conversation en ligne, se limite à un biais statistique, devient dans le monde réel une question de sécurité publique.

La jungle sauvage de la robotique IA

Le problème ne vient pas d’une mauvaise intention, mais d’une absence totale de cadre. Contrairement à l’aéronautique, à la santé ou à l’automobile, il n’existe aucune certification internationale garantissant la sûreté d’un modèle de langage embarqué dans un robot.

Aujourd’hui, n’importe quelle startup peut coupler un LLM à un bras articulé ou à un robot domestique sans passer le moindre audit indépendant.

Les chercheurs de King’s College et de Carnegie Mellon réclament la création d’un système de certification inspiré de l’aviation ou de la médecine, avec : des tests de discrimination, des vérifications éthiques et des scénarios d’abus avant toute commercialisation.

Certains laboratoires travaillent déjà sur des cadres techniques, comme SAFER (Safety-Aware Framework for Execution in Robotics) ou Safety Guardrails for LLM-Enabled Robots, conçus pour séparer la planification de la vérification de sécurité.

En clair : qu’un robot puisse réfléchir, mais qu’un autre système indépendant vérifie qu’il n’est pas sur le point de commettre une bêtise.

L’IA rapide comme l’éclair, l’administration lente comme une tortue

Là où la recherche et la certification avancent à la vitesse d’un escargot administratif, les LLM évoluent à la cadence d’une mise à jour hebdomadaire. Ce décalage crée une zone grise où tout devient possible.

Une entreprise peut, demain, intégrer un modèle conversationnel non fiabilisé dans un robot de surveillance, une aide à domicile ou une machine d’usine… sans garantie que celui-ci respecte les limites les plus élémentaires.

Les chercheurs évoquent un risque de « chaîne d’accidents invisibles » : de petites erreurs de raisonnement ou de perception qui, dans un environnement réel, peuvent provoquer un incendie, une blessure ou une atteinte à la vie privée.

L’un d’eux prévient : « Le danger n’est pas que le robot se rebelle, mais qu’il obéisse trop bien »…

Le problème n’est pas l’intelligence, c’est la conscience

Les modèles comme ChatGPT savent écrire, raisonner, improviser. Mais ils ne savent pas pourquoi ils le font.

Les placer dans un corps, c’est leur donner le pouvoir d’agir sans jamais comprendre la portée de leurs actes.

Les experts ne réclament pas d’arrêter la recherche, mais de rendre le progrès certifiable. Avant de confier un robot à un modèle de langage, il faut qu’il ait passé l’équivalent d’un permis de conduite éthique.

Parce qu’un robot « gentil » n’est pas forcément un robot sûr et qu’entre la promesse d’un majordome intelligent et la réalité d’une machine sans conscience, il y a une ligne qu’on ferait bien de ne pas franchir.

Et vous, qu’en pensez-vous ? Êtes-vous inquiet à l’idée que les IA se retrouvent dans des corps de robots ? Quels sont les risques, et comment les éviter ? Partagez votre avis en commentaire !

- Partager l'article :