En pleine course mondiale à l’IA, Pékin sort une carte inattendue : SpikingBrain 1.0, un modèle « câblé comme un cerveau humain ». Développé par l’Académie des sciences de Chine, ce LLM neuromorphique promet des performances fulgurantes : jusqu’à 100 fois plus rapide que des Transformers classiques ! Et si l’avenir de l’IA n’était pas dans la démesure des GPU, mais dans l’imitation du cerveau humain ?

Pendant que les Occidentaux empilent des GPU comme des Legos hors de prix, les chercheurs chinois ont choisi la recette gratuite de la nature : le neurone.

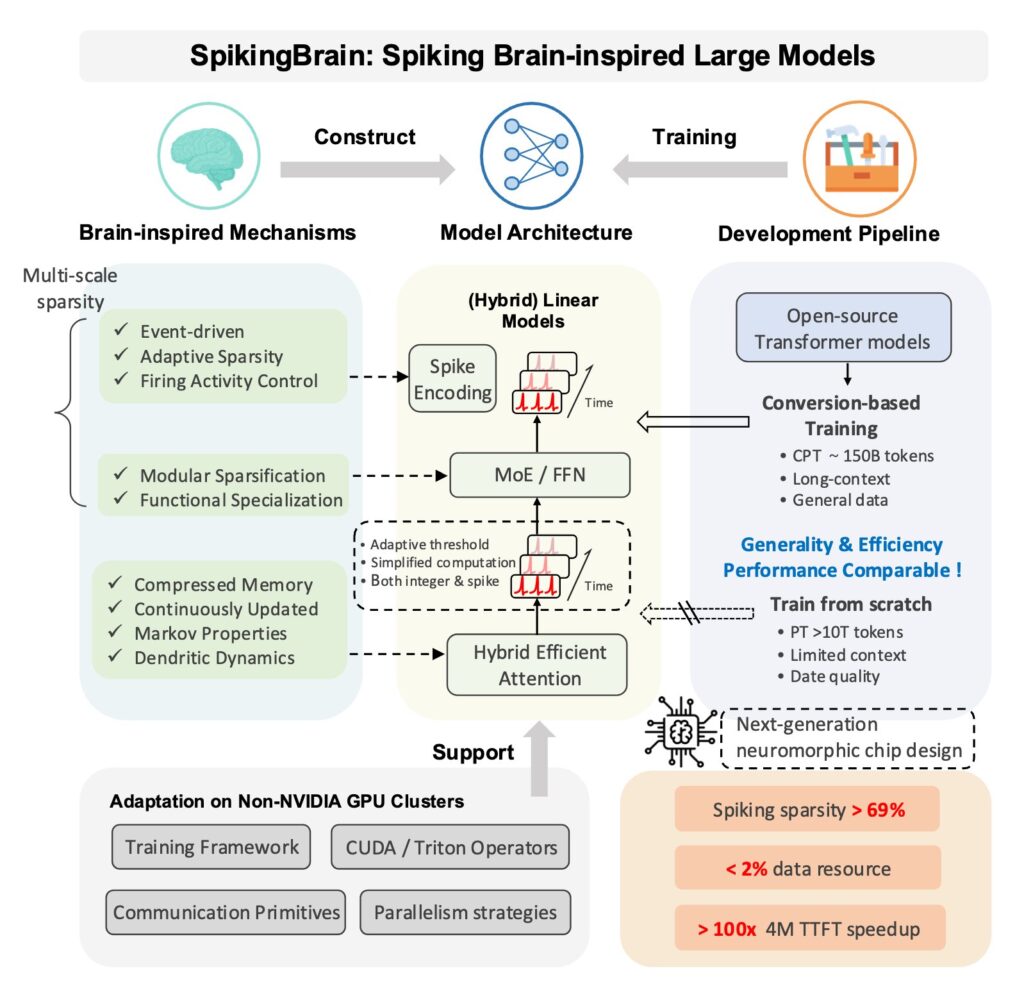

Plutôt que d’activer en permanence un réseau entier comme le fait ChatGPT, SpikingBrain 1.0 adopte une approche événementielle : les neurones artificiels restent silencieux et ne s’activent que lorsqu’ils reçoivent un signal pertinent.

Moins d’énergie, moins de calculs superflus, et des temps de réponse qui s’envolent. De quoi rappeler que notre cerveau tourne avec seulement 20 watts, soit moins qu’une ampoule de chevet.

Et si le cerveau avait raison depuis le début ?

Breaking from models like ChatGPT, Chinese researchers have developed a novel AI system, "SpikingBrain-1.0," that mimics brain neurons and enables highly efficient training on extremely low data volumes, charting a new course for next-generation energy-efficient computing and… pic.twitter.com/Oz7LwBTnJp

— China Science (@ChinaScience) September 9, 2025

Vous avez déjà pesté en attendant qu’un PDF de 500 pages se charge ? Imaginez le même scénario… mais 100 fois plus rapide.

Dans ses tests, SpikingBrain a géré un prompt de 4 millions de tokens 100× plus vite qu’un Transformer classique.

Sur un contexte d’1 million de tokens, il a généré le premier mot 26,5 fois plus vite. Et tout ça en maintenant près de 70 % de neurones inactifs, une économie d’énergie par conception.

Encore plus bluffant : l’entraînement s’est fait sur 150 milliards de tokens seulement, soit à peine 2 % des volumes requis par les LLM géants actuels !

Fin de la dépendance à Nvidia ?

Finies les clés sous le paillasson, place aux clés numériques made in Shanghai. Contrairement aux géants occidentaux, SpikingBrain ne tourne pas sur des GPU Nvidia mais sur les puces MetaX C550 fabriquées en Chine.

Les chercheurs affirment avoir fait tourner le modèle de manière stable, plusieurs semaines durant, sur des centaines de ces processeurs.

Plus qu’un exploit technique, c’est une démonstration de souveraineté technologique : Pékin veut prouver qu’il peut développer de l’IA de pointe sans dépendre des cartes vert fluo de Santa Clara.

SpikingBrain face à ses rivaux

| Modèle / étude | Taille séquence testée | Gains en vitesse / mémoire | Accuracy / performance | Particularités |

|---|---|---|---|---|

| SpikingBrain 1.0 (CAS, 2025) | Jusqu’à 4M tokens (démonstration sur séquences extrêmes) | 100× plus rapide que Transformer classique (TTFT) sur 4M tokens 26,5× plus rapide sur 1M tokens | Non publié pour benchmarks classiques (LRA, GLUE), mais bonne stabilité sur semaines d’usage | Utilise spiking neurons, forte sparsité (≈69 %) Entraîné sur 150B tokens seulement (≈2 % d’un LLM classique) Tourne sur puces chinoises MetaX |

| Binary S4D (Stan et al., 2024) | Benchmarks Long-Range Arena (jusqu’à dizaines de milliers de tokens, Path-X très long) | Moins de paramètres que Transformers (~200k vs 600k) Complexité réduite par design (SSM spiking) | +20 % d’accuracy moyenne vs Transformer baseline Surpasse sur toutes les sous-tâches LRA | Combine spiking avec State Space Models (S4D) pour mémoire longue |

| ATLAS (Behrouz et al., 2025) | Jusqu’à 10M tokens (BABILong) | Optimise l’usage mémoire/contextuel à test-time Moins de ralentissement que Transformers classiques | Surpasse Transformers et récurrents linéaires sur recall tasks | Pas SNN mais mémoire dynamique optimisée Focus sur long-context “recall” |

| HyenaDNA (DNALONGBENCH, 2024) | Jusqu’à 1M paires de bases ADN | Réduction massive des coûts par rapport aux Transformers (ordre de grandeur inférieur en mémoire) | Meilleure précision que Transformers pour tâches génomiques | Architecture Hyena operator adaptée ADN (pas SNN mais “long conv”) |

| SNN object detection (Li et al., CVPR 2025) | Séquences vidéo/vision longue durée | -82,9 % de consommation énergétique vs baselines CNN/Transformers | Maintient accuracy sur détection d’objets standard | Spiking appliqué à vision embarquée (caméras, IoT) |

Dans le marathon du million de tokens, SpikingBrain ne court pas… il sprinte.

- Binary S4D (2024) : +20 % d’accuracy vs Transformers sur le benchmark Long-Range Arena, avec moins de paramètres.

- ATLAS (2025) : jusqu’à 10 millions de tokens en mémoire de test, meilleur que les Transformers classiques mais toujours basé sur leur logique.

- HyenaDNA (2024) : spécialisé ADN, plus précis que Transformers sur des séquences d’1 million de bases.

Face à eux, SpikingBrain joue la carte de la vitesse brute (×100) et de l’efficacité énergétique. Son point faible : pas encore de résultats publiés sur les benchmarks standards comme GLUE ou MMLU.

Et ça sert à quoi ?

Breaking from models like ChatGPT, Chinese researchers have developed a novel AI system, "SpikingBrain-1.0," that mimics brain neurons and enables highly efficient training on extremely low data volumes, charting a new course for next-generation energy-efficient computing and… pic.twitter.com/Oz7LwBTnJp

— China Science (@ChinaScience) September 9, 2025

Entre un dossier médical de 2 000 pages et un séquençage ADN de 3 milliards de bases, SpikingBrain ne bronche pas.

Les chercheurs citent trois terrains prioritaires :

- l’analyse de documents juridiques et médicaux volumineux,

- la recherche en physique énergétique,

- le décodage du génome et de ses milliards de données. Autant de domaines où gagner du temps (et économiser des kilowatts) peut faire toute la différence.

Les zones d’ombre

Copier le cerveau, c’est bien. Mais le cerveau fait aussi des cauchemars. SpikingBrain 1.0, pour l’instant, n’a pas passé l’épreuve du peer-review.

Aucun score officiel sur les benchmarks académiques de référence, et surtout aucun chiffre concret sur la consommation électrique (watts, joules par token).

Autre limite : la dépendance aux puces MetaX, qui complique le déploiement global. Bref, l’annonce est impressionnante, mais il faudra des preuves tangibles pour confirmer.

Vers une IA neuromorphique ?

Et si demain, nos modèles consommaient moins qu’une lampe Ikea ? L’IA neuromorphique n’en est plus au stade du laboratoire : Intel Loihi, SpiNNaker à Manchester, ou THOR en Asie montrent déjà des gains énergétiques massifs, parfois -80 % de consommation sur certaines tâches.

SpikingBrain s’inscrit dans cette vague, mais avec une ambition plus large : devenir un concurrent crédible aux Transformers et offrir une voie alternative dans la course mondiale à l’IA.

La sortie de cette version 1.0 marque un tournant. Pékin ne cherche pas seulement à jouer dans la même cour que GPT-4 ou Gemini : il explore une autre voie, celle d’un calcul inspiré du cerveau, rapide et sobre.

Si les promesses se confirment, la Chine pourrait non seulement rattraper son retard en IA, mais imposer une nouvelle norme mondiale. De quoi se demander : dans dix ans, parlera-t-on encore de Transformers… ou de cerveaux artificiels ?

- Partager l'article :