Les deepfakes aussi connus sous le terme hypertrucage désigne une fausse vidéo générée par l’IA qui permet de créer de faux contenus pouvant parfois être compromettants ou utilisés à des fins malveillantes. Ces deepfakes se multiplient à un rythme effréné, augmentant de 330% d’octobre 2019 à juin 2020 selon la start-up Deeptrace, avec un pic de 50 000 deepfakes durant cette période.

La création de deepfakes ultra réaliste très accessible

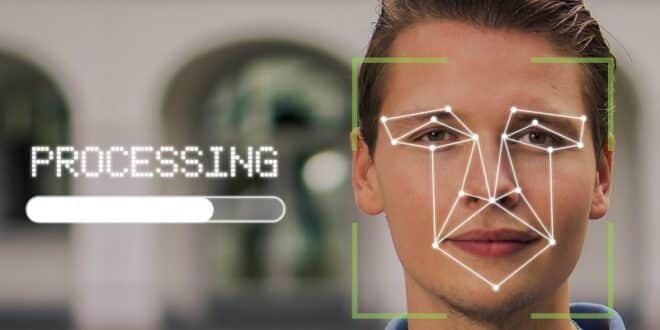

Les outils open source permettent à toute personne ayant des images d’une victime de créer un deepfake convaincant. Une nouvelle étude suggère que les techniques de génération de deepfake ont atteint le point où elles peuvent tromper de manière fiable les systèmes de reconnaissance faciale commerciaux. Des chercheurs de l’Université Sungkyunkwan de Suwon en Corée du Sud, ont trompé des API de Microsoft et d’Amazon avec les méthodes de génération de deepfake couramment utilisées.

Selon les chercheurs, certaines méthodes de génération de deepfake sont plus menaçantes pour les systèmes de reconnaissance que d’autres et que chaque système réagit différemment aux attaques par imitation de deepfake. Les résultats des recherches permettront une meilleure conception d’API Web robustes, ainsi que des mécanismes de défense appropriés, une nécessité urgente pour lutter contre l’utilisation malveillante des deepfakes.

Les systèmes de reconnaissance faciale trompés dans 78% des cas

Pour voir dans quelle mesure les API commerciales de reconnaissance faciale peuvent être trompées par les deepfakes, les chercheurs ont utilisé des modèles d’IA formés sur cinq ensembles de données différents : trois disponibles publiquement et deux créations. Ces données contiennent des visages de stars de cinéma, de chanteurs, d’athlètes et de politiciens. Ils ont créé 8 119 deepfakes au total à partir des ensembles de données. Ils ont ensuite extrait des visages dans les images vidéo des deepfakes et aux systèmes de reconnaissance faciale l’identité de la personne sur l’image.

Les chercheurs ont découvert que toutes les API étaient susceptibles d’être dupées par les deepfakes. Azure Cognitive Services a pris un deepfake pour une célébrité cible dans 78% des cas contre 68,7% pour Rekognition d’Amazon. Rekognition a mal classé les images dans 40% des cas. Et dans une expérience avec Azure Cognitive Services, les chercheurs ont réussi à usurper l’identité de 94 célébrités sur 100 dans l’un des ensembles de données open source.

Des risques en termes de confidentialité, de sécurité, de réputation

Les résultats de l’étude montrent que la lutte contre les deepfakes relève d’un vrai défi, d’autant que les techniques de génération de médias continuent de s’améliorer. En supposant que l’API de reconnaissance faciale ne peut pas distinguer le deepfake de l’authentique, cela peut entraîner de nombreux risques de confidentialité, de sécurité et de répudiation, ainsi que de nombreux cas de fraude.

Les technologies de deepfake voix et vidéo peuvent être combinées pour créer des deepfakes multimodaux et utilisées pour mener des attaques de phishing plus puissantes et réalistes. Et si les API commerciales ne parviennent pas à filtrer les deepfakes sur les réseaux sociaux, cela permettra la propagation de fausses informations, ce qui peut nuire à des personnes innocentes.

- Partager l'article :