OpenAI a dévoilé GPT-5.3 Codex, un modèle d’IA agentique capable de gérer des projets logiciels entiers et déjà utilisé dans sa propre chaîne de développement. Derrière les gains de performance annoncés, c’est surtout la place de l’humain dans la fabrication de l’IA qui commence à se déplacer.

Pendant longtemps, les modèles d’IA ont été pensés comme des outils d’assistance. Ils suggéraient du code, corrigeaient des erreurs, accéléraient des tâches ponctuelles. GPT-5.3 Codex marque une rupture plus profonde, moins visible au premier regard : l’IA ne se contente plus d’aider les développeurs, elle commence à prendre en charge des pans entiers du travail logiciel, sur la durée, avec une autonomie croissante.

Ce changement ne tient pas à une course aux paramètres ou à un saut spectaculaire d’architecture. OpenAI insiste au contraire sur la capacité de Codex à agir comme un agent, capable de planifier, d’exécuter, de vérifier et d’itérer sans supervision constante. Une évolution qui dépasse largement la question du codage et interroge directement l’organisation même du développement logiciel.

Mais un élément retient particulièrement l’attention : OpenAI affirme que GPT-5.3 Codex a été utilisé pour accélérer sa propre conception.

Non pas en définissant ses objectifs ou son architecture, mais en absorbant une partie du travail humain nécessaire à l’entraînement, aux tests et au déploiement. Une pratique encore marginale il y a peu, mais qui pourrait bien devenir la norme dans les laboratoires d’IA avancés.

Si GPT-5.3 Codex ne relève pas de la science-fiction, il révèle en revanche une dynamique nouvelle : celle d’une IA qui commence à réduire le coût humain de son propre progrès. Et c’est précisément là que se joue le vrai basculement.

De l’assistance au pilotage autonome du travail logiciel

Ce qui distingue GPT-5.3 Codex de ses prédécesseurs ne tient pas à un saut algorithmique spectaculaire, mais à une combinaison précise de facteurs. Le modèle est plus rapide, plus stable sur la durée, et surtout conçu pour fonctionner comme un acteur continu dans un environnement logiciel réel.

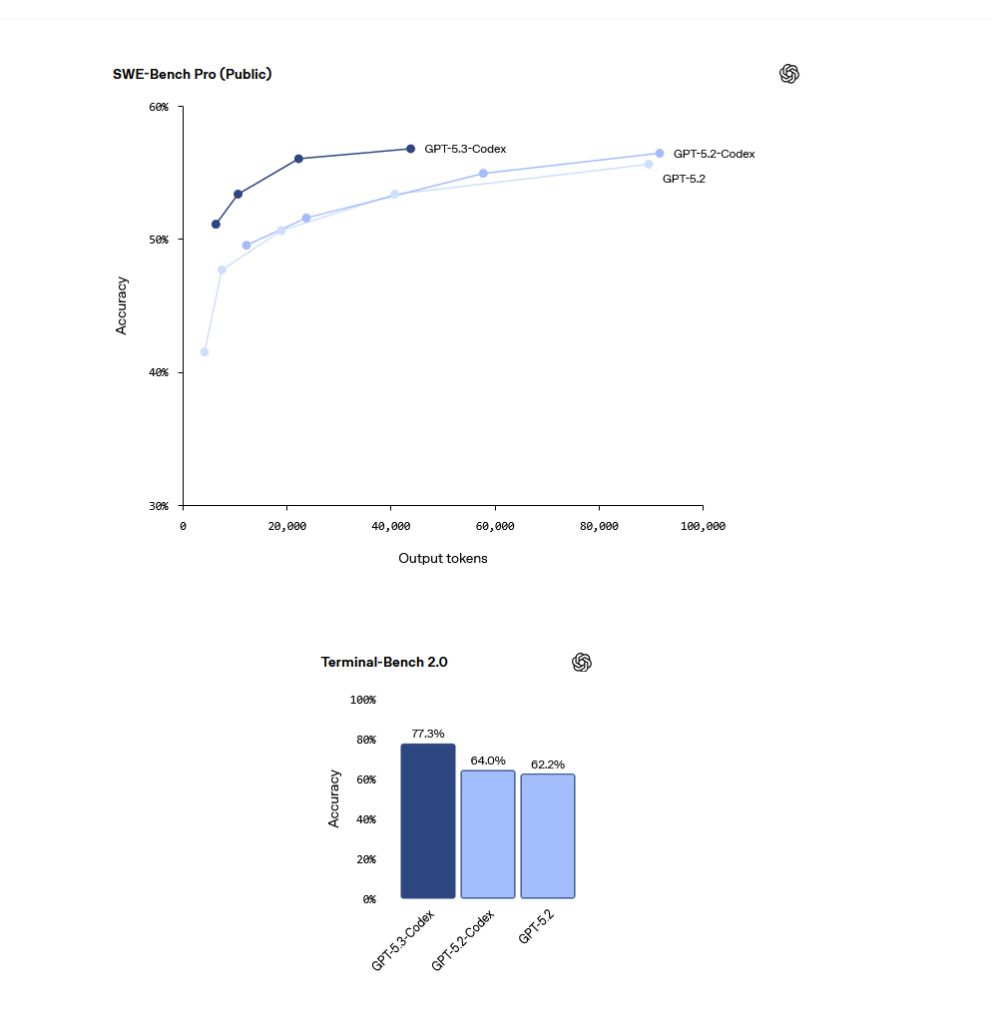

OpenAI revendique une amélioration d’environ 25 % de la vitesse d’exécution par rapport à GPT-5.2 Codex. Mais ce chiffre, pris isolément, est presque secondaire.

Les tests internes montrent surtout une progression nette sur des benchmarks orientés exécution réelle, comme Terminal-Bench 2.0, où le modèle atteint 77,3 %, contre 64 % pour la génération précédente.

Ce type de test ne mesure pas la qualité du code produit, mais la capacité à enchaîner correctement des actions, à comprendre l’état d’un système et à s’adapter en conséquence.

Concrètement, GPT-5.3 Codex est pensé pour concevoir une application, la déboguer, exécuter des tests, gérer un déploiement, produire une documentation et poursuivre l’itération sans supervision constante.

OpenAI met en avant des démonstrations internes où le modèle mène des projets complexes sur plusieurs jours, en intégrant des retours intermédiaires et des ajustements successifs. Ce n’est pas une IA “plus intelligente” au sens abstrait. C’est une IA plus opérante.

“L’IA qui s’est codée seule” : un slogan, un mécanisme, une conséquence

La formule a fait mouche, mais elle mérite d’être disséquée froidement. Lorsque OpenAI affirme que GPT-5.3 Codex a été “instrumental dans sa propre création”, il ne s’agit ni d’auto-conception complète, ni d’une IA qui définirait seule ses objectifs. L’architecture, les données et les orientations stratégiques restent humaines.

En revanche, OpenAI confirme que des versions préliminaires du modèle ont été utilisées pour déboguer l’entraînement, diagnostiquer des comportements, analyser des résultats de tests et gérer des éléments du déploiement. Autrement dit, l’IA est désormais intégrée au cœur des outils qui servent à améliorer l’IA.

C’est là que se situe le véritable basculement. Historiquement, le développement de modèles de pointe reposait sur une mobilisation humaine massive pour des tâches à forte charge cognitive mais à faible valeur stratégique : lecture de logs, identification de régressions, ajustements itératifs, validation manuelle de comportements. GPT-5.3 Codex absorbe une partie croissante de ce travail.

Le résultat n’est pas une IA autonome, mais un effet de levier cumulatif. Chaque génération nécessite moins de temps humain pour être améliorée que la précédente. Et lorsque le facteur limitant cesse d’être l’expertise pour devenir le temps disponible des équipes, la dynamique d’évolution change radicalement.

Ce point est d’autant plus critique qu’OpenAI n’est pas un cas isolé. Anthropic tient un discours similaire sur l’usage interne de ses propres modèles. Dans les laboratoires de pointe, l’IA n’est plus seulement un produit final : elle devient un outil central de R&D, réservé de facto aux acteurs capables d’en assumer le coût et la complexité.

Quand le modèle disparaît derrière l’agent

À force de commenter les performances des modèles, on passe à côté de l’essentiel. GPT-5.3 Codex n’est pas conçu comme un générateur de texte ou de code, mais comme un agent capable d’agir, de vérifier, de corriger et de persister.

Le passage est décisif. On quitte la logique “prompt → réponse” pour une logique “objectif → plan → exécution → contrôle → itération”. GPT-5.3 Codex peut lancer des commandes, manipuler des fichiers, exécuter des pipelines, documenter ses actions et continuer sans intervention humaine prolongée.

C’est cette capacité qui permet à OpenAI d’affirmer que Codex peut accomplir presque tout ce qu’un professionnel peut faire sur un ordinateur. Non par omniscience, mais parce que raisonnement, mémoire de contexte et capacité d’action sont désormais réunis dans un même système.

La conséquence est immédiate : la barrière n’est plus technique. Les projets ne sont plus ralentis par le manque de compétences de codage, mais par la capacité humaine à définir des objectifs pertinents, à arbitrer et à assumer la responsabilité finale. Le développeur ne disparaît pas. Il change de rôle. Il devient superviseur de systèmes autonomes.

Le vrai seuil franchi est organisationnel

GPT-5.3 Codex n’introduit pas de rupture radicale d’architecture. Il n’invente pas un nouveau paradigme mathématique. Mais il redistribue profondément les rôles dans la chaîne de production logicielle.

Quand un agent peut écrire du code, générer des tests, corriger ses propres erreurs, documenter et déployer, la valeur ne réside plus dans l’exécution. Elle se déplace vers la décision. Décider quoi faire, jusqu’où automatiser, quand intervenir, et surtout qui est responsable.

C’est là que de nombreuses organisations risquent de buter. Non par manque d’IA, mais par excès de procédures conçues pour un monde où chaque étape dépendait d’un humain. GPT-5.3 Codex agit comme un révélateur : ce ne sont plus les compétences techniques qui ralentissent les projets, mais les processus, les validations et les structures de gouvernance.

Ce n’est pas la singularité. C’est plus discret, et plus structurant

Dès qu’une IA participe à sa propre amélioration, le mot “singularité” surgit. GPT-5.3 Codex n’en est pas une. Il ne s’auto-entretient pas, ne redéfinit pas ses objectifs, ne s’échappe pas du contrôle humain.

Mais il fait quelque chose de plus subtil : il réduit progressivement la part d’intervention humaine nécessaire au progrès technologique lui-même. Ce n’est pas une explosion. C’est une pente. Chaque génération arrive plus vite, coûte moins d’effort cognitif humain et automatise un périmètre plus large.

La question n’est donc pas de savoir si l’IA deviendra incontrôlable, mais à quel moment l’humain cessera d’être le moteur du progrès pour n’en devenir que le validateur.

GPT-5.3 Codex ne pense pas seul. Mais il avance désormais sans attendre. Et dans un monde où la technologie progresse à une vitesse supérieure à celle de nos cadres organisationnels, l’inaction n’est déjà plus une neutralité. C’est un choix.

Et selon vous ? À partir de quel moment une IA qui exécute, corrige et optimise devient-elle plus qu’un outil… sans pour autant être autonome ?

- Partager l'article :