CSIRO Data61 a créé un technique permettant de vacciner les algorithmes de Machine Learning contre les attaques contradictoires. Pour ce faire, les chercheurs effectuent de légères attaques afin de renforcer l’immunité du modèle…

Les chercheurs de l’organisme Data61 de la Commonwealth Scientific and Industrial Research Organisation annonce avoir développé un ensemble de techniques permettant d’immuniser les algorithmes de Machine Learning contre les cyberattaques en tout genre. La solution fonctionne de la même façon qu’un vaccin, et Data61 n’hésite pas à employer ce terme.

Comme vous le savez peut-être, les modèles de Machine Learning sont entraînés à effectuer une tâche à partir de données qui leur sont fournies. Malheureusement, un ajoutant une couche de » bruit » aux données, il est possible pour des cyberattaquants de tromper l’algorithme est de ruiner tout son entraînement en l’amenant à mal identifier les données. C’est ce qu’on appelle une » attaque contradictoire « .

Les conséquences peuvent être gravissimes. Prenons par exemple le cas d’un d’un algorithme de Machine Learning conçu pour piloter les voitures autonomes, qui s’entraîne à reconnaitre le code de la route à partir de photos. S’il est trompé par un cyberattaquant, un tel modèle pourrait finir par confondre les panneaux Stop avec les panneaux de priorité. Vous imaginerez facilement les risques encourus…

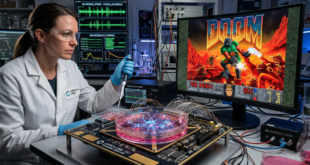

CSIRO Data61 vaccine les modèles de Machine Learning contre les attaques contradictoires

Pour protéger les modèles de Machine Learning contre de telles attaques, Data61 emploie donc une technique directement inspirée par le vaccin. Les chercheurs implémentent de légères modifications ou distorsions aux images sur lesquelles l’algorithme est entraîné, afin de rendre son ensemble de données d’entraînement plus » difficile « . Cette méthode permet de rendre les modèles plus résistants contre les attaques contradictoires.

Alors que l’intelligence artificielle et le Machine Learning permettront bientôt à l’humanité de relever les plus grands défis sociaux, économiques et environnementaux, il est important de prendre des mesures pour exploiter ces technologies de façon sécurisée et positive. C’est pourquoi cette technique développée par Data61 pourrait représenter une grande avancée pour le futur de l’IA…

https://www.youtube.com/watch?v=Tw_okFNQ_8g

- Partager l'article :