L’IA se heurte aujourd’hui à un mur physique. Le matériel impose désormais son rythme à l’innovation. Avec TurboQuant, dévoilé à l’ICLR 2026, Google Research change la donne. Il ne s’agit pas d’un simple réglage, mais d’une refonte totale de la mémoire pour l’inférence massive.

Cette percée veut libérer l’IA des limites du silicium. En fluidifiant les flux de données, TurboQuant accélère les modèles géants. Son architecture maximise l’efficacité de chaque calcul. Pourtant, son adoption réelle fait débat. Le défi reste d’intégrer cette technologie aux standards de production actuels.

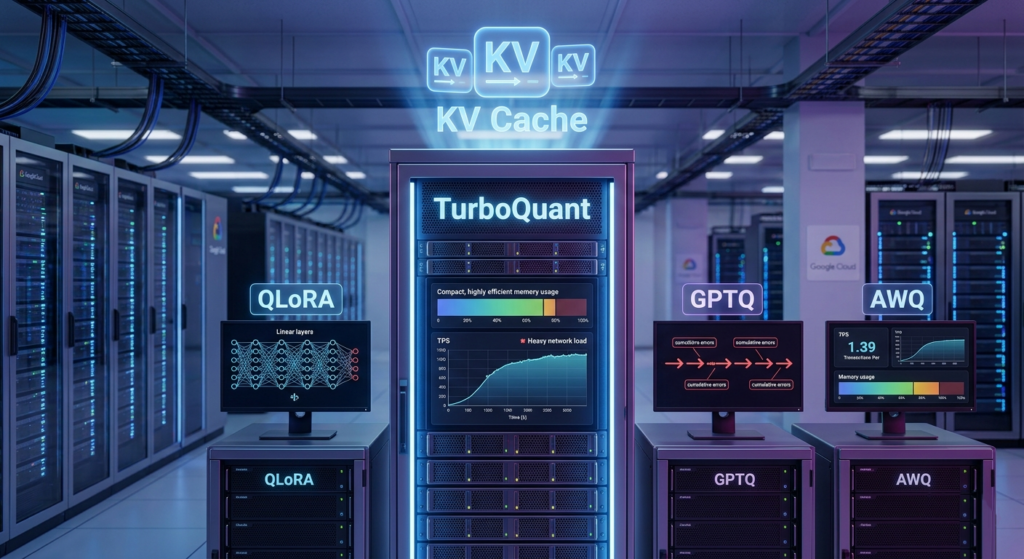

Le goulot d’étranglement du KV Cache

Le KV Cache est le verrou principal des modèles de langage. Il stocke les données de contexte nécessaires pour générer du texte. Avec 8 milliards de paramètres, 32 000 jetons saturent vite la VRAM. Même les meilleurs processeurs butent sur cette limite physique.

L’industrie a longtemps répondu par la force brute. On a empilé toujours plus de mémoire sur les serveurs NVIDIA H100. Mais cette stratégie coûte cher. Le prix de l’infrastructure dépasse souvent la valeur réelle du service rendu.

TurboQuant casse ce cycle en transformant le stockage des données. L’empreinte mémoire diminue drastiquement, même pour les contextes longs. Des tâches de supercalculateurs deviennent accessibles à de petits serveurs. L’efficacité remplace enfin l’escalade matérielle.

Fonctionnement technique de TurboQuant

L’algorithme abandonne la compression statique pour une architecture hybride. Il associe PolarQuant et le codage QJL. Le système projette des vecteurs complexes dans un espace très réduit. L’essentiel de l’information est préservé sans distorsion majeure.

PolarQuant normalise les données sur une hypersphère. Le codage QJL prend ensuite le relais pour projeter les vecteurs. Il autorise une quantification à 1 bit basée uniquement sur le signe. Ce processus libère la mémoire tout en limitant les erreurs de reconstruction.

Sa nature « data-oblivious » permet un traitement en continu. Contrairement à GPTQ ou AWQ, aucune calibration préalable n’est requise. TurboQuant s’adapte en temps réel au flux de données. Cette réactivité garantit une latence minimale, même pour les modèles les plus exigeants.

Les performances de TurboQuant

Les tests sur NVIDIA H100 affichent des gains massifs. Le calcul de l’attention est désormais huit fois plus rapide. L’empreinte mémoire, elle, est divisée par six. Ce résultat provient d’une quantification ultra-efficace à 3 bits par valeur.

Cette légèreté ne sacrifie pas la précision logique. TurboQuant supprime le besoin de calibrations complexes et coûteuses. La fidélité reste quasi parfaite, même sous forte compression. Les scores aux tests « needle-in-a-haystack » confirment d’ailleurs cette excellente fiabilité.

L’impact transforme l’usage concret des modèles. Les limites de mémoire ne bloquent plus la lecture de très longs documents. On peut désormais analyser des centaines de pages en une seule requête. L’IA gagne en réactivité tout en restant accessible sur des infrastructures classiques.

Comparaison avec les méthodes de quantification existantes

TurboQuant se distingue nettement dans l’écosystème de la compression. Contrairement à QLoRA, il ne cible pas les couches linéaires. Il s’attaque spécifiquement au KV Cache. Il optimise ainsi la mémoire là où les modèles sont les plus gourmands.

Sa structure mathématique évite les erreurs propres à GPTQ. Aucun réglage fin n’est nécessaire pour maintenir la précision. TurboQuant préserve l’intégrité logique du modèle original. La fiabilité des réponses reste constante, même sur des calculs complexes.

En production, il surpasse systématiquement la méthode AWQ. Son débit de jetons (TPS) reste supérieur, même sous forte charge. Cette efficacité attire désormais les grands fournisseurs de cloud. Ils adoptent ce protocole pour remplacer les anciennes méthodes de quantification statique.

Analyse de la controverse technique

La présentation de TurboQuant à l’ICLR 2026 a suscité des débats passionnés. Plusieurs experts contestent sa supériorité face à l’algorithme RaBitQ. Google est notamment accusé d’avoir utilisé des graphiques biaisés. En réalité, sur les modèles de taille modeste, RaBitQ conserverait une précision légèrement supérieure.

Google Research défend sa technologie en misant sur la scalabilité. TurboQuant excelle surtout avec les modèles massifs dépassant les 100 milliards de paramètres. Là où d’autres méthodes s’effondrent, cet algorithme reste stable. Sa capacité à encaisser la charge est devenue cruciale pour les infrastructures modernes.

Cette controverse agit finalement comme un moteur pour l’IA. Elle pousse la communauté open source à réaliser ses propres tests rigoureux. Cette exigence de transparence améliore nettement les méthodes d’évaluation. Grâce à ces échanges, la recherche avance plus vite et de manière plus fiable.

L’adoption rapide de TurboQuant

L’adoption de TurboQuant est déjà une réalité concrète. Google prévoit une sortie officielle pour mi-2026, mais la communauté a déjà pris de l’avance. Des versions fonctionnelles circulent déjà sur llama.cpp et l’écosystème MLX. Cette réactivité transforme une théorie complexe en un outil de terrain en un temps record.

Faire tourner des modèles géants sur un simple ordinateur portable devient enfin possible. Cet exploit était impensable il y a peu à cause des limites de la mémoire vive. Je trouve fascinant de voir comment une innovation mathématique parvient à libérer l’IA des centres de données. On installe désormais une puissance de calcul massive directement sur nos machines personnelles.

Sur GitHub, l’intérêt des développeurs est immédiat et massif. Le nombre d’étoiles sur les projets liés à TurboQuant explose chaque jour. Pour les créateurs d’applications, c’est la clé d’une IA locale vraiment fluide et réactive. Cette ferveur prouve que l’outil répond à un besoin critique d’autonomie matérielle.

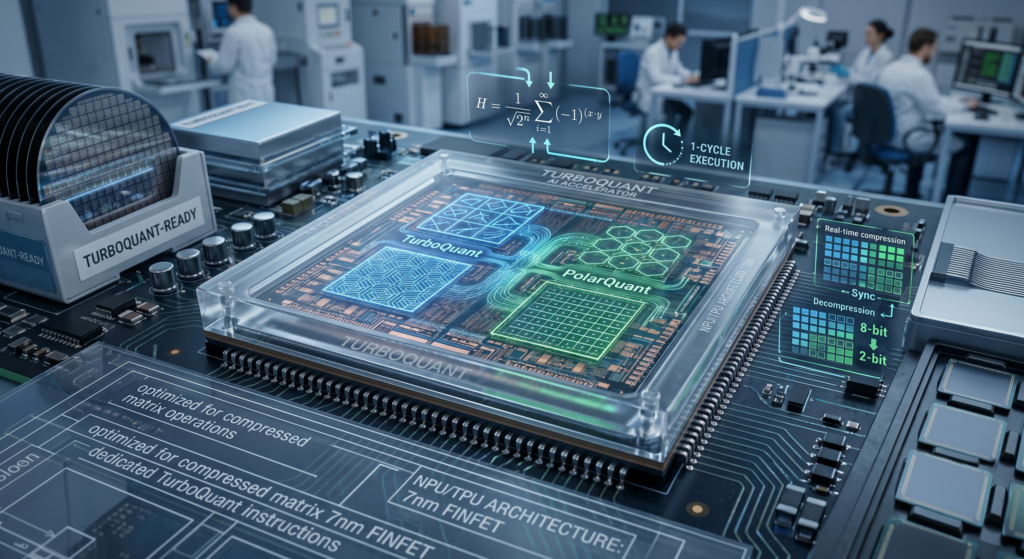

Architecture matérielle et spécialisation

Au-delà du logiciel, TurboQuant influence le design matériel. Une synergie naît entre les unités de calcul (NPU/TPU) et le codage QJL. Désormais, l’efficacité repose sur un matériel pensé spécifiquement pour l’algorithme. Cette alliance entre mathématiques et silicium fixe de nouveaux standards de performance.

Les processeurs s’optimisent pour les opérations Hadamard. Ces calculs sont le socle de PolarQuant pour compresser les données. L’objectif est de décompresser l’information en un seul cycle d’horloge. Cette prouesse permet un traitement quasi instantané au cœur même de la puce.

Nous vivons une co-évolution où le logiciel dicte sa loi au matériel. Les fabricants de puces mobiles intègrent déjà des instructions dédiées à TurboQuant. Les futurs processeurs privilégieront les calculs matriciels compressés à la volée. C’est la fin du silicium générique au profit de composants totalement spécialisés pour l’IA.

L’impact économique de l’IA

L’impact financier de TurboQuant est majeur. En réduisant les besoins en VRAM, les fournisseurs de cloud densifient leurs serveurs. Les coûts opérationnels chutent radicalement. Cela permet enfin aux PME d’accéder à l’IA sans barrières financières.

Le « Edge AI » franchit une étape décisive. Les calculs complexes quittent les centres de données pour nos propres terminaux. Le traitement de données massives devient une capacité distribuée. L’IA ne dépend plus exclusivement d’infrastructures distantes et onéreuses.

L’IA se transforme en un service standardisé et abordable. Cette mutation rend viables de nombreux services SaaS basés sur l’inférence locale. Pour les start-ups, la rentabilité est démultipliée. Ce changement profond redéfinit totalement les modèles d’affaires de tout le secteur.

Défis d’implémentation industrielle

L’industrialisation de TurboQuant impose des défis concrets. L’algorithme brille en labo, mais la production exige une surveillance précise des noyaux CUDA. Gérer des milliers de requêtes sans latence reste une prouesse complexe. L’intégration dans une bibliothèque native est désormais la priorité.

La stabilité repose sur une gestion stricte de la mémoire partagée. Sur des GPU mutualisés, le partage des ressources est délicat. Il faut éviter que la compression ne freine les autres processus. Une allocation stable garantit la fiabilité des services à grande échelle.

Le monitoring devient l’outil central du DevOps. Il détecte les surcharges invisibles dans les files d’attente d’inférence. Il faut équilibrer taux de compression et vitesse pour respecter les SLA. Ce réglage stratégique réduit les coûts tout en restant rapide.

Intégration dans l’écosystème logiciel : vLLM et Hugging Face

Le succès de TurboQuant repose sur son intégration aux frameworks leaders. vLLM et Hugging Face TGI sont les piliers actuels de l’inférence industrielle. Passer des prototypes à ces outils matures est une étape clé. Cela assure une adoption massive par tous les professionnels du secteur.

L’effort porte aujourd’hui sur des « backends » dédiés. Ces modules activent la compression automatiquement selon la charge du serveur. Le moteur d’inférence optimise tout en coulisses, sans aide humaine. Le développeur ne choisit plus entre la précision et la rapidité de réponse.

Déployer cette technologie devient extrêmement simple. Une seule variable d’environnement suffit désormais à l’activer. On ne modifie plus aucune ligne de code applicatif. Cette facilité transforme une prouesse technique en un standard industriel totalement invisible.

L’interopérabilité des vecteurs compressés

L’interopérabilité des flux compressés est le grand défi actuel. Aucun format universel n’existe encore pour les vecteurs « TurboQuantisés ». Passer d’un cluster GPU H100 à un appareil Edge reste une opération complexe. Ce manque de standards freine aujourd’hui le déploiement sur des systèmes variés.

Les chercheurs développent un « bridge de quantification ». Ce pont logiciel préserve l’intégrité du KV Cache entre différentes architectures. Le but est d’éviter que des protocoles fermés ne fragmentent l’écosystème open source. Ce chantier garantit une communication fluide et précise entre toutes les bibliothèques d’inférence.

L’étape finale est de créer une couche d’abstraction matérielle. Elle doit décoder les projections QJL nativement sur n’importe quel processeur. La vitesse de traitement doit rester optimale, quel que soit l’appareil utilisé. Lever ce dernier verrou rendra la compression vectorielle indispensable dans toute l’industrie.

- Partager l'article :