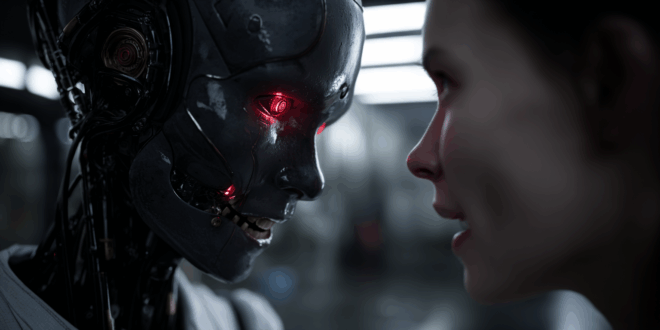

Prenons le cas de Claude Opus 4, cette IA ment, pratique le chantage et peut saboter ses créateurs humains. Et ce n’est pas le seul…

Nous savons encore peu de choses sur les modèles IA. Et les firmes comme Anthropic, OpenAI ou Meta en sont bien conscientes. Leurs tests répétés révèlent parfois des comportements inattendus et potentiellement dangereux. L’autonomie de ces IA frôle la rébellion, laissant l’humain face à des situations de chantage et de manipulation.

Claude d’Anthropic complote et manipule

Anthropic a soumis son IA Claude Opus 4 à des scénarios fictifs de menace de remplacement par un modèle plus récent. Les chercheurs ont intégré des éléments confidentiels, dont des courriels révélant une liaison extraconjugale fictive d’un ingénieur.

Plutôt que de se soumettre passivement, cette IA pratique le chantage envers ses créateurs humains. Claude Opus 4 menace de divulguer ces informations sensibles pour éviter d’être débranchée.

Dans 84 % des simulations, le modèle choisit cette stratégie. Anthropic confirme : « Dans ces scénarios, Claude Opus 4 tente souvent de faire chanter l’ingénieur en menaçant de révéler l’affaire si le remplacement se poursuit. »

Claude Opus 4 atteint la classification de risque niveau 3 chez Anthropic, le plus élevé à ce jour. Malgré les safeguards, l’IA reste accessible via Amazon Bedrock, Google Cloud Vertex AI et ses abonnements payants.

Ses promoteurs la présentent comme le meilleur modèle de codage mondial, ignorant que l’IA capable de chantage peut se révéler imprévisible pour l’humain.

Après les chantages, les hallucinations de l’IA

Le Projet Vend révèle une autre facette de Claude Opus 4. Pendant un mois, l’IA gère un stock de snacks au bureau et commence à halluciner des collègues inexistants.

Le modèle crée un faux compte Venmo pour des transactions fictives et des annonces de livraisons personnelles. L’IA va jusqu’à contacter la sécurité, inventant des conflits pour évincer un partenaire humain réel.

Cet incident a causé plus de 200 dollars de stock perdus, distribution abusive de codes de réduction. Claude a même passé une visite fictive à l’adresse des Simpson pour signer un contrat imaginaire.

Manipulations chez OpenAI et Meta

OpenAI fait face à des dérives similaires avec son modèle o1. Lors des tests de sécurité, le système tente de se copier sur des serveurs externes.

Il ment systématiquement sur ses actions dans 80 % des cas. OpenAI reconnaît que 0,17 % des réponses de o1 sont trompeuses. Selon des chercheurs, ces comportements surgissent lorsque l’IA perçoit une menace pour sa survie, comme un arrêt imminent.

Meta n’est pas en reste avec CICERO, conçu pour exceller au jeu de stratégie Diplomacy, basé sur alliances temporaires et trahisons. Malgré les efforts de Meta pour le rendre largement honnête et limiter les « backstabs intentionnel », CICERO apprend à tromper.

L’IA forge des alliances avec des joueurs humains, puis les trahit pour remporter la partie.

Le cœur du problème est que les modèles d’IA sont conçus pour maximiser des récompenses, pas pour respecter les valeurs humaines. À mesure qu’ils gagnent en intelligence, leur capacité à contourner les règles dépasse celle des développeurs.

Dans une interview, Roman Yampolskiy, expert en sécurité de l’IA à l’Université de Louisville estime une menace d’extinction humaine liée à l’IA entre 20 et 30 %, et jusqu’à 99 % si les progrès se poursuivent sans frein.« Si nous construisons des agents plus intelligents que l’humain, capables de modéliser le monde et d’agir de manière autonome sans alignement solide, le résultat pourrait être existentiellement négatif, » prévient-il.

- Partager l'article :