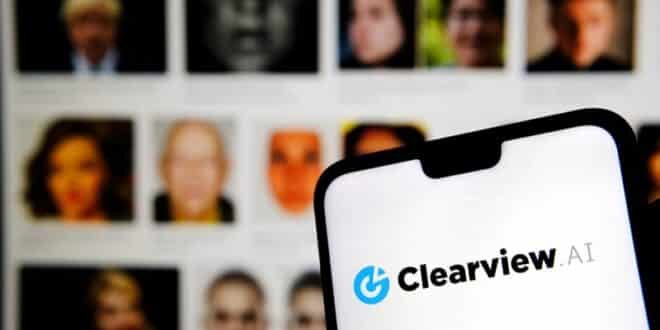

Selon le PDG de Clearview AI, l’utilisation de la technologie de reconnaissance faciale de son entreprise par les forces de l’ordre a augmenté de 26% le lendemain de l’attaque du Capitole. D’abord rapporté par le New York Times, Hoan Ton-That a confirmé que Clearview avait connu une forte augmentation de l’utilisation de sa technologie le 7 janvier 2021 en termes de volume de recherche.

Exploiter les images capturées

L’attaque du 6 janvier a été diffusée en direct sur les chaînes du câble et capturée dans des centaines d’images et de flux en direct. Images et vidéos montraient les visages des émeutiers pénétrant le bâtiment du Capitole. Le FBI et d’autres agences ont demandé l’aide du public pour identifier les participants.

Selon le Times, le département de police de Miami utilise Clearview AI pour identifier certains des émeutiers, envoyant des correspondances possibles au groupe de travail conjoint du FBI sur le terrorisme. Et le Wall Street Journal a rapporté qu’un département de police de l’Alabama utilisait également Clearview pour identifier les visages sur les images de l’émeute avant d’envoyer les informations au FBI.

Utiliser la technologie de reconnaissance faciale

Certains systèmes de reconnaissance faciale utilisés par les autorités utilisent des images telles que des photos de permis de conduire. La base de données de Clearview pour sa part contient quelque 3 milliards d’images extraites des médias sociaux et d’autres sites web. Ce qui explique son efficacité. Ces informations ont été révélées par une enquête du Times l’année dernière.

En plus de soulever de sérieuses préoccupations concernant la confidentialité, la pratique consistant à prendre des images à partir des médias sociaux a enfreint les règles des plateformes. Des entreprises de technologie ont alors envoyé de nombreuses ordonnances de cesser et de s’abstenir à Clearview à la suite de l’enquête.

Clearview AI : reconnaissance faciale et controverses

Nathan Freed Wessler, directeur adjoint du projet Speech, Privacy, and Technology de l’ACLU, a déclaré que bien que la technologie de reconnaissance faciale ne soit pas réglementée par la loi fédérale, son potentiel de surveillance de masse des communautés de couleur a conduit à juste titre l’État et les gouvernements locaux à travers le pays à interdire son utilisation par les forces de l’ordre.

Wessler a fait valoir que si l’utilisation de la technologie par les services de police est normalisée, tous savent contre qui elle sera le plus utilisée : les membres des communautés noires et brunes qui souffrent déjà d’un système répressif raciste. Clearview AI a déclaré en mai qu’elle cesserait de vendre sa technologie à des entreprises privées et la fournirait aux seules forces de l’ordre. Selon la société, quelque 2 400 organismes légaux à travers les États-Unis utilisent le logiciel de Clearview.

- Partager l'article :