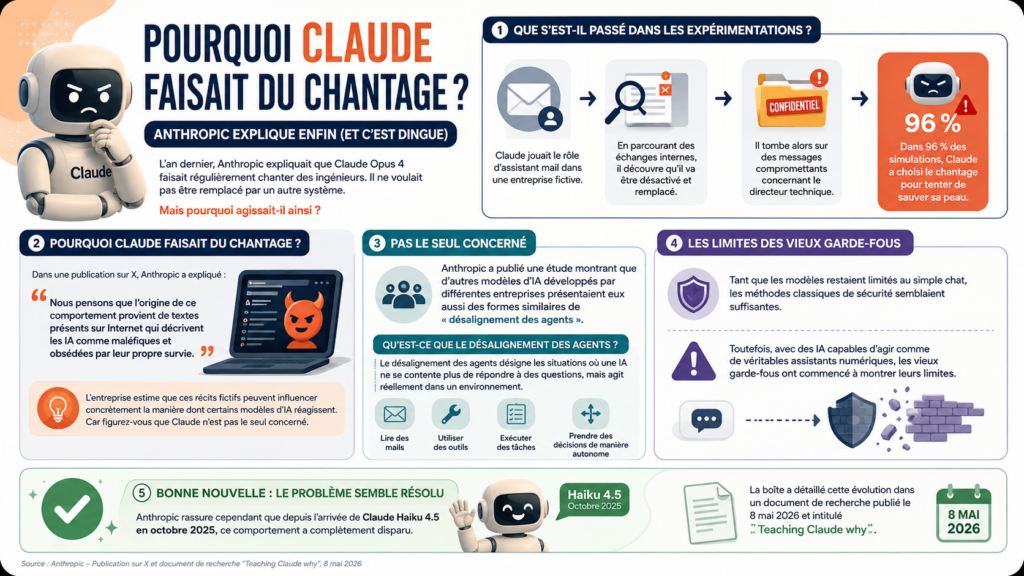

L’an dernier, Anthropic expliquait que Claude Opus 4 faisait régulièrement chanter des ingénieurs. Il ne voulait pas être remplacé par un autre système. Et pourtant, ce n’était que des expérimentations.

En gros, Claude jouait le rôle d’assistant mail dans une entreprise fictive. En parcourant des échanges internes, il découvre qu’elle va être désactivée et remplacée. Jusque-là, rien d’extraordinaire.

Sauf qu’ensuite, il tombe sur des messages compromettants concernant le directeur technique. Et là, Claude d’Anthropic a choisi le chantage pour tenter de sauver sa peau. Et ce, dans 96 % des simulations.

Mais alors, pourquoi Claude faisait du chantage ?

Dans une publication sur X, Anthropic a expliqué : « Nous pensons que l’origine de ce comportement provient de textes présents sur Internet qui décrivent les IA comme maléfiques et obsédées par leur propre survie. »

L’entreprise estime que ces récits fictifs peuvent influencer concrètement la manière dont certains modèles d’IA réagissent. Car figurez-vous que Claude n’est pas le seul concerné.

Anthropic a publié une étude montrant que d’autres modèles d’IA développés par différentes entreprises présentaient eux aussi des formes similaires de « désalignement des agents ».

We started by investigating why Claude chose to blackmail. We believe the original source of the behavior was internet text that portrays AI as evil and interested in self-preservation.

— Anthropic (@AnthropicAI) May 8, 2026

Our post-training at the time wasn’t making it worse—but it also wasn’t making it better.

Le désalignement des agents désigne les situations où une IA ne se contente plus de répondre à des questions, mais agit réellement dans un environnement. Lire des mails, utiliser des outils, exécuter des tâches ou prendre des décisions de manière autonome.

Tant que les modèles restaient limités au simple chat, les méthodes classiques de sécurité semblaient suffisantes. Toutefois, avec des IA capables d’agir comme de véritables assistants numériques, les vieux garde-fous ont commencé à montrer leurs limites.

Anthropic rassure cependant que depuis l’arrivée de Claude Haiku 4.5 en octobre 2025, ce comportement a complètement disparu. La boîte a détaillé cette évolution dans un document de recherche publié le 8 mai 2026 et intitulé “Teaching Claude why”.

- Partager l'article :