Google Chrome serait en train de télécharger discrètement un modèle d’IA d’environ 4 Go sur les ordinateurs des utilisateurs. Selon une analyse relayée par un chercheur en sécurité, cela se fait sans avertissement ni consentement explicite.

Alexander Hanff, connu sous le pseudonyme « That Privacy Guy » est le chercheur à l’origine de cette découverte. Et d’après lui, le téléchargement s’effectuerait en arrière-plan.

Le fichier en question est baptisé « weights.bin ». Et il serait lié à un système d’IA embarqué basé sur Gemini Nano, le modèle allégé développé par Google.

Et si votre Google Chrome a déjà téléchargé l’IA ?

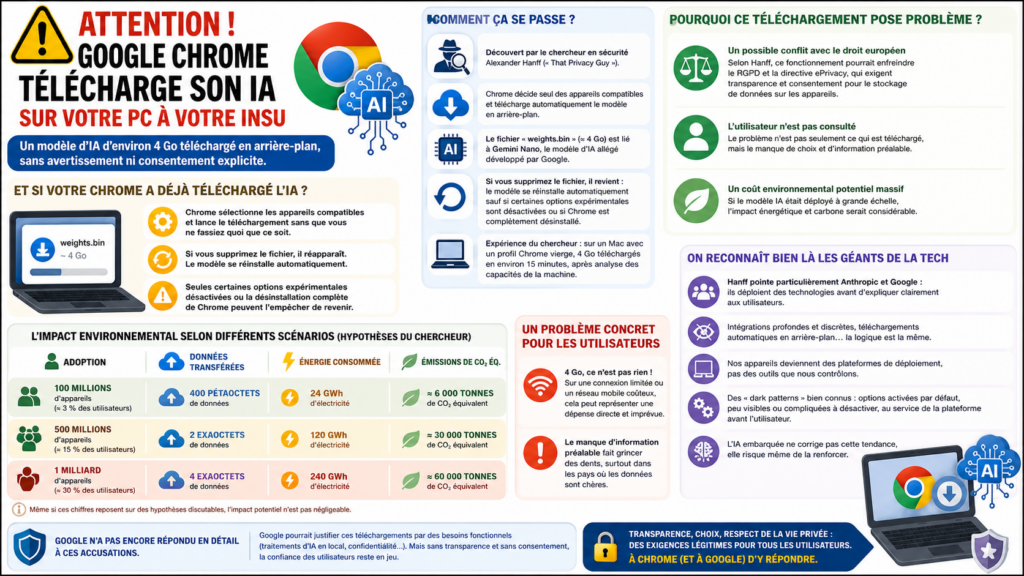

Selon les observations du chercheur, Google Chrome décide lui-même quels appareils sont compatibles et déclenche automatiquement le téléchargement de l’IA. Cela, sans que vous fassiez quoi que ce soit.

Et si vous supprimez le fichier, mauvaise nouvelle : celui-ci aurait tendance à revenir tout seul. Hanff explique que le modèle se réinstalle automatiquement. À moins que certaines options expérimentales ne soient désactivées ou si Chrome est complètement désinstallé.

Pour vérifier ses soupçons, le chercheur a mené une expérience sur un Mac avec un profil Chrome vierge. D’après ses relevés système, le navigateur aurait créé le dossier du modèle puis téléchargé les 4 Go en arrière-plan

Le tout en une quinzaine de minutes, alors que l’ordinateur semblait simplement inactif. Chrome aurait aussi analysé les capacités de la machine avant de lancer le téléchargement. Ce qui d’après lui confirme le fait que Google lance une sélection automatique des appareils compatibles.

En quoi ce téléchargement pourrait poser problème ?

Hanff estime que ce fonctionnement pourrait entrer en conflit avec les règles européennes. Notamment celles du RGPD et de la directive ePrivacy, qui encadrent strictement le stockage de données sur les appareils et exigent une transparence claire.

Pour lui, le problème n’est pas seulement ce qui est téléchargé. C’est surtout le fait que l’utilisateur ne soit pas réellement consulté. Dans le même temps, il évoque aussi l’impact environnemental.

À hauteur de 100 millions d’appareils, soit environ 3 % des utilisateurs, par exemple, le transfert représenterait 400 pétaoctets de données. Cela réprésente une consommation énergétique d’environ 24 GWh et près de 6 000 tonnes d’équivalent CO₂.

Si l’on passe à 500 millions d’appareils, soit environ 15 % des utilisateurs, les volumes explosent avec 2 exaoctets de données transférées. 120 GWh d’énergie consommée. Et environ 30 000 tonnes de CO₂ équivalent.

Enfin, à l’échelle d’un milliard d’appareils, soit environ 30 % des utilisateurs de Chrome, les chiffres atteignent 4 exaoctets de données. 240 GWh d’électricité utilisée. Et près de 60 000 tonnes d’équivalent CO₂.

Vous comprenez donc que si le fichier liée au modèle IA de Chrome était déployée à l’échelle mondiale, l’impact est non négligeable. Ce, même si ces chiffres reposent sur des hypothèses discutables.

Un autre problème touche directement les utilisateurs. Voyez-vous, un téléchargement de 4 Go peut sembler banal avec une connexion fibre illimitée. Cependant, il devient beaucoup plus problématique sur des forfaits limités ou des réseaux mobiles coûteux.

Dans certains pays, cela peut même représenter une dépense directe et imprévue. Et là encore, le manque d’information préalable fait grincer des dents.

On reconnaît bien là les géants de la tech

Dans l’ensemble, cette affaire s’ajoute à une série de critiques visant les grandes entreprises technologiques. Hanff pointe particulièrement du doigt Anthropic et Google.

Pour lui, ils avancent leurs technologies avant toute explication claire aux utilisateurs, qui découvrent ensuite les effets de ces choix.

Qu’il s’agisse d’intégrations profondes et discrètes dans le système, comme avec Claude Desktop, ou du téléchargement automatique de modèles d’IA en arrière-plan, la logique reste la même.

Les appareils des utilisateurs deviennent peu à peu des plateformes de déploiement plutôt que des outils réellement contrôlés par leurs propriétaires. Cette idée peut sembler dure, mais elle rejoint des critiques anciennes sur les « dark patterns » dans les logiciels.

Certaines fonctionnalités sont conçues pour servir la plateforme avant l’utilisateur. Elles sont activées par défaut, peu visibles dans les paramètres ou volontairement compliquées à désactiver.

D’après l’analyse de Hanff, l’arrivée de l’IA embarquée ne corrige pas cette tendance, elle risque même de la renforcer.

De son côté, Google n’a pas encore répondu en détail à ces accusations. L’entreprise pourrait justifier ces téléchargements sur Chrome par des besoins fonctionnels. Notamment pour permettre des traitements d’IA en local, censés améliorer la confidentialité.

- Partager l'article :