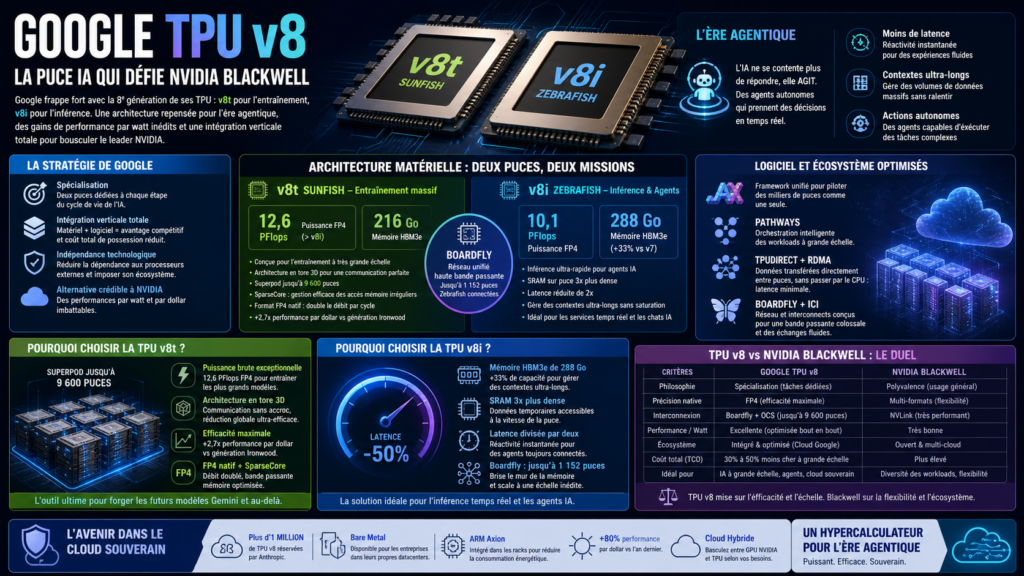

Google franchit un cap technique majeur avec le lancement de la Google TPU v8. Cette nouvelle puce est prévue pour dominer le marché de l’IA. Cette huitième génération se divise en deux versions distinctes, la v8t et la v8i. L’objectif de la firme est de répondre aux exigences spécifiques de l’entraînement et de l’inférence. La firme veut à tout prix imposer son rythme face aux solutions de NVIDIA.

L’annonce de la Google TPU v8 le 22 avril 2026 marque l’entrée officielle dans ce que Google nomme l’ère agentique. Cela arrive au moment où les modèles ne se contentent plus de discuter mais agissent concrètement. La course à la puissance brute finit par se heurter au mur de la mémoire, mais cette puce semble enfin briser ce plafond de verre.

Grâce à une architecture repensée, elle offre des gains de performance par watt qui laissent songeur. Google mise sur une intégration verticale totale pour réduire sa dépendance aux processeurs externes. Ainsi, la bataille contre les puces Blackwell de NVIDIA ne se joue pas seulement sur les téraflops. Cela repose sur l’efficacité globale du réseau Boardfly qui relie ces milliers de puces entre elles.

La stratégie Google TPU v8 face à la concurrence de NVIDIA

Google change radicalement de braquet depuis l’évènement Google Cloud Next 2026 avec la puce TPU v8. Le géant américain veut s’imposer sur le marché avec cette technologie IA qui scinde son architecture pour la première fois. La firme propose alors deux puces distinctes pour répondre à une nécessité de spécialisation. Plus précisément, vous pouvez profiter de la v8t pour l’entraînement et de la v8i pour l’inférence. À vrai dire, cette approche permet de briser le « mur de la mémoire » qui freine les modèles actuels. C’est pourquoi le géant du cloud cherche à offrir une alternative crédible aux GPU NVIDIA Blackwell.

La stratégie de Google repose principalement sur l’ère agentique. C’est un concept où l’IA ne se contente plus de répondre mais agit de manière autonome. Toutefois, une infrastructure sur-mesure devient indispensable pour que ces agents fonctionnent sans latence. Google mise alors sur une intégration verticale totale. Le fait d’avoir le matériel et le logiciel donne un avantage compétitif indéniable sur le coût total de possession. On peut dire que cette autonomie technologique est leur meilleure arme pour garder les clients dans leur écosystème.

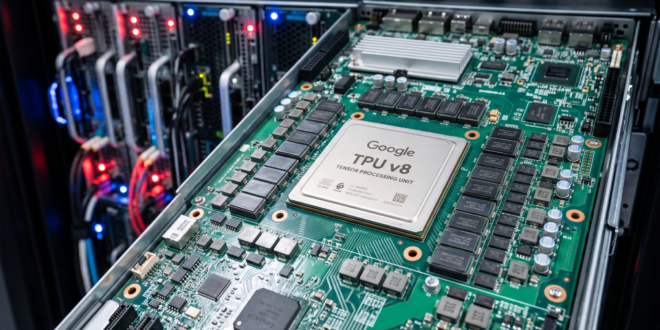

Architecture matérielle de la Google TPU v8 : comprendre v8t et v8i

Comme vous le savez déjà, cette nouvelle puce se décline en deux variantes. La marque vise ici à optimiser chaque étape du cycle de vie de l’IA. Pour cela, la TPU v8t, surnommée Sunfish est une bête de somme destinée à l’entraînement. D’un autre côté, la v8i, ou Zebrafish, s’occupe de l’inférence. Grâce à son architecture, la v8t affiche une puissance brute de 12,6 Pflops en précision FP4. Elle peut surpasser les 10,1 Pflops de sa petite sœur dédiée à l’exécution.

Par ailleurs, la v8i n’est pas en reste avec sa mémoire SRAM trois fois plus dense que la génération précédente. Celle-ci intègre 288 Go de mémoire HBM3e, contre 216 Go pour la version entraînement, pour gérer des contextes ultra-longs sans ramer. Notez que Google a intégré le réseau Boardfly qui permet de connecter jusqu’à 1 152 puces Zebrafish entre elles. À première vue, la v8t semble plus puissante. Pourtant, la v8i est cruciale pour l’interactivité des agents IA. Ainsi, cette dernière brise le goulot d’étranglement de la mémoire pour offrir une latence divisée par deux.

Logiciels et IA agentique optimisés par la Google TPU v8

Cette nouvelle puce ne se contente pas d’aligner des composants performants. Elle s’appuie en même temps sur une pile logicielle totalement intégrée. Le secret réside en grande partie dans l’utilisation de JAX et Pathways. Ces frameworks permettent de piloter des milliers de puces comme s’il s’agissait d’une seule entité. Sans cette couche, la gestion des Superpods deviendrait un cauchemar technique. En réalité, Google a conçu cette architecture pour l’ère agentique, où les programmes doivent prendre des décisions en temps réel.

Grâce à l’intégration de TPUDirect et du protocole RDMA, les données circulent sans passer par le processeur central. Par ailleurs, cela réduit la latence lors des communications entre les nœuds. C’est pourquoi les développeurs soulignent l’efficacité des workflows JAX avec cette nouvelle génération. Mais il faut aussi noter que cette optimisation logicielle favorise la montée à l’échelle des modèles les plus gourmands. Finalement, l’infrastructure réseau Boardfly travaille main dans la main avec les interconnects ICI pour fluidifier les échanges.

Pourquoi choisir la Google TPU v8t pour l’entraînement massif ?

La Sunfish est la réponse brutale de Mountain View aux besoins de calcul titanesques. Il faut savoir que son architecture en tore 3D n’est pas là pour faire joli. Effectivement, elle permet une communication parfaite entre les 9 600 puces d’un Superpod. Grâce à cette topologie, les opérations de réduction globale indispensables au parallélisme de données s’exécutent sans le moindre accroc. Google annonce un gain de performance de 2,7 x par dollar par rapport à la génération Ironwood. C’est pourquoi elle devient l’outil privilégié pour forger les futurs modèles Gemini.

En réalité, la force de cette puce réside dans l’utilisation native du format FP4. En passant du 8 bits au 4 bits pour les calculs matriciels, cette Google TPU double le débit par cycle. Cela permet de réduire la taille des tenseurs de travail et de libérer de la bande passante mémoire. Par contre, il ne faut pas oublier le SparseCore. Ce composant spécialisé gère efficacement les accès mémoire irréguliers. C’est ce genre de détail qui évite les goulots d’étranglement que l’on observe souvent sur des processeurs moins spécialisés.

Notez les performances de la Google TPU v8i dans l’inférence des agents

Pourquoi la version Zebrafish est-elle indispensable pour les nouveaux services connectés ? Elle élimine les attentes interminables grâce à une bande passante mémoire colossale. Plus précisément, Google TPU v8i possède une mémoire HBM3e de 288 Go qui représente une hausse majeure par rapport au passé. Cette puce cible en réalité les agents qui doivent jongler avec des contextes très longs. De cette manière, la latence se trouve divisée par deux selon les mesures officielles. Il faut savoir que cette réactivité change complètement l’expérience utilisateur sur les outils de chat.

D’ailleurs, l’ajout d’une mémoire SRAM sur puce trois fois plus dense aide à stocker les données temporaires sans ralentir le flux. En outre, la vraie magie opère avec le réseau Boardfly. Ce dernier permet de relier plus d’un millier de processeurs. Google parvient alors à briser le mur de la mémoire qui bride souvent les processeurs plus classiques. Certes, NVIDIA propose des solutions puissantes. Mais, l’intégration de la Google TPU v8i dans l’écosystème Cloud offre une fluidité difficile à égaler. Par conséquent, le déploiement de modèles comme Gemini devient beaucoup plus rentable pour les entreprises.

Comparaison technique entre Google TPU v8 et NVIDIA Blackwell

Comment situer la puissance de la puce Google face au monstre Blackwell de NVIDIA ? En principe, c’est un duel entre la force brute polyvalente et la spécialisation chirurgicale. Blackwell affiche souvent des pics de performance plus élevés sur le papier. Toutefois, la force de Google réside dans son architecture en essaim. Grâce au réseau Boardfly et à la commutation optique (OCS), la Google TPU v8 peut faire travailler 9 600 puces simultanément.

Par contre, la différence majeure se joue sur la précision des données. Tandis que NVIDIA brille par sa flexibilité sur de nombreux formats. La Google TPU v8 mise tout sur le FP4 natif pour exploser les scores d’efficacité. Mais ne vous y trompez pas, car Blackwell reste le roi incontesté du multi-cloud. Choisir Google, c’est accepter un écosystème fermé en échange de performances par watt imbattables. En principe, le choix d’un professionnel se résume au TCO (Coût Total de Possession). Par conséquent, produire de l’IA à grande échelle coûte souvent 30% à 50% moins cher sur une infrastructure TPU.

Quel avenir pour la Google TPU v8 dans le cloud souverain ?

Où cette nouvelle puce de Google se place-t-elle par rapport à ses rivaux comme l’AWS Trainium ou les solutions Microsoft ? Le géant américain mise en grande partie sur l’hyperspécialisation. En principe, l’accord massif avec Anthropic, qui prévoit d’utiliser plus d’un million de puces, prouve que la demande est là. Dans la pratique, cette infrastructure ne serait plus réservée aux seuls ingénieurs de Google. Plus précisément, la firme commence à proposer ses puces en mode « bare metal ». Son objectif est de permettre aux entreprises d’installer la Google TPU v8 dans leurs propres centres de données. D’une manière général, ce changement de stratégie vise à briser l’hégémonie de NVIDIA sur les serveurs physiques.

De plus, l’intégration des processeurs ARM Axion dans les mêmes racks permet de réduire encore plus la consommation électrique globale. Par conséquent, la performance par dollar fait un bond de 80% par rapport à l’année dernière. Mais ne vous égarez pas, car la force de Google réside aussi dans son cloud hybride. En général, les utilisateurs peuvent basculer entre des GPU NVIDIA pour la flexibilité et des TPU pour le passage à l’échelle. De ce fait, l’écosystème devient un « Hypercalculateur » capable de gérer n’importe quel workload agentique sans sourciller.

- Partager l'article :