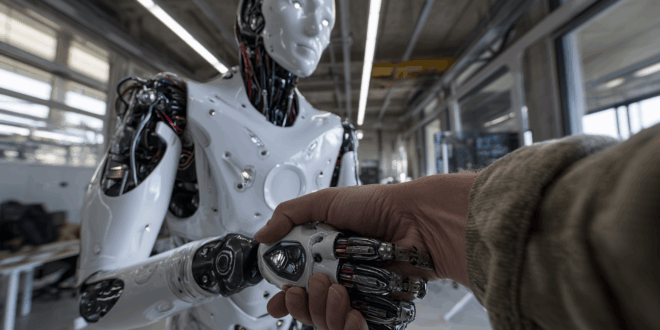

Figure AI fait face à sa première crise majeure. Un ex-responsable sécurité accuse la startup d’avoir ignoré des alertes sur la dangerosité de ses humanoïdes et d’avoir maquillé un plan de sûreté avant une levée à 39 milliards de dollars. La plainte ouvre un débat inédit : que se passe-t-il quand la course au robot généraliste dépasse les exigences de sécurité ?

L’un des piliers de la sécurité interne de Figure AI attaque la startup en justice. Robert Gruendel, ex-responsable produit et sécurité, affirme avoir été licencié après avoir alerté la direction sur la puissance réelle des humanoïdes de l’entreprise.

La plainte tombe à un moment délicat pour Figure : deux mois seulement après une levée qui a propulsé sa valorisation à 39 milliards de dollars. L’affaire risque d’ébranler l’image d’une société devenue l’un des symboles de la course mondiale au robot généraliste…

Ce que dit l’ex-responsable sécurité

Selon le témoignage déposé auprès d’un tribunal californien, Gruendel a adressé plusieurs avertissements formels à Brett Adcock et à Kyle Edelberg.

Il décrit des machines capables de causer des blessures graves en cas de défaut de contrôle, évoquant un épisode où un robot aurait entaillé une porte de réfrigérateur en acier à la suite d’un dysfonctionnement.

Il affirme que ces alertes ont été accueillies comme des obstacles plutôt que comme des obligations, jusqu’à un licenciement soudain justifié par un “changement de direction”.

La réponse de Figure

La startup rejette l’ensemble des accusations. Elle affirme que Gruendel a été renvoyé pour “mauvaise performance” et considère ses déclarations comme mensongères.

Dans sa communication officielle, Figure insiste sur la rigueur de ses protocoles de test et son objectif de construire des robots sûrs tels que le Figure 03.

L’écart entre cette version et les tensions décrites dans la plainte crée un contraste marquant entre l’image publique de l’entreprise et son fonctionnement interne supposé.

Le point sensible : un safety plan modifié avant la levée

La plainte prend une autre dimension lorsqu’elle accuse Figure d’avoir présenté à des investisseurs un plan de sécurité “vidé” de certains éléments essentiels.

Gruendel soutient que les parties les plus importantes de son document avaient été retirées avant la réunion décisive, et que cette version édulcorée pourrait avoir influencé la levée de fonds.

Il évoque même la possibilité que cette modification soit interprétée comme une dissimulation, un terrain juridique particulièrement risqué aux États-Unis lorsqu’il touche à des risques matériels liés à un produit.

Un signal pour toute l’industrie de l’humanoïde

Au-delà du cas Figure, cette affaire marque un tournant. Jusqu’ici, les polémiques autour de l’IA concernaient principalement les dérives algorithmiques.

La plainte de Gruendel ramène la discussion à la sécurité physique de machines capables d’évoluer dans des environnements humains.

Les précédents existent déjà dans le monde industriel, mais les humanoïdes modernes, plus polyvalents et plus puissants, transportent ces risques dans des contextes beaucoup moins confinés. L’enjeu de normes claires et de cadres réglementaires devient désormais central.

Le procès qui s’ouvre pourrait donc devenir la première véritable affaire de lanceur d’alerte autour d’un robot généraliste.

Il mettra en lumière la culture interne de Figure, ses méthodes de gestion des incidents, et la transparence de ses échanges avec les investisseurs.

L’entreprise, devenue l’une des plus rapides du secteur, devra désormais prouver qu’elle avance avec la même rigueur sur le terrain discret mais essentiel de la sécurité et de la responsabilisation…

Et vous, qu’en pensez-vous ? Le risque qu’un robot humanoïde se mette à dysfonctionner et briser les os d’un humain est-il réel ? Partagez votre avis en commentaire !

- Partager l'article :