Si vous suivez nos articles, vous êtes sûrement au courant qu’OpenAI travaille en coulisses sur un réseau social pas comme les autres. Il est pensé pour chasser définitivement les bots.

Mais voilà. Nous avons de nouvelles informations à propos de ce fameux réseau social d’OpenAI. Et il paraît que l’accès y est compliqué. Car, pour discuter entre humains, il faudrait d’abord prouver que l’on en est bien un.

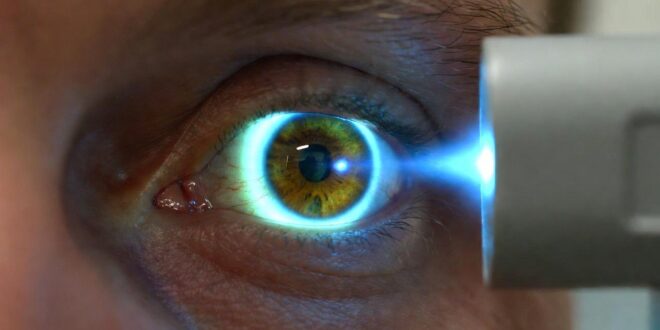

L’accès pourrait donc passer par une vérification biométrique poussée, incluant potentiellement un scan de l’iris.

Que savons-nous sur ce fameux réseau social ?

Selon un rapport publié par Forbes, qui s’appuie sur des sources anonymes proches du projet, cette plateforme en est encore à un stade très précoce. Le développement serait assuré par une équipe réduite, composée de moins de dix personnes.

Comme dit tout haut, l’ambition affichée est de créer un réseau social exclusivement humain, débarrassé des robots conversationnels et des faux comptes automatisés. Et pour garantir cette authenticité, OpenAI envisage plusieurs méthodes de vérification d’identité.

Parmi elles, l’utilisation de Face ID d’Apple est évoquée, mais aussi une solution bien plus radicale. Il s’agirait de l’Orb, un appareil de reconnaissance oculaire à l’apparence dérangeante. Cet outil a été développé par une entreprise fondée par Sam Altman lui-même, le PDG d’OpenAI.

De la taille d’un ballon de football, il scanne l’iris des utilisateurs. En échange, ces derniers reçoivent un identifiant numérique unique, stocké directement sur leur téléphone.

En théorie, ce mécanisme permettrait d’écarter les bots d’IA dans des contextes variés. Ce qui peut aller des jeux en ligne aux réseaux sociaux, voire à certaines transactions financières sensibles.

Sur le papier, la promesse est séduisante. Cela dit, dans la réalité, l’adoption reste très limitée. À ce jour, environ 17 millions de personnes ont été vérifiées grâce à l’Orb. Ce chiffre est très éloigné de l’objectif affiché par l’entreprise, qui vise un milliard d’utilisateurs à terme.

Qu’est-ce qui freine l’adoption d’Orb

Plusieurs raisons l’expliquent, à commencer par des contraintes logistiques importantes. D’abord, pour se faire scanner les yeux, les utilisateurs doivent se rendre physiquement dans l’un des centres de vérification officiels.

On en compte actuellement 674 dans le monde. Aux États-Unis, seuls 32 centres sont disponibles, dont une majorité située en Floride. Cette obligation de déplacement constitue un frein évident, surtout pour un service censé toucher un public mondial.

Au-delà de la logistique, l’aspect psychologique joue aussi un rôle majeur. L’idée de confier ses données biométriques, et plus précisément un scan oculaire, à une entreprise liée à l’une des figures les plus controversées de la Silicon Valley ne rassure pas.

Beaucoup y voient une intrusion excessive dans la vie privée, difficile à justifier pour un simple accès à un service numérique. Et je dois dire que ces craintes ne sont pas infondées.

Plusieurs pays ont déjà pris des mesures à l’encontre de cette technologie biométrique. Certains ont temporairement interdit son déploiement, tandis que d’autres ont ouvert des enquêtes officielles.

Les autorités invoquent des préoccupations sérieuses concernant la protection des données personnelles et les risques liés à leur sécurité à long terme.

Une lueur d’espoir à l’horizon

Malgré ces obstacles, cette technologie pourrait désormais trouver un nouveau terrain d’expérimentation. D’après Forbes, le futur réseau social d’OpenAI permettrait aux utilisateurs de créer et de partager du contenu généré par l’IA.

Images, vidéos et autres formats créatifs seraient au cœur de l’expérience proposée, dans un environnement présenté comme authentiquement humain. Et puis, OpenAI a déjà démontré sa capacité à lancer des produits grand public à succès.

ChatGPT rassemble aujourd’hui près de 700 millions d’utilisateurs hebdomadaires. De son côté, l’application vidéo basée sur l’IA de l’entreprise a franchi le cap du million de téléchargements en seulement cinq jours après son lancement.

Évidemment, cela n’empêche que le défi reste immense. La concurrence sur le terrain des réseaux sociaux est féroce. Meta, par exemple, a annoncé que ses plateformes, incluant Facebook, Instagram et WhatsApp, totalisent environ 3,5 milliards d’utilisateurs actifs quotidiens.

Ces services proposent déjà des outils de création de contenu généré par l’IA, sans exiger de scan oculaire pour s’inscrire. OpenAI semble néanmoins parier sur un argument différenciant : l’absence de bots.

La promesse d’un espace numérique plus authentique, où chaque interaction provient d’un véritable humain, pourrait séduire une partie du public. Reste à savoir si cet avantage suffira à compenser les contraintes imposées par une vérification biométrique intrusive.

Sauver le web après l’avoir automatisé : la logique de Sam Altman

Sam Altman ne cache pas sa lassitude face à la prolifération des bots en ligne. En septembre déjà, il a réagi à une publication montrant des commentaires élogieux sur le subreddit ClaudeCode, dédiés à Codex. L’agent de programmation d’OpenAI.

Il a avoué avoir d’abord pensé que tout était faux ou automatisé, avant de reconnaître que la croissance de Codex était bien réelle. Dans ce même message publié sur X, Altman s’est interrogé sur l’origine de ce phénomène.

Il a évoqué des comportements linguistiques étranges, comparables à ceux d’étudiants en master. Ce, tout en soupçonnant fortement la présence de bots. D’après lui, le résultat donne l’impression que Twitter et Reddit sont devenus artificiels, bien plus qu’il y a un ou deux ans.

Quelques jours plus tôt, Altman avait déjà ironisé sur la fameuse théorie de « l’internet mort ». Il expliquait ne jamais l’avoir prise au sérieux. Pour autant, il note une prolifération suspecte de comptes semblant gérés par des profils très similaires.

Cette théorie affirme que depuis 2016, une large partie d’internet serait dominée par des bots et du contenu généré artificiellement. D’où ce réseau social complètement à l’abri des bots.

Ironie du sort, Sam Altman cherche à résoudre un problème qu’il a largement contribué à créer. Avec d’autres figures majeures de l’intelligence artificielle, il a participé à l’essor de technologies capables de générer du contenu à une échelle inédite.

Résultat, les bots envahissent désormais forums, réseaux sociaux et espaces de discussion. Ainsi, une question demeure. Faut-il vraiment confier la mission de sauver l’authenticité d’internet à ceux qui ont accéléré son automatisation ?

Vous par exemple. Qu’est-ce que vous en dites ? Partagez votre avis dans le commentaire !

- Partager l'article :