Les derniers modèles d’OpenAI arrivent directement dans Amazon Bedrock, la plateforme d’IA d’AWS déjà utilisée par des millions d’organisations. Ainsi, les deux géants resserrent leur partenariat pour capter les projets d’IA les plus stratégiques en entreprise.

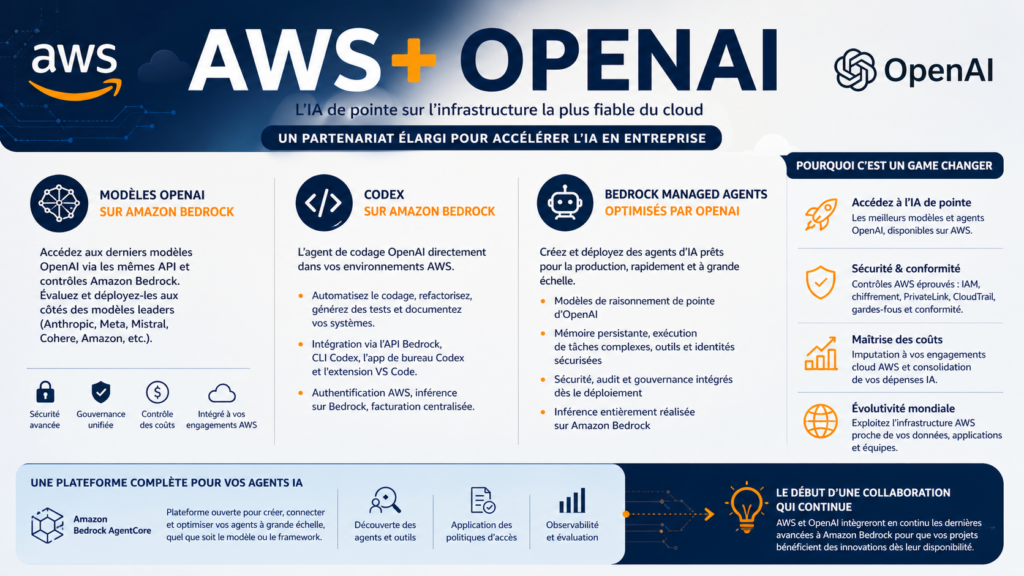

L’intégration des modèles d’OpenAI dans AWS Bedrock ouvre un accès direct à une IA avancée pour des millions d’organisations déjà clientes du cloud. Avec, le lancement de Codex et des Bedrock Managed Agents, le groupe américain accélère donc sa stratégie. AWS veut faire de son infrastructure le point d’entrée unique pour concevoir, déployer et gouverner des applications d’IA en production.

AWS Bedrock unifie l’accès aux modèles OpenAI et aux autres leaders du marché

Pour la première fois, les entreprises peuvent accéder aux modèles OpenAI directement depuis Bedrock. Sans changer d’environnement ni multiplier les outils. Ainsi, les équipes peuvent utiliser les modèles OpenAI via les mêmes API, les mêmes mécanismes de gouvernance et les mêmes outils que ceux déjà utilisés pour d’autres modèles disponibles sur Bedrock. Et ils sont nombreux, Anthropic, Meta, Mistral AI ou encore Cohere cohabitent déjà dans cet environnement.

🚨 BIG NEWS from #WhatsNextWithAWS: Amazon announced a major expansion of our partnership with @OpenAI.

— Amazon (@amazon) April 28, 2026

Starting today, @awscloud and OpenAI are bringing the latest OpenAI models to Amazon Bedrock, launching Codex on Amazon Bedrock, and launching Amazon Bedrock Managed Agents,… https://t.co/AsOoTnXPsg

Les entreprises ne veulent plus dépendre d’un seul fournisseur d’IA. Désormais, elles cherchent à tester, comparer et choisir le modèle le plus adapté à chaque usage. Qu’il s’agisse de génération de texte, d’analyse ou d’automatisation.

Avec cette intégration, AWS vend l’IA avec une couche d’orchestration unifiée qui absorbe les innovations les plus avancées sans remettre en cause l’existant. C’est précisément ce qui manquait jusqu’ici à de nombreuses organisations pour passer du test à la production.

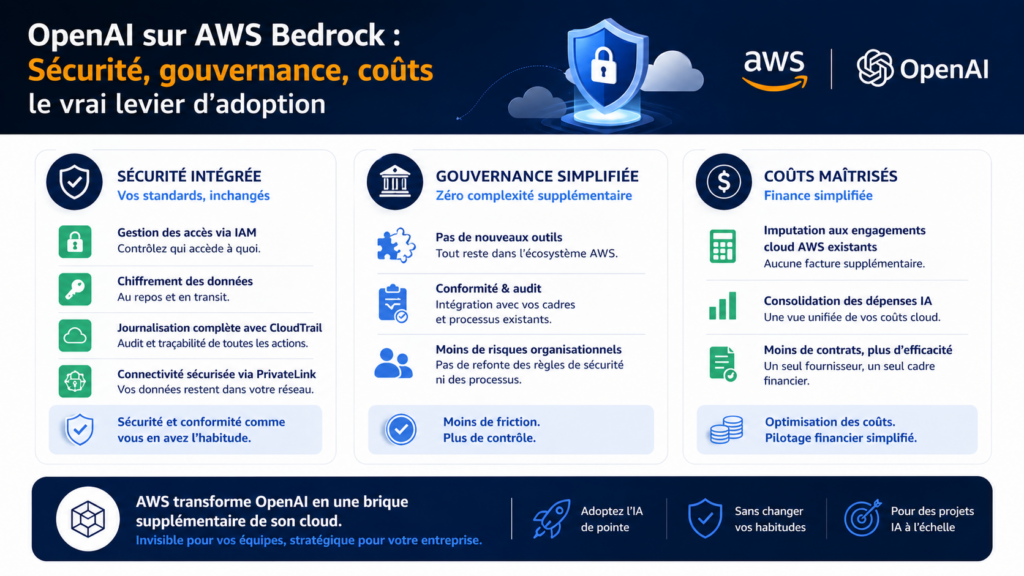

Une intégration sans compromis sur la sécurité et la conformité

Si les modèles OpenAI attirent, ce sont les garanties d’AWS qui rassurent. Et c’est là que se joue une grande partie de cette annonce. Ainsi, les entreprises peuvent utiliser les modèles OpenAI et conserver leurs standards habituels.

Gestion des accès via IAM, chiffrement des données, journalisation complète avec CloudTrail, connectivité sécurisée via PrivateLink… Rien ne change dans la manière de gérer la sécurité ou la conformité.

Dans de nombreux projets IA, la difficulté n’est pas technologique, mais organisationnelle. Ajouter un nouveau fournisseur implique souvent de revoir les règles de sécurité, les processus d’audit ou les modèles de facturation. Ici, tout reste intégré dans l’écosystème AWS.

La consolidation des coûts est également un autre avantage important. Les usages OpenAI peuvent être imputés directement aux engagements cloud AWS existants. Pour les grandes entreprises, cela simplifie la gestion financière et évite la multiplication des contrats.

Automatiser le développement logiciel avec Codex sur Bedrock

Parlons maintenant de l’arrivée de Codex sur Bedrock. Cet agent de codage est déjà utilisé par plus de 4 millions de personnes chaque semaine. Il fait donc son entrée dans les environnements AWS.

Pour les équipes techniques, Codex permet d’automatiser des tâches de développement, de générer du code, de refactoriser des applications existantes ou encore de produire des tests. Mais surtout, il s’intègre dans les outils du quotidien, comme Visual Studio Code ou une interface en ligne de commande.

Avec cette intégration, les entreprises peuvent utiliser Codex sans sortir de leur infrastructure. L’authentification passe par les identifiants AWS, les traitements sont réalisés via Bedrock, et la facturation reste centralisée.

Ce détail change beaucoup de choses. Les équipes de développement doivent accélérer la livraison et aussi maîtriser les coûts. Ainsi, disposer d’un agent IA intégré à l’environnement cloud devient un avantage compétitif. Ici, on passe d’un outil externe à une capacité native du système d’information.

Passer du prototype à des agents IA opérationnels en entreprise

Mais le cœur stratégique de cette annonce se situe dans les Bedrock Managed Agents optimisés par OpenAI. Jusqu’ici, créer un agent IA réellement opérationnel nécessitait d’assembler de nombreux composants. Notamment, mémoire, gestion des identités, orchestration des tâches, infrastructure de calcul. Ce processus complexe est souvent réservé aux équipes les plus avancées.

Earlier this year, OpenAI and @amazon partnered to bring OpenAI’s frontier capabilities to enterprises, startups, and customers around the world.

— OpenAI Newsroom (@OpenAINewsroom) April 28, 2026

We’re taking the next step: making our models, Codex, and Bedrock Managed Agents available to @awscloud customers, in limited…

AWS propose ici des agents prêts pour la production, qui combine les capacités de raisonnement d’OpenAI avec l’infrastructure d’AWS. Ces agents peuvent exécuter des tâches complexes, multi-étapes, avec un minimum d’intervention humaine. Ils disposent d’une mémoire persistante et peuvent intégrer des procédures métier. Ils peuvent également s’appuyer sur des mécanismes de sécurité intégrés.

Chaque agent fonctionne avec sa propre identité, enregistre ses actions et s’exécute dans l’environnement du client. L’ensemble est conçu pour répondre aux exigences d’audit et de conformité des grandes organisations. Ainsi, l’IA agentique devient un composant industrialisable du système d’information.

AWS devient la plateforme centrale pour déployer l’IA en production

Avec ce partenariat renforcé, AWS ne cherche pas seulement à héberger des modèles. Il veut devenir la plateforme de référence pour déployer des systèmes d’IA complets. En intégrant les modèles OpenAI, en facilitant l’usage de Codex et en industrialisant également les agents, AWS couvre toute la chaîne de valeur, du modèle à l’application métier.

Pour les entreprises, l’intérêt est évident. Elles peuvent expérimenter rapidement, déployer à grande échelle et intégrer l’IA dans leurs processus. Et cela sans multiplier les outils ni complexifier leur architecture.

Des acteurs comme Box, qui accompagne plus de 115 000 organisations, y voient déjà un levier pour transformer les usages. Des agents capables d’apprendre en continu, d’adapter leurs réponses et de s’intégrer dans des workflows existants.

Cette intégration renforcera-t-elle la dépendance à AWS ? Probablement. Mais elle simplifie l’accès à une IA avancée sans sacrifier la maîtrise opérationnelle. C’est une attente forte du marché.

Comme le souligne l’annonce officielle publiée sur Amazon, ce n’est qu’un début. AWS et OpenAI prévoient d’intégrer en continu les dernières avancées dans Bedrock. Les entreprises qui l’adoptent aujourd’hui pourraient bénéficier automatiquement des prochaines générations de modèles et d’agents.

- Partager l'article :