C’est sans doute pour aider ceux qui traversent des moments de détresse sans oser en parler qu’OpenAI a lancé la fonction Trusted Contact dans ChatGPT. Car l’entreprise sait qu’au cœur des périodes les plus sombres, le soutien des proches reste souvent le plus précieux.

C’est vrai que des IA comme ChatGPT sont devenues des compagnons du quotidien pour beaucoup d’utilisateurs. On y parle de travail, d’études, mais aussi parfois de solitude, de ruptures ou de conflits familiaux. Sauf qu’à un moment, discuter avec une machine ne suffit plus. C’est précisément là que la fonction Trusted Contact dans ChatGPT entre en jeu. Avec cette fonction, OpenAI veut permettre aux utilisateurs de garder un lien humain dans les situations les plus délicates. Puisque derrière l’écran et les réponses générées par l’IA, il y a parfois une vraie détresse. Et dans ces moments-là, un proche attentif peut faire bien plus qu’un chatbot.

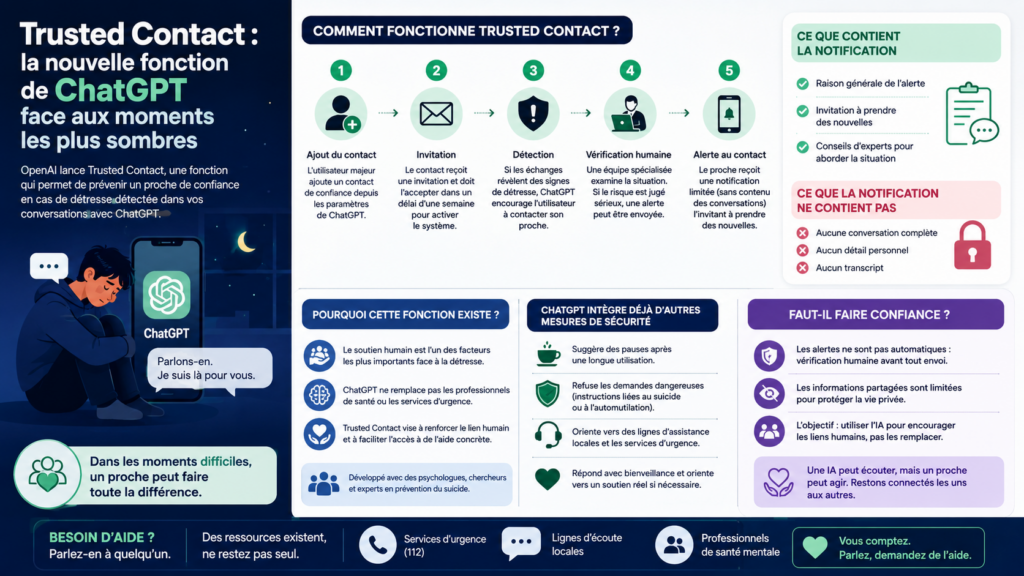

Comment fonctionne Trusted Contact dans ChatGPT ?

Le fonctionnement repose sur plusieurs étapes. Les utilisateurs majeurs peuvent ajouter un contact depuis les paramètres de ChatGPT. La personne désignée doit ensuite accepter l’invitation pour activer le système.

Ensuite, tout s’appuie sur les mécanismes de détection d’OpenAI. Si les échanges avec ChatGPT révèlent des signes jugés préoccupants, l’utilisateur est d’abord encouragé à contacter lui-même cette personne de confiance. Ce n’est qu’après une vérification humaine qu’une alerte peut être envoyée.

OpenAI précise que les notifications restent limitées. Aucun transcript complet des conversations n’est transmis. Le message envoyé explique seulement qu’une situation inquiétante a été détectée et invite le proche à prendre des nouvelles.

En principe, la société tente donc d’éviter le scénario dystopique où une IA balance l’intégralité de vos confidences nocturnes à votre entourage. Ce qui aurait probablement déclenché quelques migraines collectives du côté des défenseurs de la vie privée.

Faut-il faire confiance à cette nouvelle fonction ?

C’est probablement la question que beaucoup d’utilisateurs vont se poser. Car même si Trusted Contact a été conçu pour renforcer la sécurité, la fonction pourrait inquiéter certains utilisateurs. L’idée qu’une IA analyse des conversations personnelles pour détecter une détresse met forcément mal à l’aise.

OpenAI tente toutefois de rassurer sur plusieurs points. Comme mentionner plus haut, l’entreprise explique que les alertes ne sont pas envoyées automatiquement au moindre message inquiétant. Avant toute notification, une vérification humaine est réalisée afin d’éviter les erreurs les plus grossières. Les messages envoyés au contact de confiance restent aussi très limités et ne contiennent pas les conversations complètes de l’utilisateur.

En plus, OpenAI assure avoir travaillé avec des psychologues, chercheurs et experts en prévention du suicide pour développer Trusted Contact. L’objectif ? Utiliser l’IA comme un outil capable d’encourager les liens humains plutôt que de les remplacer.

Bref, avec Trusted Contact, ChatGPT continue doucement de quitter le rôle d’outil conversationnel. L’IA devient un produit qui tente aussi de gérer des situations émotionnelles complexes. Et c’est précisément là que le sujet devient sensible.

Depuis plusieurs mois, OpenAI multiplie d’ailleurs les dispositifs liés au bien-être numérique. Le chatbot peut déjà suggérer aux utilisateurs de faire une pause après une longue utilisation. Il est aussi capable de refuser certaines demandes dangereuses et d’orienter les personnes vers des lignes d’assistance locales.

- Partager l'article :