A l’heure où les échanges se multiplient à l’échelle internationale, le besoin de traduction se fait sentir de plus en plus. A ce titre, Google a lancé son outil de traduction automatique bridé. Très critiqué pour son manque de performance à ses débuts, Google traduction s’est nettement amélioré au fur et à mesure des années.

Focus sur Google Tr1duction

Google Translate en anglais ou Google Traduction en français est avant tout un programme de traduction automatique neuronale multilingue. De fait, certains internautes se trompent et recherchent Google Tr1duction à la place. Dans tous les cas, la mission de cet outil se résume à la traduction de documents notamment des textes ou des pages web dans différentes langues. Celui-ci est alors disponible via une interface de site ainsi que sous forme d’application mobile compatible aux appareils iOS et Android. Google propose même une interface de programmation d’applis pour soutenir les développeurs dans la conception d’applications logicielles et d’extensions de navigateur.

A ses débuts, Google tr1duction exploitait des documents fournis soit par le Parlement européen soit par les Nations Unies. Etant donné que la traduction directe n’était pas encore possible, il était nécessaire de passer par l’anglais avant de traduire à nouveau vers la langue souhaitée. La recherche des modèles se faisait à travers des millions de documents. Ce n’est qu’une fois ces modèles repérés que le programme pouvait organiser les mots et en faire une traduction. Malheureusement, les résultats n’étaient pas concluants et l’appli fût pointé du doigt à de nombreuses reprises.

Néanmoins, la donne change complètement quelques années plus tard. Le géant américain décide de passer à un moteur de traduction automatique neuronale ou GNMT. Plutôt que de prendre les mots et expressions un à un, des phrases complètes sont traduites. Des réajustements sont réalisés pour avoir une traduction pertinente et surtout acceptable pour un être humain.

Historique de l’outil Google

Les débuts du service Google Translate datent d’avril 2006. Des extraits de textes aux médias, et ce, en passant par les pages d’un site internet, les traductions prennent différentes formes. A l’époque, l’outil se résumait à un service de traduction automatique statistique. Celui-ci exprimait les données en anglais avant de les retranscrire en allemand ou en portugais. On notera que ce service restait médiocre notamment en matière de suivi des règles grammaticales.

2010 marque, quant à lui, le déploiement d’une application Android, en plus de la version iOS. Le service d’interprétation pouvait alors être accessible via mobile. Compatible avec les navigateurs tels que Chrome, ce programme pouvait dès lors repérer les mots et textes de langues jusque-là méconnues.

Une nette amélioration de la traduction vocale et visuelle est, par ailleurs, observée en 2014. En rachetant Word Lens, Google a permis à son service google tr1duction « de numériser du texte ou une image à l’aide de l’appareil et de le faire traduire instantanément ». Non seulement, le système peut détecter automatiquement les langues étrangères, mais il est aussi capable de traduire la parole, et ce, sans que l’utilisateur n’appuie sur le bouton de son microphone à maintes reprises.

En 2016, que Google a opté pour un système baptisé « traduction automatique neuronale ». Ce dernier constitue une véritable innovation vu qu’il met en avant des techniques d’apprentissage en profondeur dans sa fonction de traduction. En tout cas, des phrases entières sont traduites et les résultats sont largement meilleurs. Il n’est donc pas surprenant qu’en 2018, plus de 100 milliards de mots sont traduits en une journée.

En quoi l’IA intervient-elle dans l’amélioration de Google tr1duction ?

Depuis 2016, Google tr1duction a fait l’objet de réelles innovations. Ces dernières ont nécessairement une incidence sur l’expérience client quant aux 108 langues que le service propose. Les premières technologies à avoir contribué à ces exploits sont « la traduction automatique neuronale, les paradigmes basés sur la réécriture et le traitement sur l’appareil ».

Malgré le progrès évident du secteur, les algorithmes utilisés semblent être à la traîne par rapport au savoir-faire humain. Ce ralentissement est, par exemple, illustré par le projet Masakhane. Cette initiative a pour objectif de permettre la traduction de milliers de langues en Afrique. Aujourd’hui, ce projet n’a pourtant pas encore surpassé « la phase de collecte de données et de transcription ». On peut, par ailleurs, citer Common Voice de Mozilla. Alors que la fondation cherche à concevoir « une collection open source de données vocales transcrites » depuis juin 2017, le projet n’a pu valider que 40 langues à ce jour.

Google, lui ne s’est jamais reposé sur une seule technologie pour déployer Google Tr1duction. En effet, ce dernier met en évidence un mix de technologies « ciblant les langues à faibles ressources, les langues à hautes ressources, la qualité générale, la latence et la vitesse d’inférence globale ».

Zoom sur les modèles hybrides utilisés par Google

La première technologie IA concerne un modèle hybride constitué d’un encodeur « Transformer » ainsi qu’un décodeur de RNN (réseau neuronal récurrent) que l’on a adapté à Lingyo. De manière générale, ce sont les mots et les phrases qui sont codés. Ces représentations seront, à leur tour, utilisées en vue de produire un texte sur une langue prédéfinie.

Les modèles fondés sur Transformer qui sont apparus en 2017 sont plus performants que les technologies RNN. Google aspire cependant à ce que les gains qualitatifs proviennent de l’encodeur qui est lui-même un composant du Transformer. A l’inverse des RNN qui traitent les séquences de données dans un ordre donné, le Transformer n’a nul besoin de passer par le début avant de traduire la fin d’une phrase. Le décodeur RNN surpasse cependant son homologue en termes de vitesse.

En prenant tous ces paramètres en compte, Google a optimisé le décodeur RNN et l’a couplé à l’encodeur Transformer. C’est ainsi que les modèles hybrides à forte stabilité et à faible latence ont pu émerger. Une mise à niveau a, par ailleurs, été entreprise sur un vieux robot d’exploration. Celui-ci a pour mission de recueillir des informations à partir de livres, d’articles ou d’une recherche sur internet. Ce « nouveau mineur » intègre 14 paires de langues et exploite des vecteurs de nombres réels dans l’expression des phrases et expressions. En se focalisant sur les données les plus pertinentes, le nombre de phrases produites par le mineur a augmenté de 29 %.

Cas de l’apprentissage par transfert et des données bruyantes

Les scientifiques ont observé que le bruit présent dans les données pouvait nuire au processus de traduction. Afin de résoudre ce problème, une méthode de modélisation a alors été mise en place. Ce système a pour mission d’affecter « des notes aux exemples à l’aide de modèles entraînés tant sur des données propres que bruitées ». Ces modèles commencent pas s’entraîner sur l’intégralité des données. Petit à petit, ils le font sur d’autres catégories et sous-ensembles. Ce concept est connu sous l’appellation « Curriculum learning » dans l’univers IA.

Par ailleurs, Google a pris les langues dont les ressources sont limitées, à part. La société a ainsi procédé à la schématisation de traduction inverse. Cela accroît bien évidemment les données d’entraînement parallèles dans lesquelles langue et traduction sont liées intimement. Au-delà de tout cela, Google tr1duction utilise aujourd’hui une modélisation M4. Cet outil de pointe rend possible l’apprentissage par transfert au sein de l’application. Ainsi, les renseignements récoltés sur les langues riches en ressources comme le français peuvent être transposés à la traduction de langues à ressources limitées. Ce second groupe comprend par exemple l’hawaïen ou le yoruba. On notera, par la même occasion, que ces dernières ne possèdent que des dizaines de milliers d’exemples.

Toujours aller de l’avant

Depuis 2010, Google tr1duction n’a cessé d’afficher un progrès constant. Cela dit, la traduction automatique reste une problématique à résoudre à l’heure actuelle. L’entreprise avoue, en effet, la présence d’erreurs dans ses nouveaux modèles. Ces écarts se rapportent surtout au caractère trop littéral de la traduction, aux différents dialectes qu’une langue possède ainsi qu’à une piètre performance en ce qui concerne les langues informelles.

Pour pallier à ce souci, le géant américain a recours à sa communauté Google Tr1duction. Il s’agit d’un programme qui engage des bénévoles pour optimiser la performance des langues à ressources limitées. Le rôle de ces volontaires est de vérifier si les traductions sont bel et bien correctes. Ce programme est réalisé en parallèle aux recherches en termes d’apprentissage automatique. Les résultats sont concluants puisqu’en février, cela a permis l’ajout de 5 langues : le tatar, l’odia (oriya), le kinyarwanda, l’ouïghour et le turkmène.

Soulignons, par la même occasion, que Google n’est pas la seule société qui s’implique dans la traduction universelle. Facebook a par exemple exposé un modèle d’IA en août 2018, dans l’espoir de « surpasser les systèmes d’appariements linguistiques ». Ce n’est pas tout. Un modèle non supervisé a aussi été dévoilé par des scientifiques du Laboratoire d’informatique et d’intelligence artificielle du MIT. Cette invention est capable de traduire indirectement des extraits de textes écrits dans deux langues différentes.

En tout cas, Google exprime sa gratitude envers les chercheurs qui poursuivent leur recherche en traduction automatique dans les universités et dans le milieu industriel. Ces trouvailles auraient même permis d’« éclairer ses propres travaux ».

Google Tr1duction pour Android se prépare à Material You

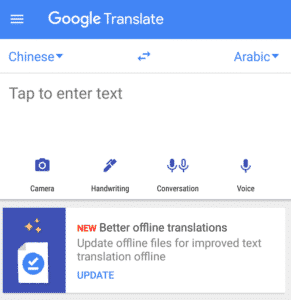

Depuis des années, l’application Google Tr1duction sur Android reste stagnante dans sa conception. Elle privilégie les anciens modèles de conception du Material Design original, plutôt que le nouveau thème Material de Google. Les changements les plus significatifs que l’app a vus ces dernières années sont l’ajout du mode sombre l’année dernière, et quelques retouches de menu en 2018.

Cependant, il a été remarqué que des travaux étaient effectués à l’intérieur de la version 6.23 de l’application. En effet, cette dernière prépare le système pour Material You, que Google appelle souvent en interne « GM3 ». L’application s’est notamment débarrassée de sa structure lourde, axée sur les tiroirs. La navigation devenait de plus en plus difficile au fur et à mesure que les téléphones devenaient plus grands.

Dans le cadre de la refonte de Material You, les choses sont désormais davantage alignées en bas, ce qui permet de placer davantage de fonctionnalités de Google Translate à portée de pouce.

Les trois alternatives à la traduction textuelle simple, Appareil photo, Conversation et Transcription, ont été déplacées vers le bas. L’application met désormais davantage l’accent sur le bouton du microphone pour sa fonction de transcription.

Dans son ensemble, cette dernière respecte les couleurs du fond d’écran, une caractéristique de la plupart des applications Material You de Google. Cette thématisation dynamique se poursuit dans la liste des langues et dans certaines parties des paramètres de l’application.

Étant donné qu’il s’agit d’un travail en cours, certains aspects de l’application n’ont pas encore été modifiés, comme le carnet d’adresses et certaines pages de paramètres et de configuration. De même, certaines parties de l’application semblent actuellement totalement absentes, comme l’historique des traductions récentes.

- Partager l'article :