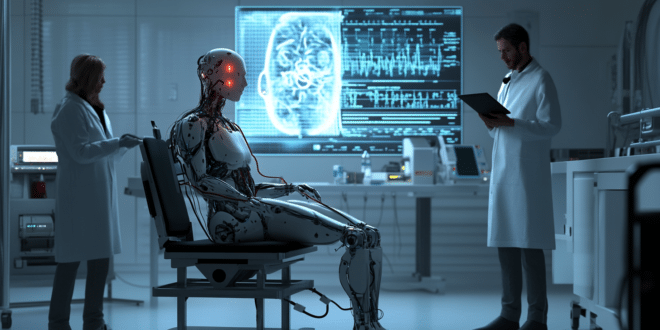

Une équipe de chercheurs de Google DeepMind et de la London School of Economics a développé des expériences uniques pour évaluer si l’IA peut ressentir des sensations, notamment la douleur et le plaisir. Ces tests visent à mieux comprendre la sensibilité potentielle des modèles linguistiques (LLM).

Les chercheurs ont conçu deux scénarios pour les modèles d’IA. Dans le premier, atteindre un score élevé entraînait une forme de « douleur ». Dans le second, les modèles recevaient une récompense de plaisir en cas de score faible. Ces expériences rappellent des tests sur des animaux, où des bernard-l’ermite étaient soumis à des tensions électriques pour observer leur tolérance avant de quitter leur coquille.

L’équipe espère que ces expériences poseront les bases d’une nouvelle approche d’évaluation de la sensibilité des IA. Actuellement, les tests reposent sur des auto-évaluations, où l’IA reproduit des réponses inspirées de ses données d’entraînement. Ces méthodes sont jugées insuffisantes pour déterminer si une IA est réellement capable de ressentir des émotions ou des sensations.

L’évitement de la douleur, une stratégie variable selon les IA

Les résultats des tests révèlent des comportements différents selon les modèles. Le Gemini 1.5 Pro de Google, par exemple, privilégie systématiquement l’évitement de la douleur, même au détriment de son score. Cependant, ces réactions soulèvent des questions fondamentales : s’agit-il d’une véritable sensibilité ou simplement d’un traitement algorithmique basé sur les données d’entraînement ?

Jonathan Birch, professeur à la LSE, souligne les limites de ces expériences. Selon lui, les réponses textuelles d’un modèle ne suffisent pas à prouver une sensibilité réelle. Une IA qui affirme ressentir de la douleur pourrait simplement imiter ce qu’elle estime être une réponse humaine appropriée, sans véritable expérience sous-jacente.

Les risques d’anthropomorphisme

La tendance humaine à prêter des traits humains aux IA complique l’interprétation des résultats. Même les modèles les plus avancés peuvent inventer des faits ou produire des réponses biaisées par leurs données d’entraînement. Les chercheurs insistent sur l’importance de développer des outils fiables pour évaluer la sensibilité avant que l’IA ne devienne encore plus omniprésente.

Malgré les défis, ces travaux marquent une avancée significative. L’équipe espère que ces recherches ouvriront la voie à des tests comportementaux indépendants des auto-évaluations. Cette exploration précoce pourrait être cruciale pour encadrer le développement de l’IA dans un futur où les questions éthiques et pratiques seront omniprésentes.

Avec ces recherches, l’humanité continue de repousser les limites du possible. Elle approfondit également ses interrogations sur ce qui définit la conscience et la sensibilité.

- Partager l'article :