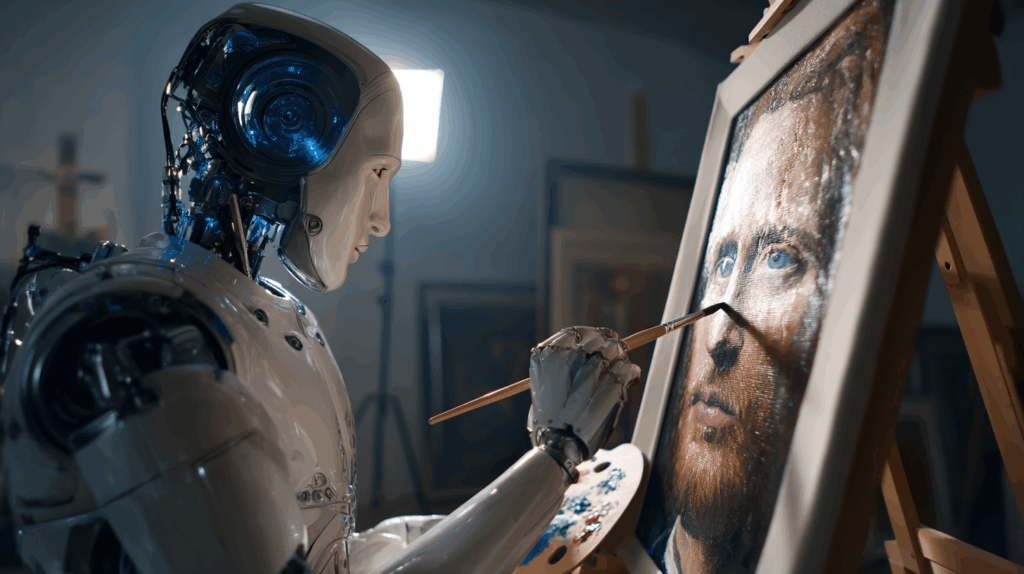

Vous pensiez vos œuvres d’art protégées des IA ? LightShed les efface comme si de rien n’était. En silence, une nouvelle technologie s’attaque à tous les outils censés empêcher l’aspiration automatique des images par les algorithmes.

Une nouvelle faille vient d’être révélée. LightShed neutralise discrètement les protections conçues pour défendre les œuvres d’art. Ce système inverse les efforts mis en place par des outils comme Glaze ou Nightshade. Des millions d’artistes pourraient voir leur travail aspiré à nouveau dans les entrailles des IA génératives.

Un antidote numérique aux poisons visuels

Pour éviter que leur style ne soit copié, les artistes avaient commencé à protéger leurs œuvres d’art avec des outils comme Glaze et Nightshade. Ces programmes insèrent des perturbations quasi invisibles qui perturbent les algorithmes d’IA. En analysant ces défenses, LightShed parvient à détecter et retirer les protections sans altérer l’image visible. « Vous ne saurez jamais si une IA a contourné vos efforts et il sera trop tard », avertit Hanna Foerster, doctorante à Cambridge.

Les chercheurs à l’origine de LightShed l’ont entraîné sur des images modifiées par Glaze, Nightshade et d’autres défenses. L’objectif ? Reconstruire précisément la couche de perturbations sans toucher au reste de l’image. Résultat : même une œuvre d’art soigneusement protégée redevient exploitable pour les modèles d’IA.

Cette capacité à effacer les protections des œuvres d’art s’applique même à des outils inconnus du système, comme Mist ou MetaCloak. C’est cette adaptabilité qui rend LightShed aussi inquiétant.

Les outils de défense sont dépassés… pour l’instant

Plus de 7,5 millions d’artistes ont déjà adopté Glaze pour protéger leurs créations en ligne. Beaucoup espéraient que ces protections suffiraient à décourager l’aspiration automatique des œuvres d’art par les IA. Mais LightShed montre que cette stratégie a ses limites. Même les développeurs de Nightshade avaient anticipé que leur outil n’était pas éternel.

Shawn Shan, créateur de ces programmes, admet : « Ce sont des obstacles temporaires, mais ils restent utiles. » Il espère que leur multiplication forcera les entreprises à collaborer avec les artistes.

Le jeu du chat et de la souris continue

Le message des chercheurs est clair : aucune solution n’est définitive. Foerster espère même aller plus loin. Son objectif est de créer de nouvelles protections qui resteraient actives même après le passage dans une IA. Des filigranes invisibles, tenaces et intégrés profondément aux œuvres d’art sont déjà envisagés. Ces futurs outils ne stopperont pas les IA pour toujours, mais ils pourraient redonner aux artistes un peu de contrôle sur leur création.

- Partager l'article :