Adoptée en mai 2025, la loi américaine Take It Down Act marque un tournant décisif dans la lutte contre la diffusion d’images intimes non consenties, qu’elles soient authentiques ou générées par intelligence artificielle. Plébiscitée par les élus de tous bords, cette législation inédite impose de nouvelles responsabilités aux plateformes numériques tout en suscitant un débat brûlant sur la liberté d’expression.

Take it down act : Une loi fédérale contre les deepfakes sexuels

En mai 2025, le Congrès américain a adopté une loi historique baptisée Take It Down Act. Cette nouvelle législation fédérale vise à lutter contre la diffusion non consentie d’images intimes. Qu’il s’agisse de photos réelles ou de montages créés à l’aide de l’intelligence artificielle.

Une loi qui marque une avancée majeure dans la protection des droits numériques des citoyens étasuniens. En particulier des femmes et des mineurs, qui sont souvent victimes de ces pratiques abusives.

Sa promulgation intervient après plusieurs affaires médiatisées impliquant des personnalités publiques comme Taylor Swift et Alexandria Ocasio-Cortez. Mais aussi des adolescentes anonymes touchées par ce phénomène croissant.

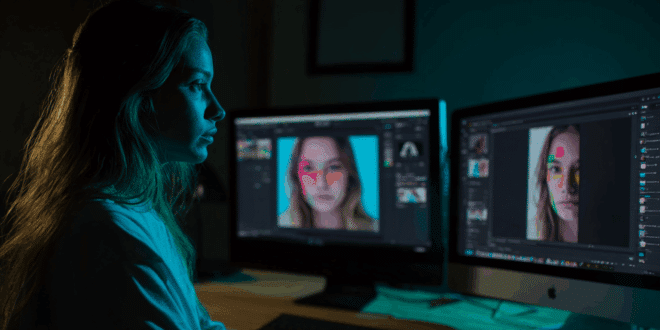

Le contexte technologique actuel joue un rôle central dans l’urgence de cette réglementation. Les outils d’intelligence artificielle permettent désormais à n’importe qui, même sans compétence technique, de générer des images sexuelles fausses en quelques secondes.

Soutenu par les élus de tous bords, démocrates comme républicains, le texte a été adopté massivement à la Chambre des représentants (409 voix pour, 2 contre) et validé sans vote formel au Sénat. Ce consensus inhabituel souligne l’ampleur du problème et la nécessité de solutions concrètes. Un consensus qui reflète également une prise de conscience générale sur les dangers des deepfakes sexuels.

Nouvelles obligations et sanctions : ce que prévoit le Take it down act

Concrètement, la loi Take It Down Act interdit expressément la publication non consentie d’images sexuelles, même celles générées par IA. Ce nouveau cadre juridique vient renforcer les protections existantes. Il offre aux victimes de deepfakes des recours concrets devant la justice américaine.

L’une des innovations centrales de la loi est l’introduction d’infractions pénales distinctes en fonction de l’âge de la victime. Par exemple, la diffusion d’un deepfake sexuel impliquant une personne mineure est traitée avec une plus grande sévérité par la loi. Avec des peines pouvant aller jusqu’à trois ans de prison.

Outre les sanctions pénales, le texte impose des obligations strictes aux plateformes numériques. Tout site web ou réseau social doit proposer un dispositif clair, visible et facilement accessible pour permettre aux victimes ou à leurs représentants de signaler un contenu illégal. Dès qu’une requête conforme est réceptionnée, le contenu en question doit être supprimé dans les 48 heures. S’ils ne respectent pas leurs obligations, ils s’exposent à des sanctions administratives de la part de la Federal Trade Commission (FTC).

La loi Take It Down Act oblige ainsi les plateformes en ligne à retirer activement certains contenus illégaux publiés par leurs utilisateurs. Alors qu’elles étaient jusqu’à présent protégées de poursuites liées à ces contenus. C’est un changement important dans la régulation des géants du numérique aux États-Unis.

Une loi qui met en péril les libertés numériques ?

Adopté avec l’objectif de lutter contre la diffusion d’images intimes non consenties, le Take It Down Act soulève pourtant des inquiétudes grandissantes parmi les défenseurs des libertés numériques. L’Electronic Frontier Foundation (EFF), notamment, alerte sur les effets collatéraux de cette législation. En cause, une définition jugée trop floue de ce qu’est une « image visuelle intime ». Définition qui pourrait englober des contenus parfaitement légitimes. Comme des photographies artistiques, des documentaires ou des images illustrant des faits divers.

Autre point sensible : le délai de 48 heures imposé aux plateformes pour retirer les contenus signalés. Jugé trop court, ce laps de temps risque de pousser les entreprises du numérique à faire du zèle. Par crainte de sanctions, certaines pourraient supprimer des contenus dès qu’ils sont signalés, sans réelle vérification. Une réaction excessive qui risquerait de porter atteinte à la liberté d’expression, en particulier celle des journalistes, artistes ou activistes, dont les travaux s’appuient parfois sur des images fortes, dérangeantes ou politiquement engagées.

Le texte, en l’état, ne prévoit par ailleurs aucun garde-fou contre les abus de signalement. Un contenu parfaitement légal peut ainsi être visé à tort par un utilisateur mal intentionné. Et dans un contexte de pression réglementaire, les plateformes pourraient céder à ces signalements infondés, au détriment de la légitimité du contenu initial. Une brèche qui ouvre la voie à une censure arbitraire.

Enfin, la modération automatisée, souvent privilégiée par les géants du web pour des raisons de rapidité, pourrait accentuer le problème. Les algorithmes peinent encore à faire la distinction entre contenu illicite et expression artistique ou informative. Résultat : un risque bien réel de suppression massive et injustifiée de contenus, avec des conséquences directes sur le débat public et la pluralité des voix en ligne.

Risque d’instrumentalisation politique de la loi

Certains observateurs alertent également sur le risque d’instrumentalisation politique de la loi Take It Down Act. Donald Trump, par exemple, a laissé entendre qu’il pourrait utiliser cette législation pour s’attaquer à ses opposants en ligne. Une telle dérive soulève des inquiétudes quant à l’usage de la loi comme outil de répression plutôt que de protection.

L’enjeu est d’autant plus délicat que la loi intervient dans un contexte de fortes tensions autour de la modération des contenus numériques. Légiférer sur des domaines aussi sensibles que la cybersécurité, la vie privée et la liberté d’expression nécessite une précision extrême. Sous peine de voir des principes démocratiques mis à mal. La moindre ambiguïté juridique peut devenir un levier de pouvoir entre les mains d’acteurs politiques ou économiques peu scrupuleux.

Par ailleurs, bien que la loi prévoit une certaine immunité pour les plateformes qui agissent « de bonne foi », cette protection reste partielle. Les entreprises du numérique doivent naviguer dans une zone grise. D’un côté, la pression réglementaire pour supprimer rapidement les contenus problématiques. De l’autre, le risque de censurer des publications licites et de s’exposer à des accusations de partialité ou d’atteinte à la liberté d’expression.

Cette tension entre sécurité numérique et liberté d’expression ne semble pas près de s’apaiser. Dans les mois à venir, le débat autour du Take It Down Act pourrait bien s’intensifier, à mesure que ses premières applications concrètes révéleront ses forces, et ses failles.

Vers une harmonisation mondiale des législations contre les deepfakes ?

Le Take It Down Act s’inscrit dans une dynamique internationale visant à renforcer la protection juridique contre les contenus sexuels non consentis, notamment ceux générés par intelligence artificielle. Face à la prolifération des deepfakes à caractère pornographique, plusieurs pays cherchent à adapter leur législation aux nouvelles réalités numériques.

En Europe, l’Union européenne a franchi une étape majeure en mai 2024 en adoptant une directive sur les violences faites aux femmes. Ce texte oblige les États membres à criminaliser la diffusion de contenus sexuels non consentis, y compris ceux créés artificiellement. Les pays de l’UE ont jusqu’en 2027 pour transposer cette directive dans leur droit national, ouvrant ainsi la voie à une harmonisation juridique sur un sujet jusqu’ici traité de manière inégale à travers le continent.

La France, de son côté, a pris les devants avec la loi SREN, adoptée en 2024. Cette législation interdit explicitement la production et la diffusion de deepfakes pornographiques non consentis, et prévoit des peines pouvant aller jusqu’à deux ans de prison et 60 000 euros d’amende.

Le Royaume-Uni n’est pas en reste. Début 2025, le gouvernement a annoncé un projet de loi similaire, actuellement en cours d’examen. Ce texte entend criminaliser la création et la diffusion de contenus sexuels synthétiques explicites, avec des peines comparables à celles prévues en France.

En somme, le Take It Down Act s’inscrit dans un mouvement global vers une régulation plus stricte des contenus numériques. Il inspire d’autres nations à adopter des lois similaires. Tout en soulignant la nécessité d’un équilibre entre protection des victimes, responsabilité des plateformes et préservation des libertés fondamentales. Son succès ou ses limites auront donc un impact durable sur la gouvernance numérique mondiale.

- Partager l'article :