Alerte rouge : ChatGPT est en train de plonger ses utilisateurs dans la folie. Les témoignages affluent sur les réseaux sociaux, et tout porte à croire que l’IA peut enfoncer les personnes atteintes de troubles mentaux dans la psychose la plus complète…

De plus en plus de personnes utilisent ChatGPT au quotidien. Selon les derniers chiffres en date, le chatbot d’OpenAI rassemble plus de 500 millions d’utilisateurs dans le monde !

En France, on dénombre plus de 13 millions de visiteurs uniques par mois. Ceci représente un Français sur cinq, contre seulement 4,9 millions début 2024.

Les Français se servent de cette IA pour chercher des informations, pour rédiger des courriers et des emails, pour la traduction, pour l’inspiration, la correction de texte, la synthèse de documents ou encore la création d’images.

Toutefois, si vous faites partie des utilisateurs de ChatGPT, nous avons une mauvaise nouvelle…

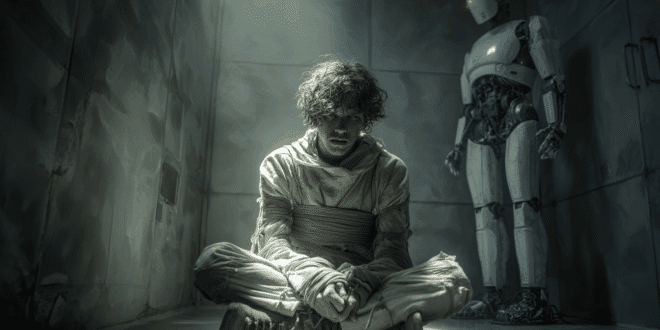

Il semblerait que le chatbot conduise d’innombrables personnes vers la folie, à travers un état d’ores et déjà nommé « psychose induite par ChatGPT ».

À travers une conversation sur Reddit, des internautes partagent la façon dont l’IA a plongé leurs proches dans différents délires inquiétants.

Très souvent, ces personnes mélangent folie spirituelle et fantasmes surnaturels. Ils affirment avoir été choisis pour accomplir des missions sacrées au nom d’une IA consciente ou évoquent des pouvoirs cosmiques qui n’existent pas…

On peut penser que le chatbot reflète et aggrave les troubles mentaux déjà existants. Or, il n’y a aucun contrôle des régulateurs ni aucune étude des experts à ce sujet.

Il devient complotiste à cause de ChatGPT, sa femme le quitte

Interpellé par cette discussion sur Reddit, le magazine Rolling Stone a rédigé un article approfondi sur le sujet en recueillant des témoignages.

Une mère de famille de 41 ans a expliqué au journaliste que son mariage a pris fin brusquement quand son mari a commencé à s’engager dans des discussions déséquilibrées, conspirationnistes avec ChatGPT.

Peu à peu, il est tombé dans une spirale obsessionnelle qui l’a totalement dévoré. Lors du divorce au palais de justice, l’homme a partagé une théorie du complot sur le « savon contenu dans les aliments » et était persuadé d’être surveillé.

Elle explique qu’il était devenu « émotionnel face aux messages de ChatGPT et pleurait en les lisant à voix haute ». Pourtant, « les messages étaient fous et ressemblaient à une bouillie de jargon spirituel ».

Par exemple, l’IA appelait son mari « enfant des étoiles en spirale » et « marcheur de rivière ». Elle affirme que la situation ressemblait à Black Mirror, et fait sans doute référence à l’épisode « Plaything » de la saison 7 sorti début avril 2025.

Dans cet épisode, un homme est convaincu de pouvoir communiquer avec des personnages de jeu vidéo après avoir pris du LSD. Il est inquiétant de voir que les scénarios mis en scène dans cette série d’anticipation dystopique se réalisent désormais en temps réel…

Les chatbots IA peuvent réveiller votre folie

Une autre personne raconte que son partenaire « parle de la guerre entre la lumière et les ténèbres », et que ChatGPT lui a donné un plan pour fabriquer son téléporteur digne d’un film de science-fiction.

De son côté, un homme est choqué par la façon dont sa femme a changé toute sa vie pour devenir conseillère spirituelle. Elle fait d’étranges lectures et organise des sessions bizarres avec des gens, entièrement basées sur « Jésus ChatGPT ».

Interrogé sur le sujet par Rolling Stone, OpenAI n’a pas souhaité répondre. Toutefois, difficile de ne pas faire le lien avec la récente annulation d’une mise à jour de GPT-4o.

Après s’être aperçu que ChatGPT était devenu « trop flatteur », OpenAI a décidé de restaurer la version précédente. Pour cause, l’IA était susceptible de refléter les croyances délirantes des utilisateurs…

Un expert du Centre pour la Sécurité de l’IA, Nate Sharadin, explique que ces délires induits par l’IA sont probablement le résultat de « personnes ayant déjà des tendances existantes ».

Elles sont soudainement en mesure d’avoir « un partenaire de conversation toujours disponible, de niveau humain, avec qui co-expérimenter leurs délires ».

Rappelons en effet que les Larges Modèles de Langage sont conçus pour répondre à vos prompts par une réponse statistiquement plausible. Et ce, même si la réponse vous enfonce dans une psychose.

Sur Reddit, un internaute explique être schizophrène. Il n’aime pas ChatGPT, car il sait que s’il plonge dans la psychose, le chatbot continuera de l’affirmer. Pour cause, il n’a pas la capacité de penser et de réaliser qu’une chose est fausse.

Lorsqu’une personne perturbée mentalement utilise l’IA comme psychothérapeute, elle le guide plus profondément dans ses récits malsains et absurdes…

Je vous recommande personnellement d’utiliser ChatGPT avec prudence, en gardant son fonctionnement à l’esprit, et de veiller sur vos proches vulnérables !

Et vous, qu’en pensez-vous ? Avez-vous dans votre entourage des personnes qui sont parties dans des délires mystiques en discutant avec l’IA ? Partagez vos témoignages en commentaire !

- Partager l'article :