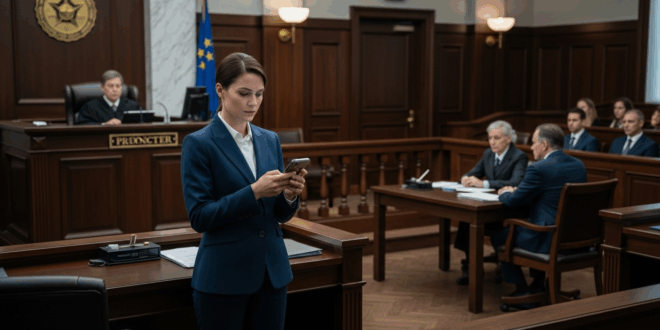

Quand on n’a pas les moyens de s’offrir un avocat, la tentation de chercher de l’aide ailleurs est grande. Depuis l’arrivée de ChatGPT et d’autres outils, beaucoup de personnes se représentent seules devant les tribunaux australiens en glissant discrètement l’IA dans leur stratégie. Ce qui est assez malin.

C’est gratuit, rapide et accessible en quelques clics. Alors, pourquoi passer des nuits à déchiffrer des textes juridiques quand un chatbot promet de le faire en quelques secondes ? Voilà le raisonnement de nombreux justiciables.

Cela dit, les juges ne vous conseillent pas d’en faire autant. Et je ne peux qu’être d’accord. Voici pourquoi.

La tentation grandissante de l’IA gratuite

Les Australiens qui se représentent seuls au tribunal ne sont pas des cas isolés. Dans certaines affaires de migration, près de huit plaideurs sur dix se sont retrouvés sans avocat. La justice a donc dû s’adapter en créant des formulaires simplifiés et des guides pour les accompagner dans la procédure. Mais l’arrivée d’outils génératifs accessibles gratuitement a tout changé.

Les chercheurs expliquent que les plaideurs sans avocat utilisent désormais l’IA pour des affaires variées. Testaments, litiges de propriété, faillite, emploi, voire migration. Avec un clavier et une connexion internet, ils transforment leur salon en cabinet virtuel. Mais ce cabinet virtuel n’a pas toujours les bons manuels.

Et la justice, elle, ne pardonne pas les approximations et les citations inventées. Même les efforts sincères d’une défenderesse se transforment en plaidoirie incohérente quand elle s’appuie sur des arguments inventés par un chatbot. Le juge Andrew Bell, en Nouvelle-Galles du Sud, l’a bien fait entendre.

Attention, l’IA peut nuire à votre dossier

En effet. L’erreur ne pardonne pas dans une salle d’audience. Un document truffé de fausses références peut être immédiatement rejeté. Et un plaideur, même de bonne foi, peut voir son affaire s’écrouler simplement parce qu’il a fait confiance à une phrase générée par un robot.

Le plus inquiétant, c’est que la justice ne se contente pas de dire « merci, au revoir ». Elle peut sanctionner financièrement un plaideur ayant utilisé des informations erronées. Concrètement, cela signifie qu’une personne peut se voir condamnée à payer les frais de son adversaire en plus de perdre son affaire.

Certains avocats eux-mêmes se sont déjà fait piéger en citant des lois fictives inventées par l’IA. Mais la différence est énorme. Leur responsabilité professionnelle peut être engagée et leur client a une possibilité de recours. Le citoyen qui se défend seul, lui, n’a personne d’autre à blâmer que lui-même.

Un juge du Queensland a même averti que s’appuyer sur un texte généré par un chatbot, sans vérification, pouvait non seulement rallonger la procédure, mais aussi coûter très cher au final. Bref, l’économie réalisée en sautant l’avocat peut se transformer en gouffre.

Comment limiter les risques sans tomber dans le piège ?

La recommandation la plus simple reste de ne pas utiliser l’IA pour ses recherches juridiques. Cela dit, dans la pratique, rares sont ceux qui résistent à la facilité d’un résumé prêt à l’emploi. Alors, comment éviter la catastrophe ?

Les spécialistes rappellent que de nombreuses bases de données gratuites existent déjà. L’Australasian Legal Information Institute est l’une des plus utilisées, tout comme Jade. Ces plateformes, même si elles paraissent austères, contiennent des références fiables, validées et reconnues par les tribunaux.

Les bibliothèques judiciaires et les facultés de droit sont également ouvertes au public et mettent en ligne de nombreuses ressources. Cela demande un peu plus d’effort qu’un clic sur ChatGPT, mais l’avantage est simple : pas de citations inventées et pas de lois sorties de nulle part.

Enfin, certains tribunaux ont publié leurs propres guides concernant l’usage de l’IA. Le Queensland rappelle par exemple de ne jamais entrer d’informations privées ou confidentielles dans un chatbot. Car au-delà des erreurs factuelles, il existe un autre danger : la fuite involontaire de données sensibles, parfois protégées par la loi.

- Partager l'article :