TensorFlow est une bibliothèque open source de Machine Learning, créée par Google, permettant de développer et d’exécuter des applications de Machine Learning et de Deep Learning. Découvrez tout ce que vous devez savoir à son sujet.

Le Machine Learning est une technologie qui peut s’avérer extrêmement utile pour de nombreux cas d’usage, mais qui s’avère malheureusement complexe à manipuler. L’acquisition de données, l’entraînement de modèles, de déploiement de réseaux de neurones requièrent à l’origine d’importantes compétences techniques.

Cependant, grâce aux différents frameworks de Machine Learning, l’accès à cette technologie s’est beaucoup simplifié au fil des années. Parmi ces frameworks, on compte notamment PyTorch, CNTK, MXNet, et Google Tensorflow.

TensorFlow : qu’est-ce que c’est ?

Créé par l’équipe Google Brain en 2011, sous la forme d’un système propriétaire dédié au réseaux de neurones de Deep Learning, TensorFlow s’appelait à l’origine DistBelief. Il a, par la suite, changé de code source et devient une bibliothèque basée application. Le nom de TensorFlow a vu le jour en 2015 et Google l’a rendu open source. Depuis lors, il a subi plus de 21000 modifications par la communication et est passé en version 1.0 en février 2017.

Pour faire simple, TensorFlow est une bibliothèque de Machine Learning, il s’agit d’une boîte à outils permettant de résoudre des problèmes mathématiques extrêmement complexes avec aisance. Elle permet aux chercheurs de développer des architectures d’apprentissage expérimentales et de les transformer en logiciels.

Il s’agitd ‘ un système de programmation qui représente les calculs sous forme de graphiques. Les noeuds du graphique représentent les opérations mathématiques, et les bordures représentent des flèches de données multidimensionnelles communiquées entre elles : les tensors.

TensorFlow regroupe un grand nombre de modèles et d’algorithmes de Machine Learning et de Deep Learning. Son API front-end de développement d’applications repose sur le langage de programmation Python, tandis que l’exécution de ces applications s’effectue en C++ haute-performance.

Cette bibliothèque permet notamment d’entraîner et d’exécuter des réseaux de neurones pour la classification de chiffres écrits à la main, la reconnaissance d’image, les plongements de mots, les réseaux de neurones récurrents, les modèles sequence-to-sequence pour la traduction automatique, ou encore le traitement naturel du langage.

Tensorflow : comment ça fonctionne ?

TensorFlow permet de créer des graphiques de dataflow, où chaque nœud effectue une opération et chaque connexion transporte un tensor multidimensionnel.

Les noeuds et les tensors sont des objets Python, et les applications TensorFlow sont elles-mêmes des applications Python. Cependant, les opérations mathématiques en elles-mêmes ne s’effectuent pas en Python. Les bibliothèques de transformation disponibles sur TensorFlow sont écrites en C++ haute-performance. Ainsi, le Python se contente de diriger le trafic entre les éléments et fournit des abstractions de programmation de haut niveau pour les connecter entre eux.

TensorFlow peut s’exécuter localement, sur le cloud, sur mobile ou via CPU et GPU. Sur Google Cloud, il peut utiliser les TPU pour un gain de performance important.

Quels sont les avantages et inconvénients de TensorFlow ?

Les avantages de TensorFlow sont multiples. Tout d’abord, grâce à l’abstraction, ce framework facilite l’implémentation d’algorithmes et permet au développeur de se focaliser sur la logique générale d’une application.

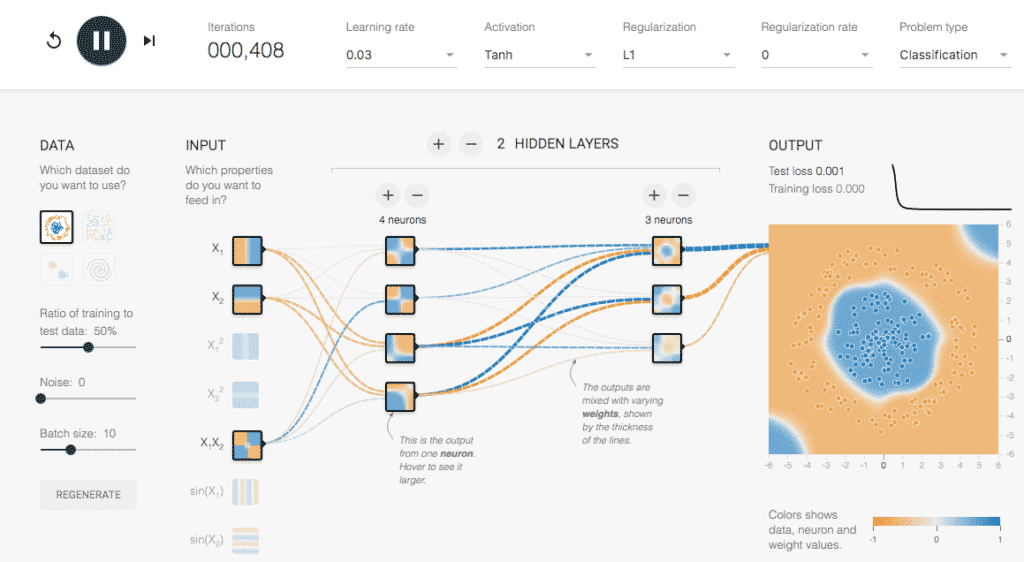

En outre, le mode » eager execution « permet d’évaluer et de modifier toutes les opérations de graph de façon séparée et transparente plutôt que d’avoir à construire l’intégralité du graphique en tant qu’objet opaque unique et de tout évaluer en une fois. De même, la suite de visualisation TensorBoard permet d’inspecter la façon dont les graphiques fonctionnent par le biais d’un tableau de bord interactif basé web.

En outre, le soutien de Google facilite le déploiement et l’utilisation de TensorFlow. En plus du TPU proposé sur Google Cloud pour accélérer les performances, le géant californien propose aussi un hub online permettant de partager les modèles créés avec TensorFlow ainsi que des versions mobiles et web du framework. Un autre avantage est son caractère open source, personnalisable, et modulaire.

Parmi ses inconvénients, nous pouvons citer les variations que peut présenter un même modèle entraîné sur deux systèmes différents. Ceci, même si les mêmes données l’ont nourri. En outre, TensorFlow ne prend pas en charge OpenCL. Enfin, il requiert des connaissances en calculs avancés et en algèbre linéaire ainsi qu’une importante compréhension du Machine Learning.

TensorFlow 3.0 : nouveautés et avancées en 2026

Lancée en 2025, TensorFlow 3.0 continue de transformer le domaine du Machine Learning et du Deep Learning. Je constate que cette version offre de meilleures performances, une compatibilité étendue et une interface simplifiée, facilitant le travail des développeurs et chercheurs. L’un des progrès majeurs concerne l’optimisation des modèles d’IA générative, notamment les LLM (Large Language Models). Ces outils avancés permettent un entraînement et un déploiement plus rapides tout en réduisant significativement la consommation de ressources.

TensorFlow en 2026 : ce qui change vraiment, le LiteRT passe en production, quantification INT2/INT4, et Gemma 4

Ce début d’année marque un tournant pour l’écosystème TensorFlow. Avec la version 2.21 sortie en mars 2026, LiteRT n’est plus une simple préversion : il devient officiellement un runtime de production, remplaçant TensorFlow Lite comme solution d’inférence unifiée pour les appareils mobiles et edge. Concrètement, cette évolution apporte des gains notables : LiteRT est 1,4 fois plus rapide que TFLite sur GPU, propose un workflow unifié pour les NPU, et permet de convertir directement des modèles depuis PyTorch ou JAX sans avoir à les réécrire.

Autre avancée majeure, la prise en charge de la quantification INT2 et INT4 au niveau des opérateurs clés comme tfl.cast, tfl.slice ou tfl.fully connected . Cela autorise une compression très aggressive des modèles, réduisant fortement l’empreinte mémoire et la bande passante – un atout considérable pour l’IA générative sur terminal.

En parallèle, Google DeepMind a dévoilé en ce début du mois la famille Gemma 4, des modèles ouverts sous licence Apache 2.0. Elle comprend quatre versions : E2B 2B, E4B 4B, 26B MoE et 31B Dense. Ces modèles gèrent 140 langues, des contextes allant jusqu’à 256 000 tokens, et offrent des capacités multimodales (texte, image, vidéo, et même audio pour les petites versions). Le modèle 31B se classe troisième au classement Arena AI des modèles ouverts, surpassant des modèles vingt fois plus volumineux.

Ce qui ressort de ces annonces, c’est que les vraies innovations de 2026 ne sont pas dans de nouveaux gadgets no-code. Elles sont dans l’industrialisation d’une IA edge plus rapide, plus économe en ressources, et rendue accessible via des modèles ouverts de nouvelle génération.

TensorFlow et ses concurrents : quel choix en 2026 ?

Le choix d’une bibliothèque de Machine Learning dépend surtout de vos objectifs, de votre environnement de travail et de vos préférences. TensorFlow, soutenu par Google, reste une référence solide avec une communauté très active et des outils fiables, particulièrement adapté aux projets complexes et à la mise en production rapide. À l’inverse, PyTorch séduit de nombreux chercheurs grâce à son codage intuitif et son approche dynamique, idéale pour le prototypage et les expérimentations rapides.

CNTK, développé par Microsoft, demeure performant et fiable, mais son adoption reste limitée face aux leaders du marché, et son soutien communautaire est moins actif aujourd’hui. MXNet, soutenu par Amazon, se distingue par sa capacité à gérer de gros volumes et une bonne scalabilité, mais sa communauté plus réduite peut ralentir la recherche de solutions. Je vous dirai donc que, pour 2026, TensorFlow et PyTorch dominent le paysage : TensorFlow s’impose dans l’industrie, tandis que PyTorch reste privilégié pour la recherche. Votre choix doit principalement se baser sur vos priorités techniques et votre contexte de travail.

FAQ sur TensorFlow

C’est une bibliothèque open source développée par Google pour créer, entraîner et déployer des modèles de Machine Learning.

Oui, surtout avec Keras intégré. Il propose des abstractions simples, même si une base en Python est utile.

TensorFlow est plus adapté à l’industrie, PyTorch est souvent préféré pour la recherche et l’expérimentation rapide.

Oui. Avec TensorFlow Lite, il est possible d’exécuter des modèles sur Android, iOS et même microcontrôleurs.

Support natif de l’IA quantique, meilleure gestion des LLM, API simplifiée et optimisation Edge AI.

Oui. Il fonctionne aussi sur CPU, mais l’entraînement sera plus lent sans accélération matérielle.

- Partager l'article :

Merci pour ce résumé de TensorFlow motivant pour l’utiliser!

Merci pour cette article toujours aussi documenté. Ayant fait une page qui présente Tensorflow également, je ne suis pas entré dans la technique comme vous , je l’aborde sous l’angle des applications concrètes et logiquement, mes conclusions sont un peu différentes.

En particulier, j’ai fait beaucoup de traitement de signal et me heurte aux mêmes problèmes avec Tensorflow : un problème lié au taux d’erreur, comme vous le dites dans votre dernier paragraphe. Des « variations » apparaissent non seulement lors des tests unitaires mais surtout dans les applications où les données en entrée ne diffèrent que très peu.

J’ai déjà connu ces problèmes par le passé avec les FFT. Mes ex-employeurs on fini par jeté l’éponge après avoir beaucoup investi dans la recherche de nouvelles applications. Aussi, il me semble que Tensorflow s’insère mieux dans une logique de traitement de signal où un cas donné ne se présente jamais deux fois à l’identique et les taux d’erreur sont culturellement tolérés.

Notez que l’ia n’est pas mon thème principal.