Du 11 au 12 juin se déroulait AI Paris, le moyen pour les entreprises pour partager leurs avancées dans le domaine de l’intelligence artificielle. RPA, Deep Learning, Computer vision animaient les discussions et les présentations des fournisseurs présents sur place.

AI Paris 2019, la troisième édition du salon consacrée à l’intelligence artificielle et ses expertises avait lieu au Palais Congrès de Paris. Corp Agency, l’organisateur de l’événement a choisi un espace qu’il connaît bien. En effet, Big Data Paris se déroulait lui aussi au même endroit situé à Porte-Maillot.

Contrairement à ce salon qui a accueilli 16500 visiteurs et 250 exposants, AI Paris reste à plus petite échelle. 110 exposants présentaient leurs solutions lors de cette troisième édition, contre 80 l’année dernière. Pas moins de 5100 visiteurs ont fait le déplacement en 2019.

Cela s’explique aisément. Les outils d’intelligence artificielle répondent depuis peu à des cas d’usage concrets. Les technologies liées à l’IA, comme le Deep Learning et la Computer vision, sont par exemple utilisées pour détecter des fraudes.

Le Deep Learning, le machine learning et la Computer vision ont le vent en poupe à AI Paris

La Direction générale des Finances publiques (DGFIP) a notamment fait appel à Keyrus pour identifier les incohérences dans les déclarations fiscales des entreprises. Ainsi, cela permet de créer des modèles qui assimilent ces comportements et facilitent les enquêtes. Pour cela Keyrus, combine le machine learning, l’apprentissage non supervisé et le deep learning. Comme le taux de fraude n’est que de 5 %, il faut des solutions performantes. Pour cela, Keyrus mêle les techniques de Bagging (précision), Boosting (performance) et Blending (transfert pour différents classifieurs). Il s’agit de nettoyer les données, puis d’effectuer un traitement efficace.

Certaines entreprises utilisent la Computer Vision. Le cas d’usage le plus visible sur le salon ? L’identification de personnes. Plusieurs sociétés comme IBM, Oracle, Gfi, et bien d’autres filmaient les visiteurs, montrant leur capacité à les détecter, mais aussi à les compter. Cela peut paraître gadget, mais cette technologie de reconnaissance intéresse fortement les responsables de la sécurité. Elle permet par exemple de repérer un suspect dans une foule ou bien des activités illégales. Dans un contexte industriel, Microsoft, notamment, propose une solution pour détecter le non-port du casque dans des zones à risques.

Des biais et des attaques difficiles à mitiger

![]()

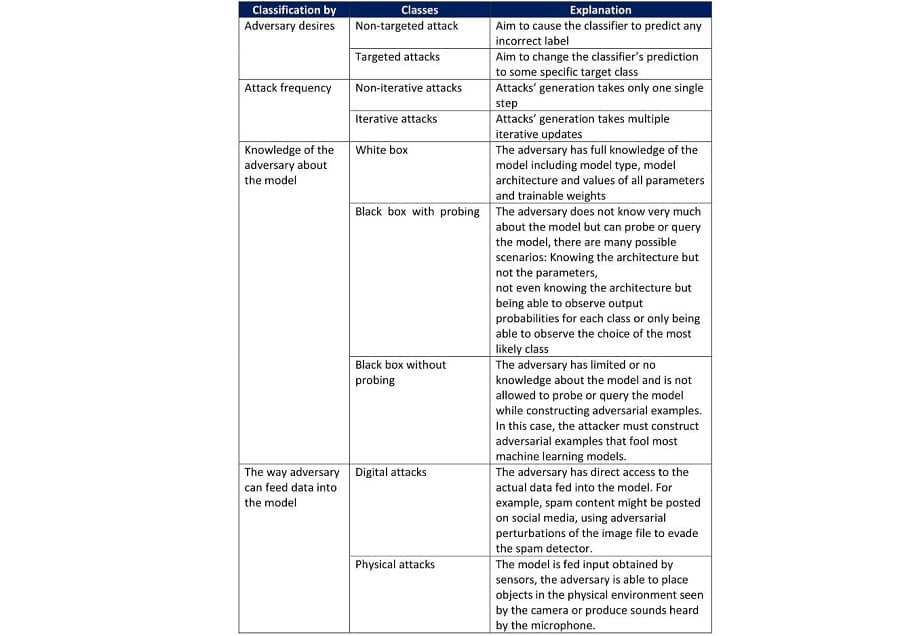

Évidemment, ces technologies posent des problématiques importantes. La première d’entre elles concerne la cybersécurité. En effet, un hacker peut très bien se jouer des règles qui régissent un modèle de Deep Learning afin de l’altérer ou de le détourner à son avantage. Axionable, cabinet de stratégie spécialisée dans l’IA, a dépêché deux experts dans ce domaine. Selon eux, il suffit parfois de modifier un pixel pour tromper l’algorithme. Dans le cas où l’attaquant s’en prendrait aux données d’apprentissage alors, il devient obsolète. Ils se sont penchés sur un système de détection de fraude à la transaction. Ainsi, ils ont repéré les techniques d’attaques adverses et le moyen de défense à mettre en place.

Ils ont notamment étudié un modèle embarquant une formule pour soustraire les motifs d’attaque. L’algorithme repère les biais et ne les prend pas en compte. Dans un deuxième cas, les chercheurs cachent le gradient utilisé pour le former. Une autre méthode consiste à processer et débruiter les données. Certains combinent plusieurs techniques pour gagner en efficacité.

À chaque fois, Axionable repère des avantages et des inconvénients pour chacune des techniques d’entraînement. De même, les ajouts de code dédié à se protéger peuvent être contournés. Il n’y a donc pas d’algorithme parfait et les biais peuvent être nombreux.

Parce qu’il y a un manque de connaissance des clients, les fournisseurs de technologies veulent davantage sécuriser leurs solutions. IBM, par exemple, propose Watson Open Scale censé repérer les biais dans les intelligences artificielles. Enfin, la firme partage ART ou Adversarial robustness toolbox, un outil pour détecter l’empoisonnement et l’évasion de données associées à un algorithme.

Cependant, il y a encore beaucoup à faire pour empêcher les attaques. Les ateliers techniques d’AI Paris étaient idéaux pour se rendre compte l’état de l’art de l’IA.

- Partager l'article :