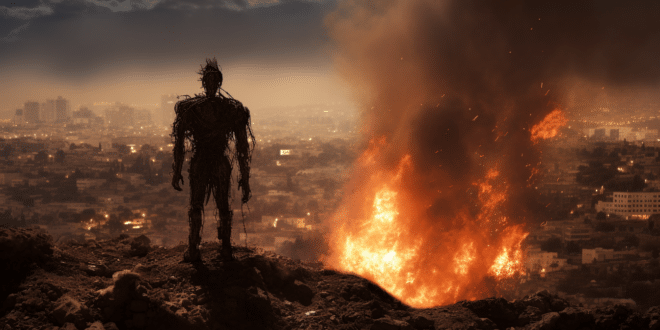

L’armée israélienne a dévoilé l’ampleur de ses bombardements sur Gaza, ciblant principalement des objectifs militaires en Israël, tout en négligeant l’IA.

L’armée israélienne a bombardé Gaza intensivement, admettant l’imprécision de ces frappes. L’usage limité de l’intelligence artificielle pour cibler suscite des inquiétudes. L’approche de Tsahal dans la guerre contre le Hamas, ayant causé de nombreuses victimes à Gaza, est remise en question. Israël avait annoncé utiliser l’intelligence artificielle dans ses opérations à Gaza en mai 2021.

L’Évangile : l’IA d’Israël accélère le ciblage durant la guerre avec le Hamas

Durant la récente guerre Israël-Hamas, l’armée israélienne a utilisé l’Évangile, une IA, pour accélérer le ciblage. Or, qualifiée d’usine de cibles, cette IA a été révélée par des renseignements et Tsahal. Par ailleurs, l’augmentation de l’usage de l’IA par Israël interpelle, d’autant plus avec l’adoption globale de systèmes automatisés.

Un ex-officiel de la Maison Blanche a noté que le monde entier scruterait l’utilisation israélienne de systèmes autonomes. D’ailleurs, si Israël utilise l’IA pour des décisions critiques, cela pourrait être un tournant. En effet, Tsahal a identifié plus de 12 000 cibles à Gaza via Habsora (l’Évangile), générant vite des recommandations de ciblage.

Selon des sources telles que +972 Magazine et Local Call, Tsahal a utilisé l’Évangile pour cibler des endroits, y compris les domiciles de membres présumés du Hamas. La division cible de Tsahal, épaulée par l’IA, aurait une base de 30 000 à 40 000 militants présumés.

L’Évangile a été vital pour établir des listes de cibles. Aviv Kochavi, ancien chef de l’armée, a affirmé que l’IA a créé 100 cibles par jour durant la guerre de mai 2021, bien plus que les 50 annuelles précédemment.

Le fonctionnement de l’Évangile, bien que partiellement secret, semble combiner diverses sources d’informations. En conséquence, la division cible, conçue pour pallier le manque de cibles dans les opérations antérieures à Gaza, a permis à Tsahal de viser plus de jeunes membres du Hamas.

Tsahal change de tactique à Gaza et vise les domiciles du Hamas

Un responsable impliqué dans les opérations à Gaza a révélé un changement de tactique de Tsahal. Auparavant, les maisons des jeunes membres du Hamas n’étaient pas ciblées. Toutefois, cette politique a évolué durant le conflit actuel. Désormais, les domiciles des membres présumés du Hamas sont attaqués, sans distinction de rang. Tsahal souligne la précision des frappes, estimant le nombre de civils présents avant chaque attaque.

Néanmoins, des experts en intelligence artificielle et conflits armés restent sceptiques. Ils doutent de l’efficacité de ces systèmes à réduire les dommages civils, compte tenu des bombardements visibles à Gaza. Lors de ce conflit, Tsahal a visé bien plus de cibles à Gaza que lors des précédentes opérations militaires.

Selon The Guardian et +972/Local Call, les frappes sur les maisons de membres présumés du Hamas ou du Jihad islamique sont minutieusement préparées. Les estimations du nombre de civils potentiellement impactés sont calculées en amont. Chaque cible est évaluée avec un score de dommages collatéraux. La décision de frapper relève du commandant en charge, certains étant plus disposés à agir.

Des cas où la légitimité de la cible était incertaine ont conduit à de nombreux morts civils, d’après une source ayant participé à la planification des frappes pour Tsahal jusqu’en 2021.

Tsahal utilise une IA pour accélérer la sélection de cibles militaires

Un porte-parole militaire israélien a expliqué que Tsahal vise à démanteler le Hamas en réaction à leurs attaques. Tsahal assure respecter le droit international et minimise les dommages aux civils. Selon des sources, l’IA utilisée par Tsahal accélère la définition de cibles, les sélectionnant automatiquement.

Par ailleurs, une autre source a indiqué que Tsahal opérait une « usine d’assassinats de masse », privilégiant la quantité sur la qualité des cibles, malgré une supervision humaine limitée. Des experts en IA et en droit humanitaire international expriment leur inquiétude face à cette rapidité. Le Dr. Marta Bo, de l’Institut international de recherche sur la paix de Stockholm, a souligné le risque de « biais d’automatisation ».

Ce biais se manifeste quand la dépendance aux systèmes automatisés altère le jugement des risques pour les civils. L’usage d’outils tels que « l’Évangile » peut rendre les commandants trop dépendants des listes de cibles générées par ordinateur. Cela limite leur capacité à remettre en question les recommandations de ciblage et mène à un processus automatisé, au risque de négliger la protection des civils.

- Partager l'article :