ChatGPT connaît une croissance record avec 100 millions d’utilisateurs mensuels actifs. Les entreprises doivent donc comprendre les limites de ChatGPT avant de le mettre en place.

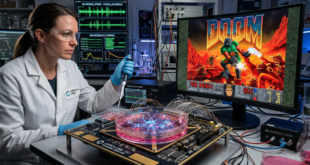

Dans la fiction, l’IA est souvent présentée de manière dystopique, de Hal en 2001: l’Odyssée de l’espace aux Cylons sinistres de Battlestar Galactica. Même WALL-E suppose que l’IA rend les humains paresseux et dépendants de la technologie. Mais dans la réalité, l’IA est bien plus nuancée. Un exemple brûlant est ChatGPT, qui connaît une croissance record avec 100 millions d’utilisateurs mensuels actifs. Cependant, l’utilisation de cet outil soulève des préoccupations de confidentialité et de propriété des données. Les entreprises doivent comprendre ces limites avant de l’adopter.

ChatGPT : réponses génératives

ChatGPT est un programme d’IA générative qui produit des réponses basées sur les prompts de l’utilisateur. Contrairement aux réponses préétablies, il génère des réponses en utilisant son expérience, les données disponibles et la contribution de l’utilisateur. ChatGPT fonctionne comme une conversation entre l’humain et le programme.

Par contre, l’utilisation de l’IA générative soulève des questions de confidentialité et de données. Les bots génératifs, y compris ChatGPT, ne garantissent pas la confidentialité des données. Cela pose un défi pour les entreprises qui doivent garantir la confidentialité de leurs clients. Lorsque des informations sont saisies dans un chatbot, l’IA peut les utiliser de manière imprévisible pour les entreprises. Les entreprises doivent prendre en compte ces implications avant d’adopter des outils d’IA générative.

Confidentialité et collecte de données par ChatGPT

Malgré les déclarations de ne pas utiliser les informations fournies par les utilisateurs, ChatGPT collecte les adresses IP, les types de navigateur, les paramètres. De plus, il utilise des cookies pour suivre les activités de navigation. Ces données ont la possibilité d’être partagées avec des tiers sans préavis. Un autre problème de confidentialité est que ChatGPT inclut automatiquement tout le monde, malgré la désactivation proposée.

Tout de même, cela limite les réponses reçues. Le programme lui-même met en garde les utilisateurs quant à la sécurité et la confidentialité des informations. Avant d’utiliser ChatGPT ou tout autre produit d’IA générative, vérifiez les mesures de sécurité et le traitement des données collectées. Assurez-vous également de comprendre comment ces données sont séparées ou combinées. Les entreprises soucieuses de la confidentialité doivent comprendre les conditions générales du produit avant de l’adopter.

Sécurité des données et responsabilités dans l’IA générative

Alors que les régulateurs de la confidentialité des données évaluent encore ces systèmes, des problèmes potentiels émergent. Ces problèmes sont notamment liés à la réglementation européenne GDPR. Aux États-Unis, seuls certains États proposent des lois sur la confidentialité, en l’absence de réglementation fédérale.

L’article 17 du RGPD confirme le « droit à l’effacement », permettant aux utilisateurs d’annuler leur consentement et de demander l’effacement de leurs données. Néanmoins, les chatbots ne sont pas en mesure de supprimer complètement les données individuelles de leur formation. Cette limitation entraîne des problèmes de conformité pour les entreprises soumises au RGPD. La responsabilité des entreprises est également un sujet clé. Les entreprises derrière les systèmes d’IA générative ont des limitations de responsabilité définies dans leurs conditions d’utilisation, mais elles peuvent être tenues responsables des violations résultant de l’utilisation de l’IA.

La formation des employés est essentielle. Avant d’utiliser des systèmes d’IA générative tels que ChatGPT, il est important de mettre en place une formation adéquate pour les employés. Cela implique de définir les attentes et les politiques de l’entreprise concernant l’utilisation de ces systèmes.

Les risques liés à la confidentialité des données nécessitent une prise de conscience. Les entreprises doivent développer une stratégie solide axée sur la confidentialité pour éviter de compromettre leur rentabilité et leur réputation. En abordant de manière proactive les questions de confidentialité liées à l’IA générative, les entreprises peuvent tirer parti de ses avantages. Elles peuvent également se positionner comme des leaders de la confidentialité en respectant leurs responsabilités.

- Partager l'article :