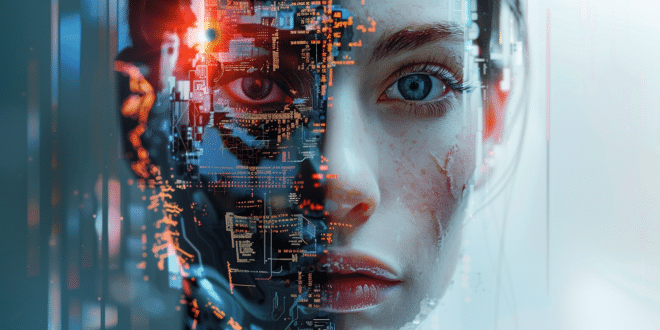

Le résultat de la récente étude menée par McAfee est assez alarmant, car elle révèle que 2 Français sur 3 sont de plus en plus inquiets par les deepfakes IA par rapport à l'année dernière.

En janvier et février 2024, McAfee, le leader mondial de la protection en ligne a effectué une étude auprès de plusieurs pays, dont les États-Unis, Royaume-Uni, France, Allemagne, Australie, Inde, Japon. Le but de cette étude menée par MSI-ACI est de comprendre l'impact de l'IA et la technologie sur l'avenir. Pour réaliser le sondage, la société a interrogé plus de 1 000 consommateurs dans chacun des pays cités précédemment.

Les Français n'arrivent pas à détecter les contenus générés par l'IA

Les Français sont surtout préoccupés qu'avec le temps, ils ne puissent plus réellement reconnaître le vrai du faux. Aujourd'hui, les contenus créés par l'IA sont de plus en plus nombreux. Mais les consommateurs affirment que le plus inquiétant est l'arnaque qui devient plus sophistiquée et plausible.

D'ailleurs, les chiffres à l'issue de cette étude confirment cette préoccupation. En effet, 63% des Français interrogés soit 2 consommateurs sur 3 attestent que les deepfakes IA leur préoccupent plus par rapport à l'année dernière.

Par ailleurs, 38 % des Français pensent qu'avec l'IA, ils ont du mal à détecter les arnaques sur la toile. En une année, 11 Français sur 3 soit 34 % révèlent avoir rencontré un contenu deepfake. Enfin, 19 % des personnes consultées croient pouvoir différencier un fichier audio d'un faux créé par une IA.

Un phénomène qui touche aussi les États-Unis

D'après le rapport de l'étude de McAfee, les Français ne sont pas les seuls à être préoccupés par l'IA. Aux États-Unis, à quelques mois de l'élection présidentielle, environ 1 américain sur 4 dit être tombé sur un deepfake politique.

D'ailleurs, dans ce contexte, leurs principales inquiétudes sont la mésinformation et la désinformation. Cette préoccupation se confirme par l'incident d'un faux appel téléphonique de Joe Biden. L'interrogation des consommateurs américains confirme cette inquiétude croissante.

En effet, 43 % des Américains interrogés craignent l'influence des deepfakes sur les élections, 37 % ont peur d'une baisse de confiance du public dans les médias, et enfin, 43 % une augmentation de l'usurpation d'identité de personnalités publiques, politiques ou médiatiques.

Une inquiétude croissante concernant l'élection

Le surcroît des deepfakes réunit l'inquiétude majeure des consommateurs. L'interrogation des utilisateurs des réseaux sociaux les plus préoccupés par l'IA permet de connaître que 39 % de Français ont évoqué le cyberharcèlement, contre 28 % sur l'influence des élections, 43 % le vol d'identité de personnalités publiques et 61 % la facilité de l'installation d'arnaques sophistiquées.

Ce problème est susceptible de se généraliser, surtout avec les élections à venir dans plusieurs pays, y compris en Europe. D'ailleurs, Vonny Gamot, Directrice EMEA chez McAfee le confirme : « En cette saison électorale, les deepfakes ne proviennent pas uniquement des opposants politiques. Grâce aux outils disponibles aujourd'hui, chacun est à même de créer du contenu généré par l'IA en quelques heures, qu'il s'agisse d'une voix clonée ou d'une vidéo truquée. La facilité avec laquelle l'IA parvient à manipuler l'audio et des images soulève des questions essentielles sur l'authenticité des contenus que nous consommons, surtout en période électorale. À bien des égards, la démocratie est en jeu cette année avec la sophistication de cette technologie. »

- Partager l'article :