Malgré les mesures mises en place, les experts conviennent que les problèmes de DeepFake IA ne feront que s’empirer cette année. Il se peut que toutes les parties prenantes à la régulation finissent par trouver une solution. En attendant, cette technologie continuera d’alimenter la désinformation et les escroqueries.

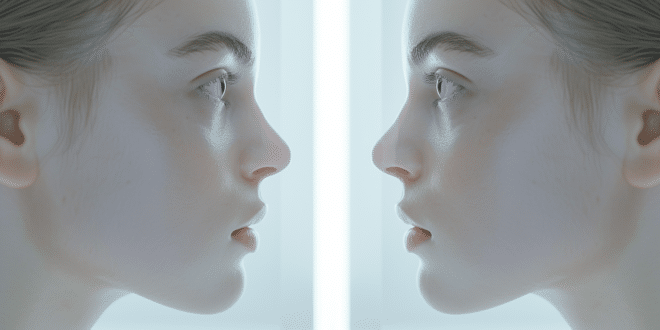

Multiplication des attaques par DeepFake IA

L’utilisation malveillante des DeepFake se multiplie et peut parfois prendre des proportions affolantes. Après l’humiliation de Taylor Swift, le cas d’un employé d’une société financière basée à Hong Kong, victime d’une escroquerie, a également fait les gros titres.

Voici les faits. À Hong Kong, un employé d’une multinationale a été la proie d’un appel vidéo DeepFake IA et perd 25 millions de dollars après une visioconférence avec le faux directeur administratif et financier.

Par ailleurs, aux États-Unis, des milliers d’appels utilisant un clone vocal du président Joe Biden font scandale. Ces DeepFake sont survenus le mois dernier, avant les élections primaires du New Hampshire. Ce ne sont là qu’un aperçu des attaques par DeepFake, un phénomène en plein boom.

Des mesures inefficaces contre les DeepFake

Pour essayer de contenir les utilisations malveillantes des DeepFake IA, certaines entreprises technologiques, notamment Google et OpenAI ont ajouté des filigranes aux contenus générés par l’IA. Néanmoins, la solution n’a pas eu l’effet escompté.

Les filigranes sont visibles sur les photos en plus d’être intégrés dans les métadonnées de l’image. Néanmoins, les utilisateurs ont rapidement trouvé les moyens de contourner cette protection. Parallèlement, MidJourney interdit la génération d’image de Donald Trump et de Joe Biden dans le cadre de l’élection présidentielle, une simple mesure temporaire.

Toujours aux États-Unis, la Federal Communications Commission (FCC) interdit les faux appels automatisés générés par l’IA. Néanmoins, la commission n’a pas clairement défini l’application de cette interdiction, ce qui pourrait faciliter le contournement des règles, déplorent les experts.

Un manque de technologie de détection

Les outils d’IA continuent de se développer, améliorant ainsi la qualité des DeepFake qui brouillent clairement la frontière entre la fiction numérique et la réalité. Plus l’IA s’améliore, plus les problèmes de DeepFake vont empirer.

Parallèlement, les moyens de détection des faux contenus générés par l’IA sont quasi inexistants ou sont peu efficaces. DeepMind par exemple dit disposer d’un outil d’identification des images IA, mais uniquement sur Google. Les plateformes comme Meta et X devraient pourtant intégrer ces systèmes de détection.

Les technologies de détection doivent se développer aussi rapidement que l’IA elle-même. C’est ce qui manque. Même s’il existe des outils de détection des images et des textes générés par l’intelligence artificielle, les technologies dédiées à l’audio et aux vidéos relèvent encore d’un défi énorme.

Pour les experts, Il y a un certain espoir que la technologie et les régulateurs rattrapent leur retard pour résoudre ce problème. Néanmoins, ils conviennent que les DeepFake IA ne feront qu’empirer avant de s’améliorer.

- Partager l'article :