L’intelligence artificielle GPT-2 d’OpenAI, capable de prédire la suite d’un texte en anglais, est désormais capable de générer des images à partir d’une simple séquence de pixels. Pour ce faire, les chercheurs l’ont entraîné sur une banque d’images…

Souvenez-vous. En février 2020, le laboratoire de recherche OpenAI dévoilait son système GPT-2 capable de générer des textes en anglais. En nourrissant cette IA avec le début d’une phrase ou d’un paragraphe, elle est capable de la compléter et même de produire un essai complet en conservant une cohérence.

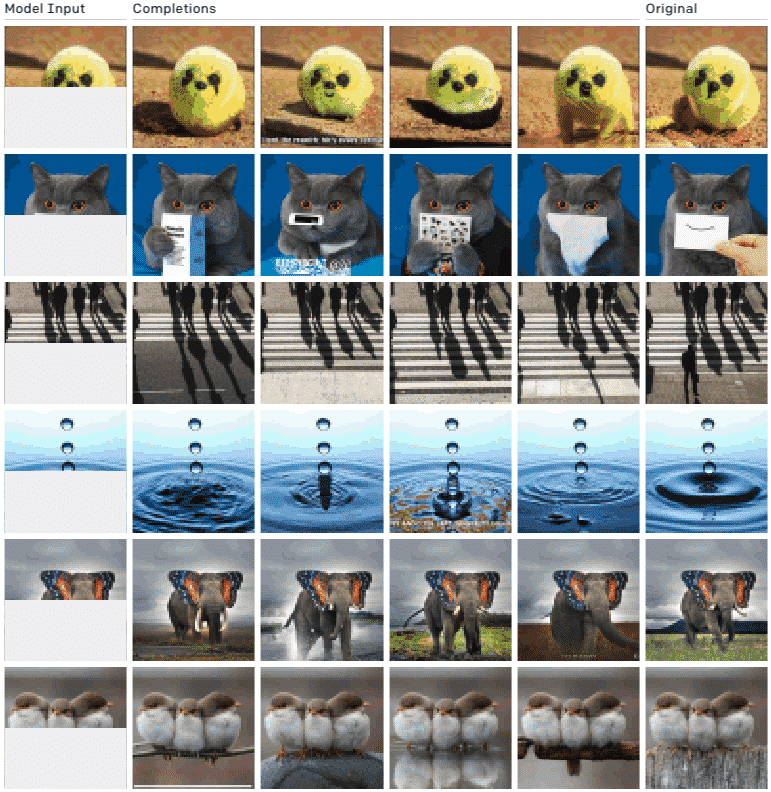

À présent, OpenAI est parvenu à utiliser le même algorithme pour générer des images. En entraînant GPT-2 avec des pixels plutôt qu’avec des mots, les chercheurs ont réussi à lui apprendre à compléter la moitié d’une image.

En effet, GPT-2 est avant tout un moteur de prédiction. Pour apprendre à générer des phrases en langue anglaise, l’algorithme s’est entraîné en analysant des milliards d’exemples de mots, de phrases et de paragraphes sur internet.

Cet entraînement lui a permis d’apprendre à manipuler les mots sous forme de nouvelles phrases en prédisant de manière statistique l’ordre dans lequel ils devraient apparaître. De fait, en remplaçant les mots par des pixels pour entraîner l’IA sur la banque d’images ImageNet, celle-ci a pu apprendre à compléter les images.

Toutefois, cet algorithme a été conçu pour travailler sur des données unidimensionnelles, telles que des lignes de texte. Les images ont donc dû être réduites à une séquence unique de pixels. Le nouveau modèle iGPT a ensuite dû compléter cette séquence.

Les résultats très convaincants de cette expérience ont été dévoilés dans un article qui vient d’être nominé parmi les meilleurs de l’International Conference on Machine Learning. Cette réussite ouvre de nouvelles perspectives pour la génération d’images, et même pour le Machine Learning dans son ensemble…

L’IA d’OpenAI ouvre de nouvelles portes pour le Machine Learning

Elle démontre que l’apprentissage non-supervisé, basé sur des données non étiquetées, pourrait être utilisé pour entraîner les systèmes de vision par ordinateur. Jusqu’à présent, c’est l’apprentissage supervisé et basé sur des données étiquetées qui était privilégié.

Cependant, l’apprentissage non-supervisé présente d’importants avantages. Il permet notamment à l’IA d’apprendre sans intervention humaine, et donc sans les biais humains. De plus, cette approche supprime le besoin d’étiqueter manuellement les données. Le travail nécessaire à l’entraînement de l’IA est donc considérablement réduit.

Plus généralement, le fait qu’iGPT soit basé sur le même algorithme que GPT-2 démontre une adaptabilité de l’intelligence artificielle. C’est donc un pas de plus vers une intelligence artificielle générale, qui reste l’objectif des chercheurs d’OpenAI et de bon nombre de leurs confrères.

En revanche, on peut craindre que cette nouvelle méthode soit exploitée pour la création d’images DeepFake encore plus réalistes. Jusqu’à présent, la création de DeepFakes repose sur l’utilisation des GAN (réseaux génératifs antagonistes) nécessitant des données étiquetées de haute qualité.

Là encore, iGPT pourrait fortement simplifier la création de ces images à des fins malveillantes. Pour l’heure, seule la puissance de calcul requise pour entraîner le modèle fait office d’obstacle à son utilisation par des hackers ou des criminels. Hélas, cette barrière pourrait rapidement s’abaisser…

- Partager l'article :