L’iPhone Xs d’Apple embarque une nouvelle puce A12 Bionic, équipée d’un Neural Engine dédié au Machine Learning. Ce puissant composant offre de nouvelles possibilités pour les développeurs d’applications iOS.

Dans le cadre de son keynote du 12 septembre 2018, Apple vient de dévoiler les iPhone Xs, Xs Max et Xr. D’apparence, ces trois nouveaux smartphones semblent similaires à l’iPhone X de 2017. Toutefois, sous le capot, la nouvelle puce A12 Bionic apporte un gain de performances impressionnant lié en grande partie à l’intelligence artificielle et au Machine Learning.

L’iPhone Xs d’Apple embarque le processeur A12 Bionic et son Neural Engine octa-core

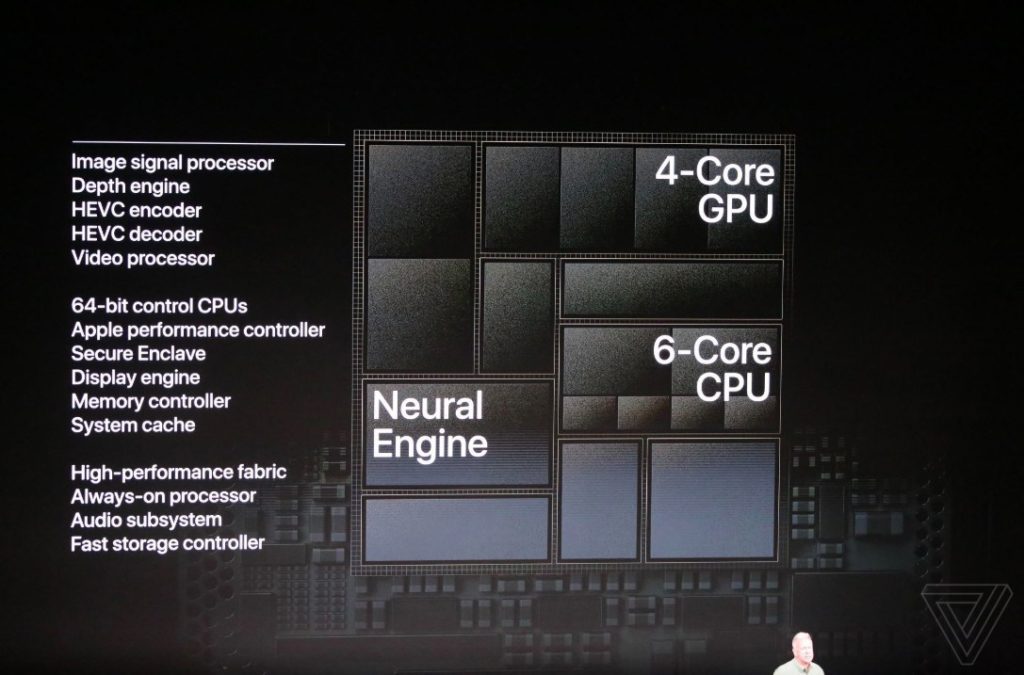

Le A12 Bionic est la première puce gravée en 7 nanomètres dans l’industrie du smartphone, et Apple la présente comme sa puce la plus puissante à ce jour. Elle regroupe un CPU à six coeurs, un GPU à quatre coeurs, mais aussi un processeur » Neural Engine » dédié au Machine Learning.

Ce Neural Engine est doté de 8 coeurs. En comparaison, celui du processeur A11 Bionic de l’iPhone X n’avait que deux coeurs. Ainsi, le A12 Bionic est capable d’effectuer 5 billions d’opérations par seconde, contre 600 milliards pour le A11 Bionic.

Cette nouvelle puce vise à aider les smartphones à comprendre le monde qui les entoure grâce à des algorithmes d’intelligence artificielle. Ceci permet notamment aux nouveaux iPhone de proposer des effets photographiques plus convaincants, ou encore des expériences de réalité augmentée.

Les algorithmes de Machine Learning permettent en effet aux applications de comprendre et de réagir à ce qui se passe sur les photos et dans les vidéos. Par exemple, lorsque l’utilisateur presse le bouton pour prendre une photo, le Neural Engine exécute un code pour comprendre rapidement la scène qu’il tente de photographier.

Il est notamment capable de distinguer une personne d’un paysage. Ceci permet d’améliorer l’effet Bokeh du mode portrait, ou encore de changer la profondeur de champ d’une photo après l’avoir prise. Le Machine Learning en temps réel va aussi permettre aux utilisateurs des nouveaux iPhone de créer des raccourcis Siri Shortcuts personnalisés, ou des emojis personnalisés » Memojis » reprenant l’apparence de l’usager.

L’iPhone Xs d’Apple permet aux développeurs d’exploiter le A12 Bionic avec Core ML 2

En 2017, c’est grâce au Neural Engine du processeur A11 Bionic que l’iPhone X pouvait proposer la fonctionnalité de reconnaissance faciale Face ID. Cependant, à l’époque, le Neural Engine n’était pas connecté au framework Core ML qui permet aux développeurs d’injecter de l’IA dans leurs applications. Avec le A12 Bionic, c’est désormais le cas. Ainsi, les développeurs tiers vont pouvoir exploiter toutes les possibilités offertes par cette puissante puce.

Les applications de Machine Learning créées avec Core ML 2 peuvent d’ailleurs être exécutées neuf fois plus rapidement avec le A12 Bionic qu’avec le A11 Bionic de l’iPhone X, tout en consommant dix fois moins d’énergie.

Pour illustrer les possibilités offertes, le développeur Nex Team a présenté une version améliorée de son application HomeCourt. Cette nouvelle version repose sur la combinaison entre le Machine Learning et la réalité augmentée.

https://www.youtube.com/watch?v=CQfrlR7X9zM

Dédiée au basketball, l’application analyse les vidéos filmées par iPhone ou iPad en temps réel afin de détecter les tirs, les paniers marqués ou ratés, et la position du joueur sur le terrain. Selon le développeur, il fallait environ deux secondes avec l’iPhone X pour présenter ces statistiques à l’utilisateur. Avec l’iPhone Xs et son nouveau processeur, les statistiques s’affichent en temps réel sans aucun délai.

L’intelligence artificielle est devenue l’un des principaux fronts sur le champ de bataille de l’industrie du smartphone. En octobre 2017, Google a lui aussi lancé son smartphone Pixel 2 équipé d’un processeur d’image capable d’exécuter des réseaux de neurones artificiels pour prendre de meilleures photos.

D’ailleurs, en avril 2018, Apple a recruté l’ancien directeur IA de Google, John Giannandrea. Aujourd’hui, Apple propose plus de 400 offres d’emploi liées au Machine Learning.

- Partager l'article :