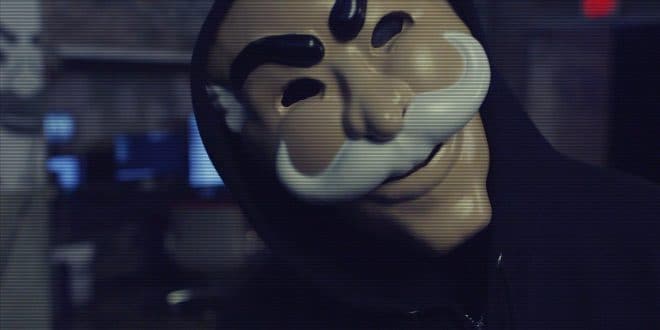

Propulsées par l’intelligence artificielle, des cyberattaques dévastatrices d’un genre nouveau pourraient apparaître d’ici 5 ans. C’est ce que révèle un rapport inquiétant en provenance de Finlande. DeepFakes ultra-réalistes, déploiement de malwares automatisé… découvrez un avant-goût du futur du cybercrime !

L’intelligence artificielle est à la source de nombreuses innovations. Au fil des derniers mois, l’IA a notamment transformé le monde de l’art grâce aux modèles génératifs comme DALL-E 2 ou MidJourney. Plus récemment, c’est le chatbot ChatGPT qui crée la sensation en répondant à n’importe quelle question instantanément.

Toutefois, cette technologie cache aussi un côté sombre. Dans un futur proche, l’IA pourrait permettre aux hackers de lancer des cyberattaques dévastatrices et potentiellement mortelles.

C’est ce que révèle un rapport publié par l’entreprise de cybersécurité WithSecure, l’Agence de Communication et Transport de Finlande, et l’Agence Nationale Finlandaise d’Approvisionnement d’Urgence.

Le rapport se penche sur les tendances actuelles et les progrès dans le domaine de l’IA, des cyberattaques, et les domaines dans lesquels les deux se croisent.

Selon cette étude alarmante, l’intelligence artificielle va se révéler extrêmement efficace pour l’usurpation d’identité : une technique fréquemment utilisée pour le phishing ou hameçonnage…

Comment l’IA va décupler la puissance de frappe des hackers

D’après Andy Patel, chercheur de WithSecure, « même si le contenu généré par IA a déjà été utilisé pour l’ingénierie sociale, les techniques IA conçues pour diriger des campagnes, effectuer les étapes d’une attaque, ou contrôler des malwares n’ont pas encore été observées dans la nature ».

Toutefois, l’expert estime que cela ne saurait tarder. Selon lui, de telles techniques « seront d’abord développées par des cybercriminels hautement compétents et disposant d’importantes ressources, comme des groupes affiliés à des gouvernements ».

Par la suite, « après que de nouvelles techniques IA soient développées par ces cybercriminels sophistiqués, il est probable que certaines deviennent accessibles aux hackers moins qualifiés et deviennent prévalentes dans le domaine du cybercrime ».

Actuellement, les attaques basées sur l’IA restent peu fréquentes et principalement exploitées pour l’ingénierie sociale, Pour cause, les IA actuelles n’arrivent pas à la cheville de l’intelligence humaine et ne peuvent planifier ou mener de cyberattaques d’une façon autonome.

Cependant, il est probable que les cybercriminels créent de nouvelles IA capables d’identifier les vulnérabilités, de planifier et de mener des attaques, d’user de discrétion pour contourner les défenses, et d’agréger des données en provenance de systèmes infectés.

Selon le rapport, de telles IA pourraient voir le jour d’ici seulement 5 ans. Le document explique que « les attaques IA peuvent être exécutées plus vite, cibler davantage de victimes et trouver plus de vecteurs d’attaque que les attaques conventionnelles à cause de la nature de l’automatisation intelligence et du fait qu’elles puissent remplacer les tâches traditionnellement manuelles ».

L’avènement de l’ère des DeepFakes

Les cyberattaques IA excelleront particulièrement pour l’usurpation d’identité, le hameçonnage (phishing), et le hameçonnage vocal (vishing). Les auteurs du rapport expliquent que « l’usurpation d’identité basée sur les DeepFakes est un exemple de nouvelle capacité apportée par l’IA aux attaques d’ingénierie sociale ».

Auparavant, « aucune technologie antérieure n’a permis de mimer la voix, les gestes et l’image d’une cible humaine de façon suffisamment convaincante pour tromper les victimes ». Ainsi, les DeepFakes pourraient bel et bien devenir la plus grande menace de cybersécurité.

Et pour cause : la plupart des systèmes de sécurité et d’authentification modernes reposent sur les technologies biométriques. Ceci concerne les passeports, les comptes bancaires, ou même nos smartphones dont le déverrouillage s’effectue par reconnaissance faciale ou capteur d’empreintes digitales.

Face à la vitesse de développement des deepfakes, les systèmes de sécurité reposant principalement sur ces technologies encourent un risque élevé.

Ces attaques pourront notamment user d’informations synthétiques, et déjouer les systèmes d’authentification biométrique. Ainsi, de nouvelles méthodes seront requises pour combattre le hacking basé sur l’IA. Ainsi, l’étude suggère que l’adoption de mesures préventives est la clé pour faire face à ces menaces…

- Partager l'article :