Le Deep Learning est actuellement la méthode la plus utilisée dans le domaine de l’intelligence artificielle. Pourtant, ses limites l’empêchent de faire face aux incertitudes. Afin de créer la première IA consciente, une tout autre technique pourrait se démocratiser au fil des années à venir…

Avec ses IA ChatGPT, DALL-E, ou plus récemment le générateur de vidéos Sora, OpenAI s’est imposé comme figure de proue dans l’industrie de l’intelligence artificielle.

Toutefois, la startup californienne s’est fixé un objectif qui dépasse de loin ces outils génératifs : elle veut donner naissance à la première AGI ou intelligence artificielle générale.

Si vous n’avez jamais entendu ce terme, il désigne une IA capable d’apprendre à effectuer n’importe quelle tâche de manière autonome, à la manière d’un humain. Une IA dotée d’une conscience…

Une telle entité soulèverait à la fois de nombreuses opportunités et d’importants risques, comme nous le soulignons dans notre vidéo ci-dessous.

Toutefois, une question se pose : est-ce que les travaux actuels dans le domaine de l’IA peuvent réellement mener à l’émergence d’une AGI ? C’est loin d’être une certitude…

Le Deep Learning : une approche limitée

Si vous vous intéressez un tant soit peu à l’IA, vous avez sûrement entendu parler du Deep Learning : une méthode de Machine Learning basée sur les réseaux de neurones artificiels et s’inspirant directement du cerveau humain.

Elle est utilisée par ChatGPT et par la plupart des IA modernes. Sa capacité à prendre en charge différents types de données et ses faibles besoins en prétraitement lui ont permis de gagner en popularité.

Beaucoup sont convaincus que l’apprentissage profond continuera à se développer et à jouer un rôle crucial dans la quête de l’AGI.

Toutefois, en réalité, le Deep Learning a ses limites. Pour créer des modèles performants, de larges jeux de données d’entraînement et des ressources de calcul colossales sont nécessaires.

Ces modèles dérivent des règles statistiques reflétant des phénomènes du monde réel. Et les règles sont ensuite appliquées aux données du monde réel pour générer des réponses.

Ainsi, les règles de Deep Learning suivent une logique focalisée sur la prédiction. Elles re-dérivent des règles mises à jour lorsque de nouveaux phénomènes sont observés.

La sensibilité de ces règles à l’incertitude du monde réel les rend peu adaptées pour atteindre l’AGI. Par exemple, en juin 2022, un Robotaxi a eu un grave accident quand le véhicule a été confronté à une nouvelle situation pour laquelle il manquait d’entraînement.

Il n’a donc pas pu prendre de décision avec certitude. Et ceci pose un grave problème.

La grande différence du cerveau humain

Les humains, qui servent de modèle pour l’AGI, ne créent pas de règles exhaustives pour les événements du monde réel. Ils perçoivent le monde en temps réel, et s’appuient sur les représentations existantes.

C’est ce qui leur permet de comprendre la situation, le contexte et tout autre facteur pouvant influencer leur décision.

Plutôt que de construire les règles pour chaque nouveau phénomène, nous recyclons les règles existantes et les modifions chaque fois que nécessaire pour la prise de décision efficace.

Par exemple, imaginez que vous marchez le long d’un sentier de forêt et trouvez un objet cylindrique sur le sol.

Si vous utilisez le Deep Learning pour prendre la prochaine décision, vous aurez besoin de rassembler des informations à propos des différentes caractéristiques de l’objet cylindrique.

Vous devrez le catégoriser comme une menace potentielle ou comme un objet non dangereux, et agir en fonction de cette classification. En l’occurrence, il s’agit de déterminer s’il s’agit d’un serpent ou d’une simple corde.

De son côté, l’humain commencera par évaluer l’objet depuis une certaine distance et mettra à jour les informations continuellement.

Il choisira alors une décision à partir d’une « distribution » d’actions qui se sont prouvées efficaces lors de précédentes situations similaires. Cette approche se focalise sur la caractérisation d’actions alternatives en vue du résultat désiré, plutôt que dans la prédiction du futur.

C’est une différence subtile, mais cruciale. Or, atteindre l’AGI pourrait nécessiter de s’éloigner des déductions prédictives pour accroître une capacité inductive basée sur les conditions quand la prédiction est impossible.

Les méthodes DMDU, la clé pour permettre à l’IA de faire face à l’inconnu ?

Il existe ainsi des méthodes de « prise de décision sous profonde incertitude » (DMDU) comme la Prise de Décision Robuste (Robust Decision-Making) qui pourraient fournir un framework conceptuel pour permettre à l’AGI de raisonner sur ses choix.

Les méthodes DMDU analysent la vulnérabilité des décisions alternatives potentielles en se basant sur différents scénarios futurs sans avoir besoin de se ré-entraîner constamment sur de nouvelles données.

Elles évaluent les décisions en se basant sur les facteurs communs essentiels parmi ces actions qui échouent à correspondre aux critères de résultats prédéterminés.

L’objectif est d’identifier les décisions qui font preuve de robustesse, à savoir la capacité à performer correctement sur divers futurs.

Alors que de nombreuses approches de Deep Learning priorisent les solutions optimisées qui peuvent échouer face à des défis inédits, les méthodes DMDU sacrifient l’optimalité contre la capacité à atteindre des résultats acceptables à travers de nombreux environnements.

Elles offrent un framework conceptuel idéal pour développer une IA pouvant naviguer au gré des incertitudes du monde réel.

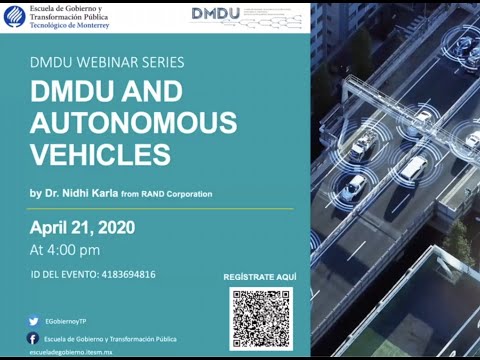

Vers la création d’un véhicule vraiment autonome ?

Pour l’heure, malgré les investissements massifs des constructeurs automobiles, le Deep Learning peine à permettre une réelle autonomie pour nos voitures.

Grâce aux méthodes DMDU, un véhicule autonome pourrait faire face aux conditions diverses et incertaines du monde réel en émulant les capacités de prise de décision des conducteurs humains.

Les capteurs de la voiture pourraient collecter des données en temps réel pour évaluer si différentes décisions sont appropriées selon les conditions de trafic : accélérer, changer de voie, freiner…

Si des facteurs critiques sèment le doute sur les réponses algorithmiques, le système pourrait alors évaluer la vulnérabilité des décisions alternatives dans un contexte donné.

Ceci réduirait le besoin immédiat d’un ré-entraînement sur des jeux de données massifs et stimulerait l’adaptation aux incertitudes du monde réel.

Un tel changement de paradigme pourrait améliorer les performances des véhicules autonomes en redirigeant l’attention vers l’évaluation des décisions plutôt que sur l’objectif d’établir des prédictions parfaites.

Comme l’explique Swaptik Chowdhury, chercheur et étudiant Ph.D à la Pardee RAND Graduat School, à mesure que l’IA évolue, nous devons nous éloigner du paradigme du Deep Learning et embrasser l’importance du contexte pour avancer vers l’AGI.

Le Deep Learning a prouvé son efficacité dans beaucoup d’applications, mais a trop de points faibles pour réaliser l’AGI. Les méthodes DMDU pourraient donc être la clé vers une nouvelle méthode robuste dirigée par les décisions et capable de faire face à l’inconnu du monde réel !

- Partager l'article :