Google DeepMind dévoile Robotic Transformer 2 (RT-2) : un modèle d’intelligence artificielle permettant aux robots de comprendre les requêtes en langage naturel à l’instar des chatbots comme Google Bard et ChatGPT ! Découvrez pourquoi c’est une petite révolution.

Apprendre aux robots n’est pas une mince affaire. Pour accomplir une action toute simple pour un humain, une machine a besoin de nombreuses instructions.

Par exemple, pour nettoyer un verre renversé, nous savons instinctivement ce qu’il faut faire : ramasser le verre, éponger l’eau et jeter le sopalin.

C’est loin d’être aussi évident pour un robot. Jusqu’à présent, les chercheurs devaient programmer individuellement toutes les directions pour leur permettre de se déplacer ou d’effectuer des mouvements.

Depuis de nombreuses années, les chercheurs tentent de trouver des solutions pour améliorer l’inférence des robots afin de les rendre plus utiles et efficaces en situation réelle.

Le 28 juillet 2023, Google DeepMind vient de faire un grand pas en avant avec le lancement de son nouveau modèle d’apprentissage IA Robotic Transformer ou RT-2.

Un bras robot qui comprend ce qu’on lui demande

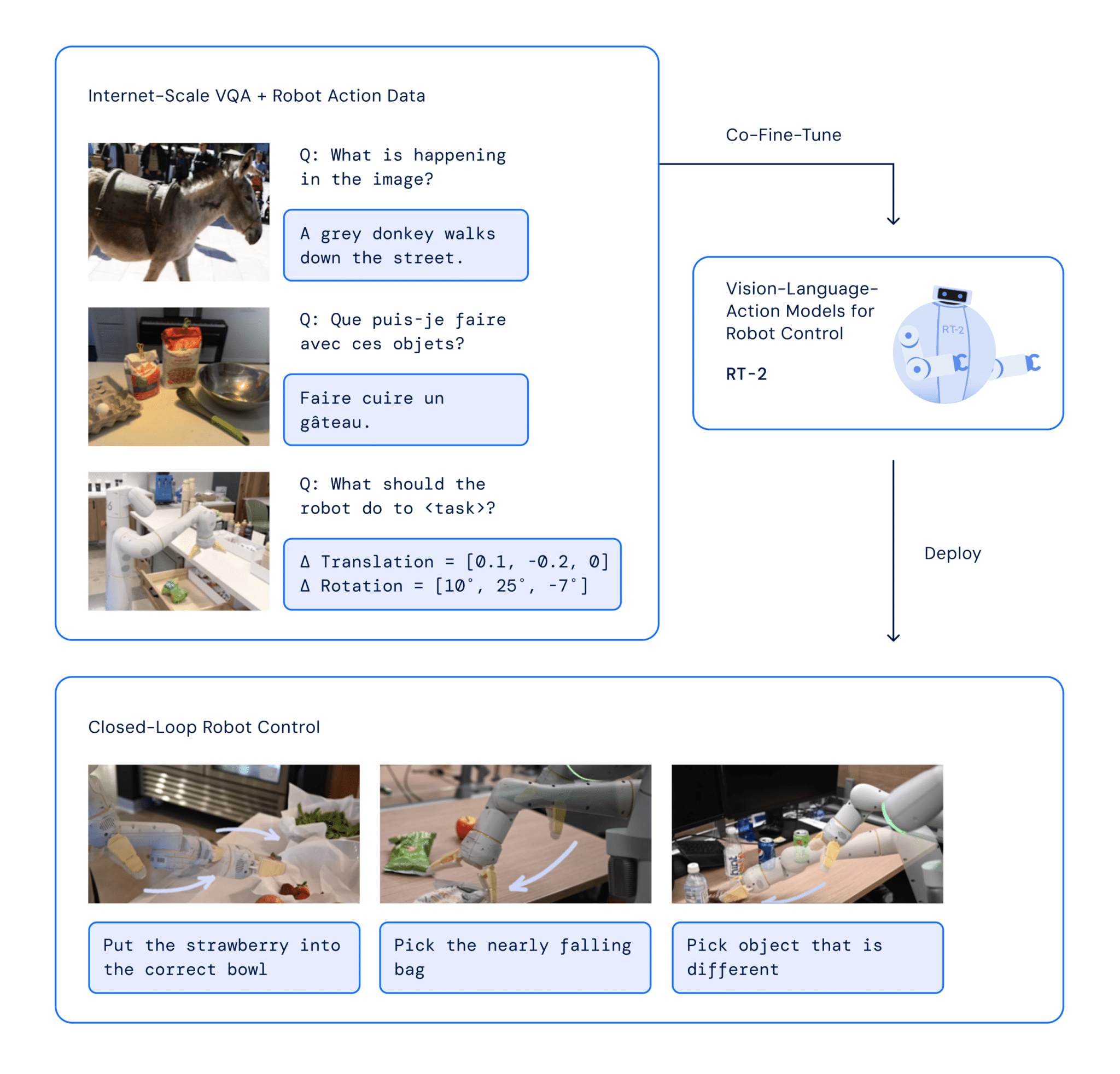

Il s’agit de la nouvelle version du modèle « vision-langage-action » (VLA) de la firme, permettant d’apprendre aux robots à mieux reconnaître les patterns visuels et de langage pour interpréter les instructions.

Grâce à cette intelligence artificielle, les machines sont capables d’accéder à une vaste mine d’informations pour déduire les actions à effectuer ou les objets à utiliser pour accomplir une tâche.

En guise de démonstration de RT-2, les chercheurs de DeepMind ont installé un bras robot dans une cuisine. Ils lui ont demandé de choisir quel objet ferait un bon marteau improvisé, et l’automate a correctement sélectionné une pierre.

De même, au moment de décider quelle boisson donner à une personne épuisée, le robot a judicieusement saisi une canette de Red Bull. Il a même réussi à déplacer une canette de Coca près d’une photo de Taylor Swift.

RT-2 : quand Google Bard rencontre la robotique

Pour parvenir à cette prouesse, le nouveau modèle RT-2 exploite les récentes avancées dans le domaine des larges modèles de langage (LLM) comme Google Bard et ChatGPT.

Cette technologie a été combinée avec des données du web et de robotique, afin de comprendre les instructions en langage naturel tout en les associant avec des mouvements mécaniques.

En d’autres termes, l’IA est capable de comprendre la signification d’une requête et de savoir quels joints robotiques activer pour effectuer l’action demandée. Elle peut même comprendre les instructions dans un grand nombre de langages !

Quelles conséquences pour l’avenir de la robotique ?

La capacité à donner des instructions en langage naturel aux robots va avoir un impact significatif sur notre futur.

Tout d’abord, ceci va rendre les robots plus accessibles aux personnes qui ne sont pas familières avec les interfaces techniques ou les langages de programmation. Tout un chacun pourra contrôler et enseigner de nouvelles tâches à son robot domestique, comme le prévoit Elon Musk avec son robot Tesla Optimus.

Plutôt que de devoir apprendre des commandes spécifiques, il suffira de communiquer avec les robots comme on le fait avec d’autres êtres humains. Les interactions seront donc fluides et intuitives.

Combining neo robot 1x tech with deepmind's rt-2 tech might lead to VERY human-like robots, I think. So I asked perplexity's #gpt4 it's take on this. #deepmind #deepmindrt2#openai #perplexityai #perplexity #neorobot1x #neorobot #robotics #twiki#twikirobot #buckrogers pic.twitter.com/IlwYjc7ARW

— William Tazzledock (@Junior89858253) July 28, 2023

Ceci va contribuer à la démocratisation des robots dans de nombreux domaines tels que l’industrie, les services domestiques, la santé ou encore l’éducation.

Les risques d’erreurs liés à une mauvaise compréhension des instructions seront considérablement réduits, améliorant leur précision et leur efficacité.

Certes, ce nouveau système n’est pas encore parfait. Lors d’une démo live offerte au New York Times, le robot a confondu des parfums de soda et des couleurs de fruit.

Néanmoins, c’est une avancée cruciale qui va permettre aux robots d’apprendre beaucoup plus vite et d’interagir avec l’humain de façon naturelle. Un nouveau cap est franchi dans la révolution à venir des robots humanoïdes !

- Partager l'article :