La nouvelle IA de Samsung est capable de transformer n'importe quel portrait photo ou dessiné en vidéo. Une technologie qui pourrait s'avérer très utile, mais présente aussi des risques de détournement…

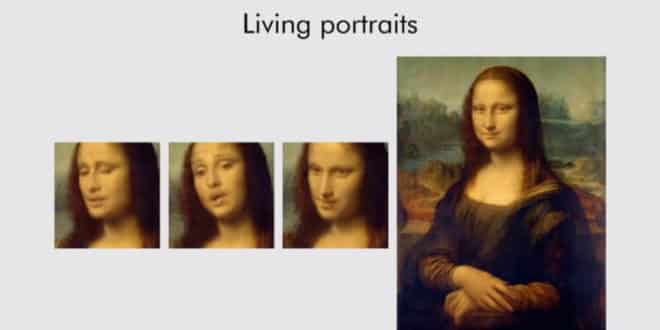

Les chercheurs du centre d'intelligence artificielle de Samsung, basé à Moscou, ont créé une intelligence artificielle capable de transformer n'importe quelle image, photo ou peinture d'un portrait humain en une vidéo dans laquelle le visage de la personne s'anime comme si elle était réellement en train de parler.

Certes, il ne s'agit pas d'une complète nouveauté. Les » deepfakes » existaient déjà auparavant, et sont d'ailleurs dangereusement utilisés à des fins de manipulation mensongère. Cependant, jusqu'à présent, cette technologie reposait sur la modélisation 3D et nécessitait de nombreuses images d'un même visage pour un résultat réaliste.

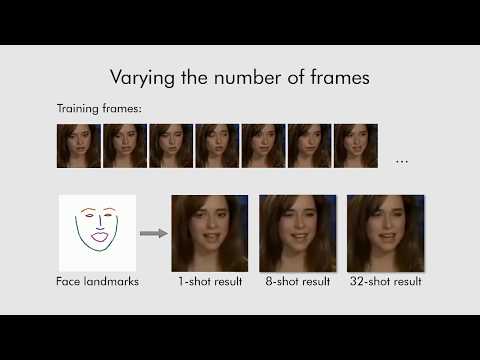

De son côté, le système développé par Samsung ne requiert qu'une seule image pour créer un modèle crédible. Avec 32 images, le niveau de réalisme maximum peut être atteint. Pour parvenir à un tel résultat, l'IA applique les caractéristiques faciales d'un » visage source » sur un » visage cible « . Ainsi, le visage cible reproduit les expressions du visage source.

L'IA de Samsung peut créer des » deepfakes » à partir d'une seule image

La raison pour laquelle l'IA de Samsung ne requiert qu'une image est que le système a accès à une large base de données de vidéos de » têtes parlantes « correspondantes à différents orateurs d'apparences variées. De fait, l'intelligence artificielle peut créer une large diversité de modèles réalistes.

Dans un second temps, le système utilise un réseau antagoniste génératif (GAN) pour comparer les différents modèles et déterminer lequel est le plus réaliste. Ainsi, le système peut choisir un modèle final qui sera utilisé pour la séquence vidéo.

Selon Samsung, cette IA pourrait se révéler très utile pour la téléprésence, pour des cas d'usage tels que la vidéoconférence et les jeux vidéo multijoueurs. Elle peut aussi être exploitée dans l'industrie des effets spéciaux.

Cependant, on peut aussi craindre qu'elle soit détournée par des personnes mal intentionnées à des fins de manipulation. Par exemple, il serait possible de s'en servir pour faire croire qu'une personne a dit quelque chose qu'elle n'a pas dit…

- Partager l'article :