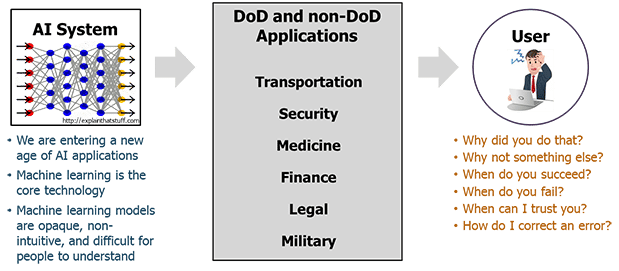

L’IA Explicable permet de comprendre les rouages du fonctionnement de l’intelligence artificielle et son utilité dans divers secteurs. Elle permet d’éclairer et d’accepter l’utilisation de l’IA par les humains. Plus exactement, elle aide à comprendre comment un programme informatique en est arrivé à telle ou telle décision.

La plupart des entreprises utilisent d’intelligence artificielle pour accélérer les prises de décision. Cela réduit effectivement les coûts, mais facilite également le travail. Seulement, lorsqu’une banque utilise l’IA pour refuser un crédit ou quand une entreprise s’en sert pour licencier un employé, c’est là que tout devient flou. La résolution d’un tel problème fait intervenir ce qu’on appelle Intelligence Artificielle Explicable ou XAI. Les utilisateurs de l’IA ont besoin de comprendre le fonctionnement du programme et le mode par lequel celle-ci évalue les résultats. Sans cette explication, l’IA deviendra moins importante et moins fiable pour les humains. Pour éclaircir le sujet, on va découvrir ce qu’est l’IA Explicable, son importance, ses objectifs, les avantages qu’il procure, etc.

Qu’est-ce que l’IA Explicable ?

Parallèlement au développement de l’IA, les humains se sentent de plus en plus écartés du processus de prise de décision. Du coup, on a besoin de comprendre la façon dont l’algorithme a procédé pour arriver à tel ou tel résultat, d’où l’introduction de l’IA Explicable, la XAI ou l’eXplainable AI.

Pour faire simple, cette notion renvoie à un principe, un mode opératoire par lequel une intelligence artificielle passe pour prendre une décision. La XAI intègre en même temps les résultats obtenus tout en indiquant le chemin opté pour y parvenir. Cette approche s’oppose au principe de la boîte noire où rien ne peut être interprété même par les plus doués des scientifiques.

En d’autres termes, l’eXplainable AI englobe des processus et des méthodes compréhensibles pour les humains ainsi que les algorithmes ML permettant d’obtenir les résultats. Cet aspect de l’IA accède à une transparence et facilite la traçabilité d’un résultat. Il permet également de détecter les biais potentiels.

Lorsqu’une organisation souhaite obtenir des résultats avec précision et instaurer un climat de confiance à l’aide de l’IA, elle recourt à une telle méthode. Par ailleurs, celle-ci permet de se prémunir de tout dysfonctionnement potentiel pouvant affecter la décision à prendre ou modifier le résultat final.

IA ordinaire vs XAI : quelle différence ?

L’intelligence artificielle diffère de l’IA Explicable sur un certain nombre de points. De prime abord, en utilisant une IA, on parvient toujours à un résultat à partir d’un algorithme d’apprentissage automatique.

Seulement, on ne peut pas expliquer comment l’algorithme a opéré pour obtenir un tel résultat. Ce qui signifie en quelque sorte que l’IA fait référence à la fameuse boîte noire. Par conséquent, il est difficile de confirmer l’exactitude du résultat. Cela va ensuite entraîner une certaine perte de fiabilité de ce même résultat.

En revanche, la XAI consiste à la mise en œuvre des méthodes spécifiques en vue de retracer et d’expliquer le chemin emprunté lors d’une prise de décision. Dans cette optique, les utilisateurs peuvent s’assurer que chaque décision prise via l’algorithme d’apprentissage automatique soit non biaisée. Sinon, ils seront en mesure de prendre les décisions corrigeant cette anomalie.

Dans quel objectif ?

Avoir confiance en l’intelligence artificielle, c’est le but ultime de l’IA Explicable. En effet, l’IA est devenue un élément incontournable dans le quotidien de la société actuelle, que ce soit sur le plan professionnel ou privé. Aujourd’hui, bon nombre de personnes optent pour les appareils intelligents comme les smartwatch pour leur faciliter la vie. De même, les applications utilisées par le gouvernement et les entreprises sont dotées d’une IA.

Cela signifie qu’on ne peut plus se passer de la nouvelle technologie dans quasiment tous les aspects de la vie. Mais pour cela, on doit lui accorder une entière confiance. De nombreux utilisateurs de l’IA ont d’ailleurs commencé à puiser dans cette direction.

Prenons, par exemple, le cas de la société Nvidia en 2017. La firme a publié, via ses développeurs, un article de blog expliquant comment conduire une voiture de manière autonome au moyen de l’IA. L’article a mis en évidence des résultats de recherche tout en dévoilant le processus d’apprentissage de l’IA en se basant sur des exemples faciles.

Quelques cas d’utilisation

L’IA explicable s’utilise désormais dans quasiment tous les domaines dont les plus importants sont la médecine, la défense, l’industrie automobile, etc. De nombreuses institutions médicales optent pour l’IA explicable dans le but de prédire le risque encouru par les patients. Cela va leur sensibiliser et leur permettre de choisir les interventions à des fins préventives.

En ce qui concerne l’industrie automobile, celle-ci a aussi introduit la méthode de l’IA explicable. Prenons par exemple le cas du park assist. Cette technologie permet au conducteur de rester serein pendant que l’intelligence artificielle à bord du véhicule s’occupe du parking. En effet, sans savoir comment la machine a agi pour y arriver, le conducteur pourrait être sceptique à l’idée de laisser une machine prendre le contrôle de son véhicule et de sa vie avec.

En quoi l’eXplainable AI est-elle importante ?

L’intelligence artificielle est d’une grande aide pour les humains. Cependant, il faut se souvenir qu’il s’agit d’un fruit de nos prouesses au fil des années. Ce qui signifie qu’elle ne peut pas toujours être parfaite. Parfois, l’IA montre des failles et est assortie d’erreurs.

Au regard de ce qui a été dit, on ne peut pas toujours accorder une confiance aveugle à l’IA. Toutes les décisions prises en tenant compte des résultats affichés par une machine ne sont pas toujours fiables. Les modèles de boîte noire ne suffisent pas à prendre une décision sans que l’on sache comment et pourquoi faut-il agir ainsi. C’est toute l’importance de l’AI Explicable car elle accède à une entière compréhension de ce qui est ou qui doit être.

L’interprétation des modèles de ML est loin d’être un jeu d’enfant. Comprendre les réseaux neuronaux qu’on utilise dans le processus de ML n’est pas évident pour un humain. Certains critères tels que le sexe, l’âge ou la race aboutissent à des résultats biaisés difficiles à comprendre.

Par ailleurs, les décalages entre les différents types de données peuvent dégrader le processus, et donc le résultat. De ce fait, l’entreprise est tenue de contrôler les modèles à tout moment afin d’avoir un aperçu de l’impact de l’utilisation de la XAI dans l’entreprise. On peut également mentionner l’importance de l’IA explicable en matière d’audit et de conformité au sein d’une organisation. Ce qui va booster sa visibilité et sa réputation.

Enfin, l’adoption et la mise en œuvre de l’IA responsable repose en majeure partie sur l’IA explicable. On parle ici de la mise en œuvre à grande échelle des techniques d’IA tout en se basant sur des principes éthiques et responsables.

Les avantages de l’IA explicable

L’importance de la XAI se traduit par de nombreux avantages que nous allons voir de près dans le paragraphe suivant. En fait, l’adoption de l’IA explicable accède à 3 avantages particuliers :

Une entière confiance dans l’exploitation de l’intelligence artificielle

Pour une entreprise, l’adoption d’un processus automatisé permet d’augmenter la productivité. Avoir une entière confiance à l’IA permet de produire plus. L’introduction rapide des modèles d’IA dans la production résulte de ce climat de confiance entre l’humain et la machine.

En plus, quand l’organisation arrive à se fier à l’IA, elle peut travailler en toute transparence et en toute tranquillité. La traçabilité des résultats étant assurée, il n’y a plus rien à craindre dans le processus productif.

Obtenir des résultats rapides au moyen de l’IA

L’IA accède à une célérité du processus productif. Néanmoins, il faut opter pour un contrôle et une surveillance systématiques des modèles afin de s’assurer qu’il n’y a pas d’erreur ni de biais. Un modèle performant permet d’obtenir des résultats satisfaisants. Ce qui implique la nécessité de procéder à une évaluation continue des modèles d’IA.

L’IA explicable permet de réduire les coûts et le risque

Dans une entreprise, il faut opter pour des modèles d’IA explicable qui s’avèrent transparents. Cela permet de réduire les coûts de la gestion mais aussi de minimiser, sinon d’écarter tout risque lié à cette gestion des modèles. Dans ce cas, l’inspection manuelle, tout comme les erreurs, ne vont plus occasionner des coûts supplémentaires. Il en est de même pour les biais involontaires provoqués par les erreurs humaines.

Les différentes méthodes pour mettre en place les techniques XAI

Puisque la XAI procure autant d’avantages particuliers, son adoption est alors d’une nécessité. Pour cela, il faut adopter une méthode efficace. Dans cette partie, on va découvrir 4 méthodes par lesquelles on peut mettre en œuvre l’IA explicable.

En premier lieu, il y a la Layer-wise Relevance Propagation ou LRP. En français, cela consiste en une technologie qui permet de définir les spécificités des vecteurs d’entrée. Ces derniers participent amplement au résultat de sortie d’un réseau neuronal.

En second lieu, on a ce qu’on appelle Counterfactual Method. Celle-ci fait référence à la manière dont on modifie les entrées de données une fois qu’on ait obtenu un résultat. L’observation se porte ensuite sur les conditions entraînant la modification des résultats.

Après ces deux méthodes, on peut aussi citer les LIME ou Local Interpretable Model-Agnostic Explanations. Il s’agit de modèle d’explication basée sur une approche holistique. L’explication peut se porter sur tout classificateur mécanique ainsi que les prédictions qui s’ensuivent. Avec une telle méthode, même les non-initiés peuvent accéder aux données et aux méthodes.En dernier lieu, on a la rationalisation. Cette méthode s’applique uniquement lorsqu’on est face à des robots basés sur l’IA tels que le ChatGPT. Ici, la machine est dotée d’une autonomie qui lui permet d’expliquer ses actions.

- Partager l'article :