Le CEO de Nvidia, Jensen Huang, vient de révéler dans combien de temps il estime qu’une IA générale capable de rivaliser avec l’intelligence humaine va voir le jour. Si vous pensiez avoir encore du temps devant vous, vous risquez d’être déçu…

C’est l’une des grandes questions qui se posent dans le domaine de l’IA : dans combien de temps les machines seront-elles suffisamment intelligentes pour égaler l’humain, voire le surpasser ?

Si les experts s’accordaient encore récemment à dire que cette « singularité technologique » ne surviendrait pas avant plusieurs décennies, l’émergence des LLM comme GPT a chamboulé ces estimations.

Ainsi, le CEO de SoftBank, Masayoshi Son, prédisait récemment l’apparition d’une « IA générale » (AGI) comparable à l’humain d’ici 10 ans, et celle d’une « super intelligence artificielle » 10 000 fois supérieure d’ici 20 ans.

Même son de cloche chez Alphabet DeepMind, dont le CEO Demis Hassabis anticipait en mai 2023 l’éveil d’une intelligence artificielle de niveau humain avant l’année 2033. Un avis partagé par John Carmack, ancien cadre de Meta et légende de l’industrie du jeu vidéo.

Une IA générale dans 5 ans selon Jensen Huang

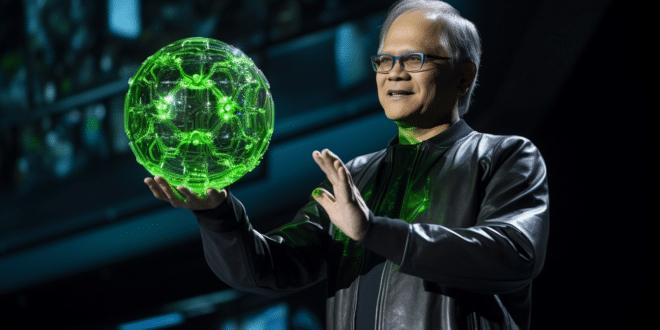

À présent, c’est au tour de l’un des principaux acteurs de l’industrie de livrer son pronostic : Jensen Huang, le CEO de Nvidia. Rappelons que cette entreprise américaine est le principal fournisseur mondial de GPU utilisés pour entraîner les IA.

Selon lui, la date à laquelle l’intelligence artificielle nous égalera est encore plus proche. Et si ses prévisions s’avèrent exactes, nous devrions réellement commencer à nous inquiéter…

Lors du sommet New York Times DealBook Summit, le journaliste Andrew Ross Sorkin a demandé à Huang s’il s’attend à voir une IA générale au cours des dix prochaines années. Sa réponse : « selon la façon dont vous la définissez, je pense que la réponse est oui ».

Il a également livré sa propre définition d’une AGI, à savoir un morceau de logiciel ou un ordinateur capable de compléter des tests reflétant une intelligence basique « à peu près compétitive » avec celle d’un humain normal.

Or, en se basant sur cette description, il estime que « dans les cinq prochaines années, vous allez voir, évidemment, des IA qui peuvent réussir ces tests ». En d’autres termes, la première AGI pourrait voir le jour dès 2028…

Les employés de Nvidia bientôt remplacés par l’IA ?

Toutefois, le CEO de Nvidia n’a pas précisé à quoi cette AGI ressemblerait exactement. Le journaliste lui a donc demandé si une telle IA serait capable de concevoir seule les puces que Nvidia fabrique actuellement.

Réponse positive. En réaction, Ross Sorkin lui a donc demandé s’il garderait les employés qui les conçoivent à l’heure actuelle. Une question qui fâche, face aux prédictions d’un grand remplacement du travail humain par l’IA…

Plutôt que de répondre franchement, Huang a préféré souligner que « en effet, aucune de nos puces n’est possible à l’heure actuelle sans IA ». Par exemple, les puces H-100 vendues actuellement ont été conçues avec l’aide de l’intelligence artificielle.

D’après le chef d’entreprise, « le logiciel ne peut pas être écrit sans IA, les puces ne peuvent pas être conçues sans IA, rien n’est possible ».

ChatGPT et les autres IA actuelles sont loin de l’AGI

Quoi qu’il en soit, même si l’IA se développe plus rapidement qu’il ne s’y attendait, Huang affirme que la technologie n’a pas encore montré de signes laissant penser qu’elle peut égaler ou surpasser l’intelligence humaine complexe pour le moment.

Selon ses dires, « il n’y a aucun doute que le taux de progression est élevé, mais il y a encore plein de choses que nous ne pouvons pas encore faire ». Par exemple, « le raisonnement multi-étapes pour lequel les humains sont très doués, l’IA ne peut pas encore le faire ».

Un grave danger pour les humains ?

Les prédictions de Jensen Huang risquent de renforcer l’anxiété de nombreux experts concernant l’IA générale. Si la façon dont il définit une telle IA ne laisse présager d’aucun danger, certains ont une vision bien moins optimiste.

Selon Ilya Sutskever, co-fondateur de OpenAI, l’entreprise qui a créé ChatGPT, une IA trop avancée créera forcément des problèmes comme une prolifération de Fake News et de cyberattaques, l’émergence d’armes automatisées, ou encore des « dictatures infiniment stables ».

De même, Ian Hogarth, qui a investi dans plus de 50 entreprises IA, estime qu’une future « IA divine » risque de mener à « l’obsolescence ou la destruction de la race humaine » si le développement effréné de cette technologie n’est pas régulé…

- Partager l'article :

Savent plus quoi inventer pour vendre leur « IA »,

tous ces vulgaires algorithmes perfectionnés certes vont vite retomber comme un soufflet.

A part les entreprises qui vont remplacer leur SAV par des réponses toutes faites et appeleront ça « des agents conversationnels » afin de laisser encore un peu plus l’utilisateur final se débrouiller tout seul, l' »IA » n’apportera rien, elle ne va pas sauver l’humanité, les ALGORITHMES font juste la meme chose que faisait mon lave linge vieux de 15 ans : détecter une situation (quantité de linge) et adapter la réponse (quantité d’eau) en fonction, le seul exploit est d’intégrer à la réponse du language naturel mais c’est tout