Les chercheurs de Stanford dévoilent Mobile ALOHA : une IA permettant d’apprendre à un robot à effectuer des tâches complexes à partir de seulement 50 démonstrations par un humain ! Grâce à ce système, les robots seront bientôt capables de faire toutes vos corvées à votre place !

C’est Elon Musk qui l’a dit en 2022, lors de la présentation du prototype de son robot humanoïde Tesla Optimus : d’ici 2050, nous aurons tous à la maison un robot capable de faire toutes les corvées à notre place.

Pourtant, de nombreuses personnes ne croient pas à cette prédiction, et sont convaincues que les robots IA généralistes demeurent un fantasme de science-fiction.

Cyniques, ces gens sont persuadés que le seul but des startups de l’industrie robotique est de vendre de belles promesses aux investisseurs pour lever des fonds…

Ils ne réalisent pas la révolution qui se prépare, comme nous l’évoquons dans notre dossier complet dédié aux robots humanoïdes et disponible à cette adresse.

À présent, un nouveau système IA développé par les chercheurs de la Stanford University démontre une fois de plus que les robots sont sur le point de changer nos vies.

Dénommé Mobile ALOHA (A Low-cost Open-Source Hardware System for Bimanual Teleoperation), ce système représente une percée majeure dans l’entraînement de robots mobiles pouvant effectuer des tâches complexes dans différents environnements.

Il relève les défis liés aux coûts élevés et aux difficultés techniques dans l’entraînement des robots mobiles bimanuels qui requièrent les conseils et l’attention d’opérateurs humains.

Pour une fraction du coût des systèmes disponibles dans le commerce, il peut apprendre à partir de seulement 50 démonstrations humaines. Il s’agit une nouvelle fois d’une innovation découlant de l’essor récent de l’IA générative.

Quelles sont les limites des robots actuels ?

La plupart robots existants se focalisent sur des manipulations sur table. C’est notamment le cas de la récente vague de modèles basés sur les modèles à diffusions et Transformers.

Ces deux architectures sont très utilisées dans l’IA générative, avec pour exemples respectifs Stable Diffusion et GPT.

Cependant, beaucoup de ces modèles manquent cruellement de mobilité et de dextérité nécessaires pour effectuer des tâches réellement utiles. Dans la vie de tous les jours, de nombreuses tâches requièrent de coordonner ces deux capacités.

Comme l’expliquent les chercheurs de Stanford dans leur étude, « l’ajout de degrés de liberté additionnels complique l’interaction entre les actions des bras et de la base, et une petite déviation de la base peut mener à de larges décalages du bras ».

Ils soulignent aussi que « les précédents travaux n’ont pas délivré de solution convaincante et pratique pour la manipulation mobile bimanuelle, tant pour le hardware que l’apprentissage ».

Voici Mobile ALOHA, l’IA qui va transformer les robots en domestiques

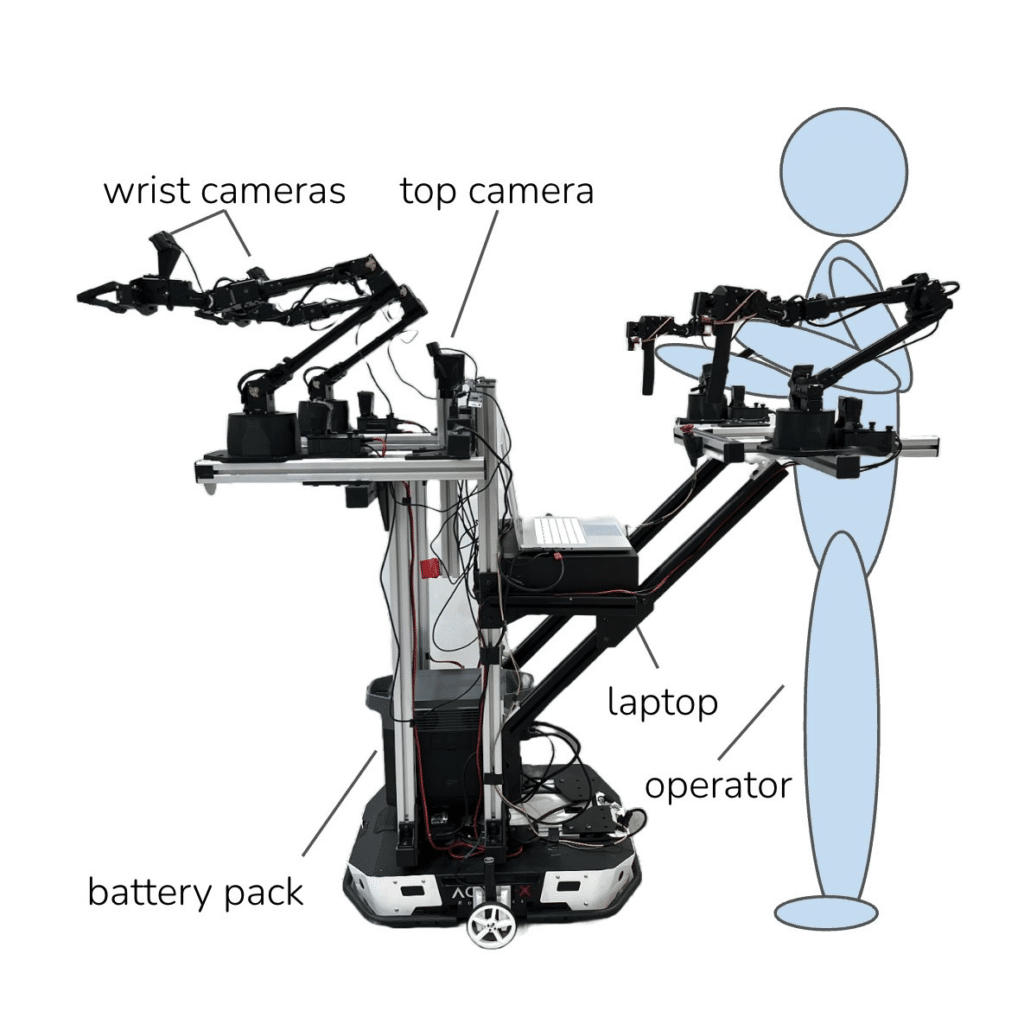

C’est là qu’entre en jeu Mobile ALOHA, le nouveau système de Stanford. Il est basé sur ALOHA, un système abordable de téléopération pour la collecte de données de manipulation mobile bimanuelle.

Un opérateur humain fait une démonstration de tâches en manipulant les bras du robot via un contrôle téléopéré. Le système capture les données de démonstration et les utilise pour entraîner un système de contrôle via l’apprentissage par imitation.

Cette version mobile étend le système en le montant sur une base roulante. Elle est conçue pour fournir une solution d’entraînement des systèmes robotiques à moindre coût.

Au total, le dispositif incluant des webcams et un laptop avec GPU grand public coûte environ 32 000 dollars. C’est beaucoup moins que les robots bimanuels disponibles dans le commerce, dont le prix avoisine généralement 200 000 dollars.

De plus, Mobile ALOHA est conçue pour téléopérer tous les degrés de liberté simultanément. L’opérateur humain est connecté au système par la ceinture, et pilote la machine autour de l’environnement de travail tout en contrôlant les bras avec des manettes.

Ceci permet au système de contrôle d’apprendre simultanément des mouvements et d’autres commandes de contrôles. Après avoir assemblé suffisamment d’informations, le modèle devient capable de répéter la séquence de tâches de manière autonome.

Ce système peut être utilisé pendant plusieurs heures consécutives, et les résultats sont tout simplement impressionnants. Un simple entraînement sur une recette lui permet d’apprendre des tâches de manipulation mobile hautement complexes.

La démo partagée par Stanford montre le robot cuisiner un menu à trois plats avec des tâches délicates comme casser des oeufs, émincer l’ail, verser du liquide, déballer des légumes, ou encore retourner le poulet sur une poêle à frire.

Par ailleurs, Mobile ALOHA peut effectuer une large variété de tâches ménagères : arroser les plantes, utiliser l’aspirateur, charger et décharger le lave-vaisselle, prendre une boisson dans le frigo, ouvrir des portes, ou même utiliser la machine à laver.

La magie de l’apprentissage par imitation et du co-entraînement

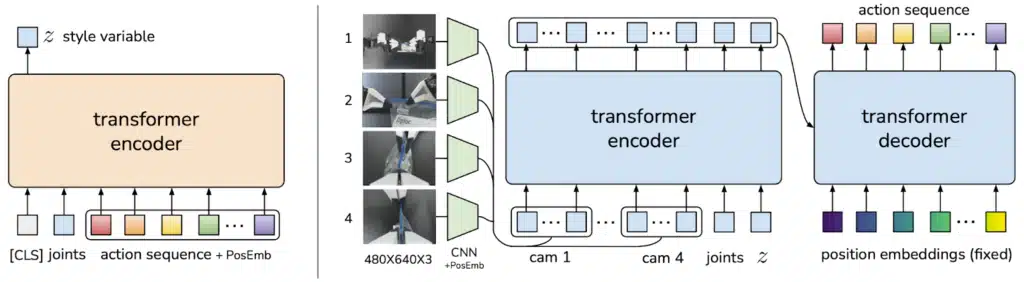

Comme beaucoup de travaux récents dans la robotique, Mobile ALOHA tire profit des Transformers : l’architecture créée par Google en 2017, utilisée par les larges modèles de langage tels que GPT d’OpenAI.

Le système ALOHA d’origine utilisait une architecture appelée Action Chunking with Transformers (ACT) prenant des images de multiples points de vue et les positions de joints en guise d’input pour prédire une séquence d’actions.

À présent, la version mobile ajoute les signaux de mouvement comme input. Ceci lui permet de réutiliser les précédents algorithmes d’apprentissage par imitation avec des changements minimes.

Selon les chercheurs, « nous observons que le simple fait de concaténer les actions de la base et des bras, puis de l’entraîner via un apprentissage par imitation directe, peut produire de solides performances ».

Plus précisément, « nous concaténons les positions communes à 14 DoF d’ALOHA avec la vitesse linéaire et angulaire de la base mobile, formant ainsi un vecteur d’action à 16 dimensions ».

Une avancée rendue possible par les travaux Google DeepMind

Par ailleurs, ce projet bénéficie aussi du succès des récentes méthodes permettant de pré-entraîner les modèles sur divers datasets robotiques issues d’autres projets.

L’un d’entre eux est RT-X, un projet mené par DeepMind et 33 institutions de recherche combinant plusieurs jeux de données robotiques pour créer des systèmes de contrôle pouvant généraliser bien au-delà de leurs données d’entraînement et des morphologies de robots.

Aux dires des chercheurs, « malgré les différences dans les tâches et les morphologies, nous observons un transfert positif dans presque toutes les tâches de manipulation mobile, atteignant des performances et une efficacité de données équivalentes ou supérieures aux règles entraînées en utilisant uniquement les données Mobile ALOHA ».

L’utilisation de données existantes a permis aux chercheurs d’entraîner Mobile ALOHA pour des tâches complexes avec très peu de démonstrations humaines.

D’après Stanford, « avec le co-entraînement, nous sommes capables d’obtenir 80% de succès sur ces tâches avec seulement 50 démonstrations humaines par tâche, avec une moyenne d’amélioration absolue de 34% ».

Bientôt dans toutes les chaumières ?

Malheureusement, malgré ses résultats bluffants, Mobile ALOHA présente encore de gros défauts. Son format imposant ne le rend pas adapté aux environnements étroits.

À l’avenir, les chercheurs prévoient d’améliorer le système en ajoutant davantage de degrés de liberté et en réduisant le volume du robot.

Notons aussi qu’il ne s’agit pas d’un système pleinement autonome capable d’explorer de nouveaux environnements par lui-même.

Comme le Figure 01 qui vient d’apprendre à préparer le café, il requiert encore des démonstrations complètes d’opérateurs dans son environnement. Toutefois, le nombre d’exemples nécessaires est largement réduit par rapport aux anciennes méthodes.

Les chercheurs vont explorer des changements à apporter au modèle IA, qui permettront au robot de s’améliorer seul et d’acquérir de nouvelles connaissances.

Ce projet de recherche va permettre d’accélérer le développement de robots mobiles polyvalents, versatiles, qui nous mène inexorablement vers l’émergence de robots grand public capables de nous prêter main forte !

- Partager l'article :