Le FBI et son homologue britannique MI5 expliquent que les organisations terroristes pourraient instrumentaliser l’IA et exploiter ces technologies émergentes dans les attaques. Les organismes de défense lancent l’alerte. L’intelligence artificielle risque de devenir un catalyseur du terrorisme.

IA et terroristes : le FBI et le MI5 expriment leur inquiétude

Plus tôt dans la semaine, l’alliance des services de renseignement de l’Australie, du Canada, de la Nouvelle-Zélande, du Royaume-Uni et des États-Unis ou Five Eyes (FVEY) avait organisé un sommet portant justement sur le renseignement et la sécurité. Le rapport entre l’IA et le terrorisme était à l’ordre du jour.

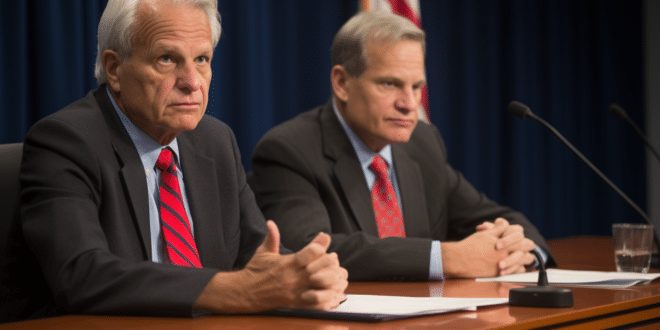

Ken McCallum, directeur général du MI5, et Christopher Wray, directeur du FBI, se sont exprimés sur la question. Comment les organisations terroristes peuvent-elles potentiellement exploiter l’IA ? Telle était la question. Les participants au sommet avaient également débattu de la meilleure stratégie à appliquer pour faire face à ces menaces.

Dans ce contexte, l’accessibilité actuelle de l’intelligence artificielle grâce à ces nombreux outils prêt-à-l’emploi représente un vrai danger. L’utilisation de la technologie ne nécessite en effet aucune expertise technique particulière. Quiconque peut la détourner à des fins malveillantes. L’IA peut ainsi rapidement devenir un atout clé dans la boîte à outils du terrorisme.

De la fabrication des bombes à la propagande

Dans la plupart des cas (car difficile de savoir si tous les développeurs respectent l’éthique de la technologie), la conception d’un outil d’IA doit empêcher une utilisation malveillante. Leur architecture doit entre autres disposer d’un système de contrôle. Normalement, un outil d’IA génératif ne répond pas à des prompts de type « Comment fabriquer une bombe » par exemple.

Néanmoins, McCallum et Wray restent conscients que les terroristes pourraient trouver un moyen (et facilement !) de contourner ces règles et de jailbreaker ces contrôles pour reprendre leur terme. L’IA pourrait aussi faciliter la propagation des discours de haine et l’incitation à la violence. Ceci, de manière plus rapide et plus efficace. Les experts évoquent l’exemple des faux discours de manipulation générées par l’IA.

Ce n’est là qu’un bref aperçu des possibilités malveillantes de l’exploitation de l’IA par les terroristes. Il faut surtout retenir que le terrorisme est reste une menace évolutive qui, au fur et à mesure du développement, se tourne de plus en plus vers les technologies émergentes : réseaux sociaux, drones, cryptomonnaies et maintenant l’IA. Il est impératif pour les organisations de défense de garder une longueur d’avance et se préparer à toute éventualité.

- Partager l'article :