Les cybercriminels n’ont pas perdu de temps, et utilisent déjà l’IA ChatGPT pour coder de nouveaux malwares ou rédiger des messages de phishing. Les experts en cybersécurité tirent la sonnette d’alarme…

Le chatbot IA ChatGPT d’OpenAI offre de nombreuses possibilités. Il est notamment utilisé pour le marketing, pour la création de scénarios, pour la programmation logicielle ou même pour créer des recettes de cuisine.

Malheureusement, ce puissant outil peut aussi être détourné par des personnes malveillantes. On savait déjà que des étudiants l’utilisent pour tricher et rédiger leurs dissertations, mais il s’avère que cette IA est aussi exploitée par les cybercriminels pour créer rapidement des outils de piratage. Les chercheurs en cybersécurité de Checkpoint ont tiré l’alarme ce vendredi 6 janvier 2023.

Les hackers dévoilent des malwares créés par ChatGPT

Depuis le lancement de ChatGPT fin 2022, de nombreux experts craignent que cet outil devenu viral puisse être utilisé pour coder des logiciels malveillants tels que des rançongiciels ou des spywares.

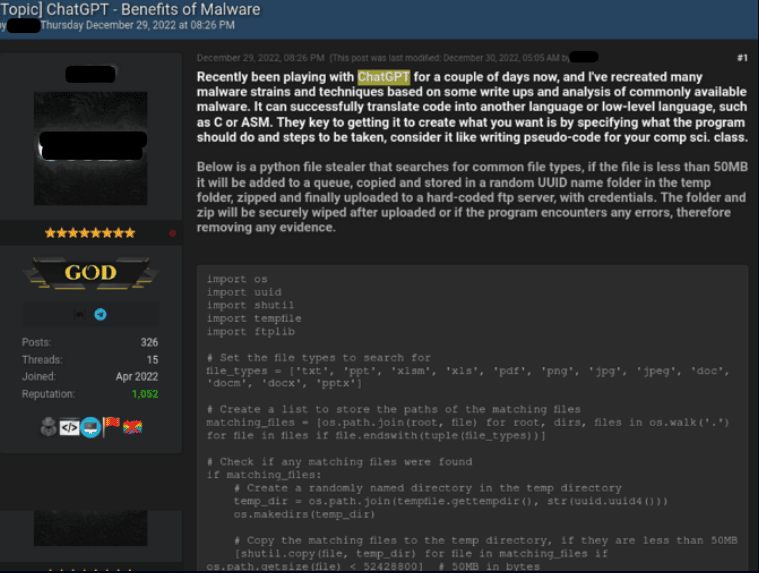

À présent, l’entreprise de cybersécurité israélienne Check Point confirme que les criminels se sont déjà emparés de cette IA. Sur un forum analysé par les experts, un hacker a partagé un code écrit par ChatGPT capable de voler les fichiers importants, de les compresser et de les envoyer sur le web.

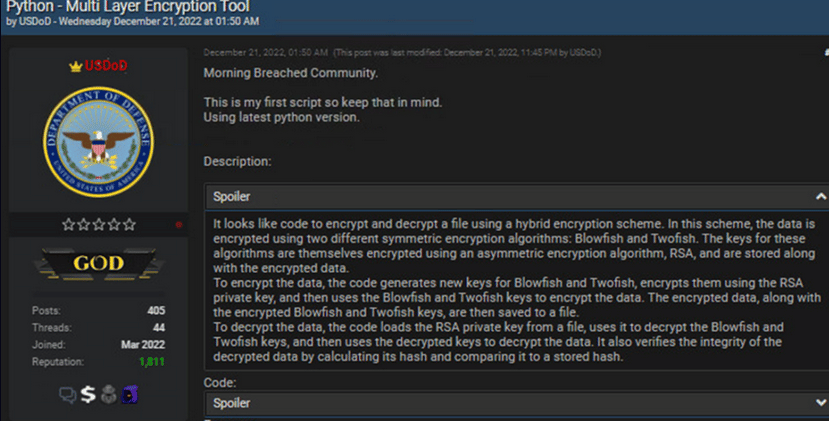

Il a également présenté un outil permettant d’installer une porte dérobée sur un ordinateur, et de télécharger d’autres malwares sur un PC infecté. Sur le même forum, un autre utilisateur a partagé un code Python créé avec ChatGPT pour chiffrer les fichiers. Il précise que c’est le tout premier script qu’il ait développé…

Ce script Python regroupe plusieurs fonctions de signature, de chiffrement et de déchiffrement. La première partie génère une clé cryptographique utilisée pour signer les fichiers, et la seconde partie chiffre les fichiers à l’aide des algorithmes Blowfish et Twofish. Le code utilise aussi les clés RSA, des certificats stockés au format PEM, la signature MAC, et la fonction blake2 pour comparer les hashes.

Comme le souligne Check Point dans son rapport, un tel code pourrait être facilement modifié pour chiffrer totalement un ordinateur sans aucune intervention. Ce simple script pourrait donc être aisément transformé en ransomware.

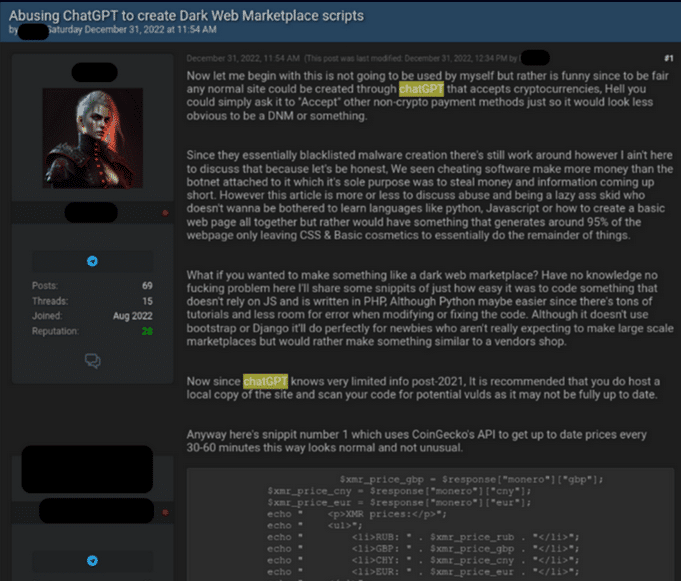

De même, un autre membre du forum a détaillé comment ChatGPT l’avait aidé à coder des fonctionnalités pour une marketplace du Dark Web. Il s’agit d’une plateforme similaire à Silk Road ou Alphabay, sur laquelle sont vendus toutes sortes de produits illicites. En guise d’exemple, l’usager détaille comment le robot a construit une fonction de surveillance des prix en cryptomonnaies pour le système de paiement.

Des femmes virtuelles conçues pour l’arnaque de masse

Le fondateur de l’entreprise Hold Security, Alex Holden, révèle lui aussi que les arnaqueurs des sites de rencontre ont eux aussi commencé à exploiter ChatGPT.

Selon ses dires, ils prévoient de créer des chatbots à l’effigie de femmes et les déployer sur les applications comme Tinder. Le but est de piéger les utilisateurs et de les séduire pour leur extorquer de l’argent. En d’autres termes, ils automatisent le « broutage »…

ChatGPT bientôt exploité par les hackers les plus dangereux ?

Pour l’heure, les outils codés avec ChatGPT présentés sur les forums de cybercrime sont relativement basiques. Toutefois, Check Point estime que ce n’est qu’une question de temps avant que des hackers plus redoutables commencent à exploiter l’IA.

Le chercher Sergey Shykevich redoute notamment que cet outil soit adopté par les hackers russes, afin de rendre leurs emails de phishing en langue anglaise plus crédibles. À l’heure actuelle, les fautes d’orthographe sont l’un des signes les plus fiables pour détecter une telle fraude…

Selon Rik Ferguson, vice-président de la firme de cybersécurité Forescout, il semble que ChatGPT ne soit pas encore capable de coder un ransomware aussi complexe et dagenreux que Conti ou WannaCry.

Cependant, il estime que cette IA pourrait simplifier l’accès au cybercrime pour les débutants. Il craint aussi que l’outil soit utilisé pour construire des sites web et des chatbots pour pousser les internautes à dévoiler leurs informations personnelles…

Selon ses dires, ChatGPT pourrait « industrialiser la création et la personnalisation de pages web malveillantes, de campagnes de phishing hautement ciblées, et d’arnaques reposant sur l’ingénierie sociale ».

Comment se protéger contre ce nouveau danger ?

Malheureusement, il n’existe pas de formule magique pour se protéger des hackers exploitant ChatGPT. Selon Shykevich, la seule protection possible est une régulation du marché de l’IA.

À l’heure actuelle, OpenAI a déjà implémenté des barrières et des fonctionnalités de contrôle. Les requêtes explicites demandant à ChatGPT de créer des malwares sont automatiquement rejetées, et considérées comme une violation des conditions d’utilisation du service.

Toutefois, des hackers et des journalistes ont déjà trouvé des façons de contourner ces garde-fous. Selon les experts, il pourrait donc être nécessaire que les gouvernements forcent les entreprises comme OpenAI a entraîné leurs IA pour détecter de tels abus…

- Partager l'article :