Le laboratoire d’intelligence artificielle CSAIL du MIT vient de créer un nouveau type de modèle de Deep Learning : les réseaux de neurones liquides. Découvrez comment cette invention va bouleverser le monde de l’IA, notamment les domaines de la robotique et des véhicules autonomes…

Suite au succès de ChatGPT, les entreprises et laboratoires d’intelligence artificielle du monde entier se sont lancés dans une course pour créer des réseaux de neurones toujours plus larges.

En effet, les chatbots IA reposent sur les LLM : Larges Modèles de Langage. Toutefois, les modèles de Deep Learning les plus colossaux exigent une puissance de calcul et une mémoire hors de portée de certaines applications.

C’est la raison pour laquelle de nombreux chercheurs tentent de trouver des alternatives. Et à présent, le laboratoire IA du MIT vient d’inventer une nouvelle architecture de deep learning très prometteuse : les réseaux de neurones liquides.

Cette innovation fournit une solution compacte, adaptable et efficace à plusieurs problèmes de l’intelligence artificielle, en surmontant les limites des modèles d’apprentissage profond plus traditionnels.

Grâce à ces réseaux de neurones d’un genre nouveau, une nouvelle vague d’innovation va déferler sur le secteur de l’IA. C’est une invention potentiellement révolutionnaire, en particulier pour les domaines tels que la robotique et les véhicules autonomes…

Qu’est-ce qu’un réseau de neurones liquide ?

Selon Daniel Rus, la directrice du CSAIL du MIT, « l’inspiration pour les réseaux de neurones liquides a été de penser aux approches existantes du Machine Learning et de considérer comment elles s’accordent avec le genre de systèmes de sécurité que les robots et appareils edge offrent ».

Par exemple, « sur un robot, il n’est pas vraiment possible d’exécuter de large modèle de langage puisqu’il n’y a pas vraiment la puissance de calcul et l’espace de stockage requis pour cela ».

Ainsi, Rus et ses collaborateurs ont voulu créer des réseaux de neurones à la fois précis et efficaces pouvant être exécutés sur les ordinateurs d’un robot sans avoir besoin d’être connectés au cloud.

Ils ont également été inspirés par la recherche sur les neurones biologiques de petits organismes tels que le ver C. Elegans. Ce dernier peut effectuer des tâches compliquées avec seulement 302 neurones.

Après de longs mois de travail, le CSAIL a créé les réseaux de neurones liquides. Très différents des modèles de deep learning traditionnels, ils utilisent une formule mathématique moins gourmande en puissance de calcul et qui stabilise les neurones pendant l’entraînement.

Le secret de leur efficacité est l’utilisation d’équations différentielles ajustables dynamiquement. Ceci leur permet de s’adapter à de nouvelles situations après l’entraînement : une capacité qu’on ne trouve pas chez les Neural Networks classiques.

Toujours d’après Rus, pour faire simple, « ce que nous faisons est d’augmenter la capacité d’apprentissage de représentation d’un neurone de deux insights par rapport aux modèles existants ».

Le premier insight est une sorte de « modèle d’espace d’états » qui augmente la stabilité des neurones pendant l’apprentissage. Par la suite, des non-linéarités sont introduites sur les entrées synaptiques pour augmenter l’expressivité du modèle pendant la formation et l’inférence.

En outre, les LNN utilisent une architecture de câblage différente des réseaux traditionnels permettant les connexions latérales et récurrentes au sein de la même couche.

Les équations mathématiques sous-jacentes et la nouvelle architecture câblée permettent aux réseaux de neurones liquides d’apprendre des modèles en temps continu capables d’ajuster leur comportement de manière dynamique.

Ce modèle est donc très intéressant, car il est capable d’être adapté dynamiquement après son entraînement en se basant sur les inputs qu’il perçoit. De plus, les constantes de temps qu’il observe sont dépendantes des inputs qu’il voit. Ceci garantit plus de flexibilité et d’adaptation par le biais de cette formulation du neurone.

Quels sont les avantages ?

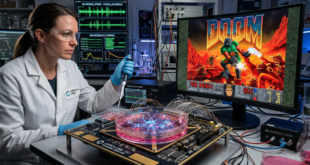

L’un des principaux points forts des réseaux de neurones liquides est leur compacité. À titre d’exemple, un réseau profond classique requiert environ 100 000 neurones artificiels et un demi-million de paramètres pour effectuer une tâche comme garder une voiture sur sa voie.

De leur côté, les chercheurs du CSAIL ont pu entraîner un réseau de neurones liquide à accomplir la même tâche avec seulement 19 neurones.

Cette réduction de taille majeure a plusieurs conséquences importantes. Tout d’abord, elle permet au modèle de fonctionner sur les petits ordinateurs des robots et autres appareils edge.

De plus, grâce au nombre réduit de neurones, le réseau devient beaucoup plus interprétable. Or, l’interprétabilité est l’un des grands défis du domaine de l’IA. Jusqu’à présent, il était très difficile de comprendre comment un modèle Deep Learning était parvenu à une décision en particulier.

Avec seulement 19 neurones, il est possible d’extraire l’arbre de décision correspondant aux patterns et aux flux de prise de décision. Ce n’est pas possible avec 100 000 neurones ou plus.

Autre obstacle surmonté par les LNN : la causalité. Les systèmes de Deep Learning traditionnels peinent souvent à comprendre les relations causales, ce qui les mène à apprendre des patterns qui ne sont pas liées aux problèmes qu’elles tentent de résoudre.

Les réseaux liquides quant à eux semblent mieux comprendre les relations causales, leur permettant de généraliser à des situations inédites.

Les chercheurs du CSAIL ont entraîné des LNN et plusieurs autres types de modèles de Deep Learning à la détection d’objets sur un flux de vidéos capturées dans les bois pendant l’été.

Lorsque le LNN entraîné a été testé sur une situation différente comme un paysage d’automne ou d’hiver, il était toujours en mesure d’effectuer la tâche avec une haute précision. Au contraire, les autres types de réseaux de neurones ont subi une chute de performances importante.

En effet, les réseaux liquides se focalisent sur la tâche et non sur le contexte. Les autres modèles reposent excessivement sur l’analyse du contexte du test et non uniquement sur la tâche.

Les cartes d’attention extraites des modèles montrent que les LNN donnent de plus hautes valeurs au principal élément de la tâche, comme la route pour les tâches de conduite ou les objets pour les tâches de détection d’objets.

C’est la raison pour laquelle ils peuvent s’adapter à la tâche quand le contexte change. Les autres modèles éparpillent leur attention sur des parties non pertinentes de l’input.

Ainsi, les réseaux liquides sont plus adaptables puisqu’il est possible de les entraîner sur un environnement et que la solution peut ensuite être adaptée à d’autres environnements.

Une révolution potentielle pour la robotique et les véhicules autonomes

La principale utilité des LNN est la prise en charge de flux de données continus. Ceci inclut par exemple les streams de vidéo, d’audio, ou encore les séquences de mesures de température.

Pour qu’ils fonctionnent bien, une séquence comme des données de série temporelle est requise. Il n’est pas possible d’appliquer cette solution à des bases de données statiques comme ImageNet.

La nature et les caractéristiques des LNN les rendent particulièrement adaptés aux applications exigeantes en puissance de calcul ou nécessitant une sécurité robuste comme la robotique ou les véhicules autonomes, où les données nourrissent continuellement les modèles de machine learning.

L’équipe du MIT a déjà testé les LNN sur des configurations avec un seul robot, et les résultats sont prometteurs. À l’avenir, ils prévoient d’étendre leurs tests à des systèmes multi-robot et d’autres types de données pour explorer davantage les capacités et limites de ces réseaux d’un genre nouveau…

- Partager l'article :

Les sources……

Un robot sera totalement intelligent quand il pourra assurer complètement la survie d’un être humain dans la nature. Lui construire un abri, lui trouver à boire et à manger, le soigner, etc. Se réparer lui-même et se cloner à partir des ressources qu’il trouve, bref qu’il soit gratuit !

Allez, au boulot….

Aucune source… Avec des termes aussi vagues et aucun lien vers les travaux original, on est sur une conversation comptoir.