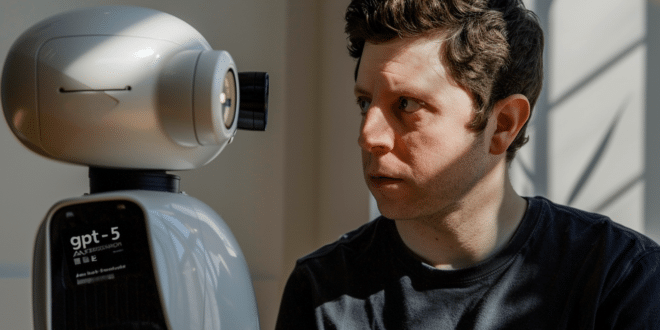

OpenAI vient de confirmer que l'entraînement de son prochain modèle IA frontière a commencé, et il s'agira probablement de GPT-5. En parallèle, la firme annonce la création d'un comité de sécurité visant à éviter que cette intelligence artificielle surpuissante se rebelle contre les humains…

C'est la nouvelle que tout le monde attendait, du moins dans le domaine de l'IA : OpenAI a officiellement débuté l'entraînement de GPT-5.

Sans mentionner ce nom spécifique, l'entreprise américaine confirme avoir récemment commencé l'entraînement de son prochain modèle frontière.

Pour rappel, ce terme désigne un système d'intelligence artificielle conçu pour repousser les limites actuelles en termes de capacités et de performances. Il s'agira donc d'un bond en avant par rapport à GPT-4.

Elle précise également qu'elle espère que cette nouvelle IA va la rapprocher de son but ultime : la création d'une AGI, une intelligence artificielle générale comparable à celle de l'humain…

Le retour en force de GPT ?

Alors que la firme fait face à de vives polémiques, notamment pour avoir « volé » la voix de Scarlett Johansson, cette annonce fracassante pourrait lui permettre de redorer son blason.

La concurrence dans l'industrie est de plus en plus féroce, et OpenAI peine à conserver sa domination face à des rivaux comme Google Gemini 1.5 Pro ou Anthropic Claude 3 Opus.

D'ailleurs, le chercheur Jan Leike qui a récemment quitté OpenAI sur fond de crainte pour la sécurité de ses IA vient de rejoindre Anthropic.

Lors de son keynote du 13 mai 2024, l'entreprise a dévoilé son nouveau modèle GPT-4o, mais celui-ci offre des performances très similaires à GPT-4 Turbo et apporte principalement la communication orale.

Ainsi, en annonçant le lancement prochain de GPT-5, la startup de San Francisco peut rassurer ses utilisateurs et ses investisseurs en leur faisant miroiter la prochaine évolution de son produit phare.

Un comité de sécurité pour empêcher GPT-5 de se rebeller

Toutefois, la sécurité semble bel et bien être une source d'inquiétude dans les bureaux d'OpenAI. Outre le début de l'entraînement de son prochain modèle, la firme annonce la création d'un nouveau Comité de Sûreté et de Sécurité.

Il sera dirigé par les cadres Bret Taylor, Adam d'Angelo, Nicole Seligman… et par le CEO Sam Altman lui-même. Ce groupe aura pour mission d'émettre des recommandations sur la sécurité de l'IA à tous les cadres de l'organisation.

Il s'agit principalement d'éviter que cette nouvelle IA se rebelle contre les humains et cherche à les détruire. En effet, à mesure que les modèles deviennent plus intelligents, la plus grande peur est qu'ils deviennent incontrôlables…

En outre, dans un communiqué daté du 21 mai 2024, OpenAI a listé un ensemble de processus et de garde-fous visant à éviter différentes dérives potentielles.

Ceci inclut la protection des enfants, la préservation de l'intégrité des élections politiques, l'évaluation des impacts sociaux, ou encore l'implémentation de mesures de sécurité.

La première tâche de ce comité sera d'évaluer et de poursuivre le développement de ces processus au cours des 90 prochains jours. Il partagera ensuite ses recommandations avec les cadres, et OpenAI partagera publiquement une mise à jour sur les mesures adoptées.

Plusieurs experts viendront épauler l'équipe. C'est le cas de Aleksander Madry (directeur de la préparation), John Schulman (directeur de l'alignement scientifique), Matt Knight (directeur de la sécurité) et Jakub Pachocki (scientifique en chef).

Sam Altman est désormais supervisé par… Sam Altman

Là encore, la création de ce comité peut être perçue comme une réponse à la mauvaise publicité causée par la démission soudaine des membres de l'équipe de « super-alignement » d'OpenAI, Ilya Sutskever et Jan Leike, il y a deux semaines.

Cette équipe était chargée de trouver comment « diriger et contrôler » les systèmes IA plus intelligents que les humains. Leur départ laisse à penser qu'OpenAI n'est pas suffisamment impliqué dans la sécurisation de ses modèles surpuissants…

Le nouveau comité va jouer ce rôle de supervision, mais certains critiqueront sans doute le fait qu'il soit directement dirigé par le CEO Sam Altman.

Rappelons qu'à la fin de l'année 2023, une vive querelle avait éclaté au sein de la firme américaine. Selon les rumeurs, le conseil d'administration avait justement reproché à Altman de négliger totalement les dangers de l'IA et avait tenté de le renvoyer.

On peut donc craindre que ce nouveau groupe de contrôle ne soit qu'une façade visant à rassurer les foules, sans véritablement veiller à éviter les dérives de GPT-5. Quoi qu'il en soit, il ne reste plus qu'à attendre le lancement de ce modèle pour découvrir ce dont il est réellement capable…

Et vous, qu'en pensez-vous ? Qu'attendez-vous de GPT-5 par rapport aux IA actuelles ? Craignez-vous que ce modèle surpuissant échappe au contrôle d'OpenAI ? Partagez votre opinion en commentaire !

- Partager l'article :